Altman 把 AI 能耗比作「養一個人」,為何引爆全球科技圈論戰?

OpenAI 執行長 Sam Altman 將訓練 AI 模型的能耗比擬為「培養一個人類長大」,此言論迅速在全球科技圈引爆論戰。從數據比較到哲學質疑,這場爭議揭示的不只是能源數字,更是 AI 產業面對環境責任時的敘事策略。

2026 年 2 月 20 日,OpenAI 執行長 Sam Altman 在印度新德里《The Indian Express》旗下 Express Adda 活動中,針對 AI 能源消耗議題發表了一段引發軒然大波的言論。他將訓練一個 AI 模型所需的能源,與「培養一個人類長大成人」的能量消耗相提並論,試圖為 AI 產業的龐大電力需求提供新的思考框架。這番話迅速在社群平台 X(前 Twitter)上瘋傳,並引來 Zoho 共同創辦人、研究者及大量網友的猛烈抨擊。

在全球資料中心用電量節節攀升、AI 環境成本持續受到審視的當下,這場辯論不只是數字比較,更觸及一個根本問題:我們該如何衡量 AI 的價值與代價?

Altman 說了什麼?

「訓練一個人也很耗能」

Altman 在活動中直言,外界拿「訓練一個 AI 模型的電力成本」對比「一個人回答一個問題的能耗」,這種比較方式本身就不公平。他指出:

「人們總在討論訓練 AI 模型要多少能源,但訓練一個人也需要很多能源。你得花 20 年的時間、吃掉那些年所有的食物,才能變聰明。」

Altman 進一步補充,人類智能的形成不僅是個人 20 年的投入,更是「約 1000 億曾經活過的人類」透過演化、學習、累積知識的結果。

單次查詢的能源效率比較

Altman 提出他認為更合理的比較框架:一旦模型訓練完成,比較 AI 回答一個問題所需的能源與人類回答同一問題的能源,AI 在能源效率上「可能已經追上來了」。根據 Altman 此前公布的數據,單次 ChatGPT 查詢消耗約 0.34 瓦時(Wh),相當於一個高效燈泡運作幾分鐘的用電量。

駁斥「17 加侖水」的迷因

Altman 也直接反駁了網路上廣泛流傳的說法——每次 ChatGPT 查詢消耗 17 加侖水。他稱這「完全不實、極度荒謬、與現實毫無關聯」,並解釋這些數字來自早期資料中心使用蒸發式冷卻的時代,現代設施已大幅減少甚至不再依賴水冷。

不過,Altman 也坦承 AI 整體能耗確實是實際問題,強調產業必須「快速轉向核能、風能與太陽能」。

各界為何群起反對?

Zoho 創辦人 Vembu:「不該把科技等同於人」

Sridhar Vembu, Zoho CEO, in a professional portrait.

Altman 的言論被 X 帳號 Chief Nerd 剪輯並轉發後,迅速獲得數千則回覆與轉貼。Zoho 共同創辦人暨執行長 Sridhar Vembu 率先回應,明確表達反對立場。

Vembu 在 X 上寫道:「我不想看到一個把技術等同於人類的世界。」他進一步表示:「身為技術人員,我努力工作,是為了讓科技不要主宰我們的生活——它應該安靜地退到幕後。」 Vembu 的回應將焦點從能源數據計算,拉回到更根本的哲學層面:社會應如何定位科技與人類生命之間的關係。

Matt Stoller:「一個大試算表跟嬰兒道德等價?」

反壟斷研究者 Matt Stoller 的批評更為辛辣,他在 X 上寫道:「他的意思是,一個非常大的試算表和一個嬰兒在道德上是等價的。」 這則貼文引發大量共鳴,許多人認為 Altman 的類比暴露了矽谷高管看待人類生命與企業利益的態度。

其他社群反應同樣激烈。漫畫家 George Alexopoulos 評論「他們看不出人類和物品之間的差別」,Comicbook.com 主編 Simon Gallagher 則表示「任何用這種方式談論人類的人,都不應該從事會影響他人的工作」。

數據怎麼說?Altman 的比喻經得起檢驗嗎?

訓練一個模型 ≈ 培養 3,000 個人?

批評者對 Altman 的類比進行了量化分析。一個人平均每天攝取約 2,000 大卡熱量,20 年的食物總能量約為 17,000 千瓦時(kWh)。相較之下,訓練 GPT-4 模型估計消耗約 50 吉瓦時(GWh,即 5,000 萬 kWh)的電力。

這意味著,單次訓練 GPT-4 的能源消耗,大約相當於「培養 3,000 個人類從出生到成年」所需的食物能量。更關鍵的是,GPT-4 已經是上一代模型——新一代模型的訓練成本只會更高。科技評論者 Aakash Gupta 在 X 上指出:「而且 GPT-4 已經死了」——意指這筆龐大的能源投入在模型被取代後就不再產生價值。

單次查詢的實際能耗

| 操作類型 | 能耗(瓦時) |

|---|---|

| 一次 Google 搜尋 | 約 0.3 Wh |

| 一次 ChatGPT 查詢 | 約 0.3–0.34 Wh |

| AI 影片生成 | 文字生成的 100 倍以上 |

從單次查詢來看,ChatGPT 與 Google 搜尋的能耗差距並不如想像中巨大。但批評者指出,真正的問題在於規模:ChatGPT 每天處理超過 10 億則訊息,這使得整體能耗遠非「一個燈泡幾分鐘」可以概括。

水資源消耗的爭議

Altman 聲稱的每次查詢用水約 0.000085 加侖(約十五分之一茶匙),乘以每日 10 億則訊息的規模,仍相當於每天約 85,000 加侖的用水量——等同於美國約 289 個家庭的日均用水。雖然單次看似微不足道,規模化後數字依然驚人。

AI 資料中心的能耗危機

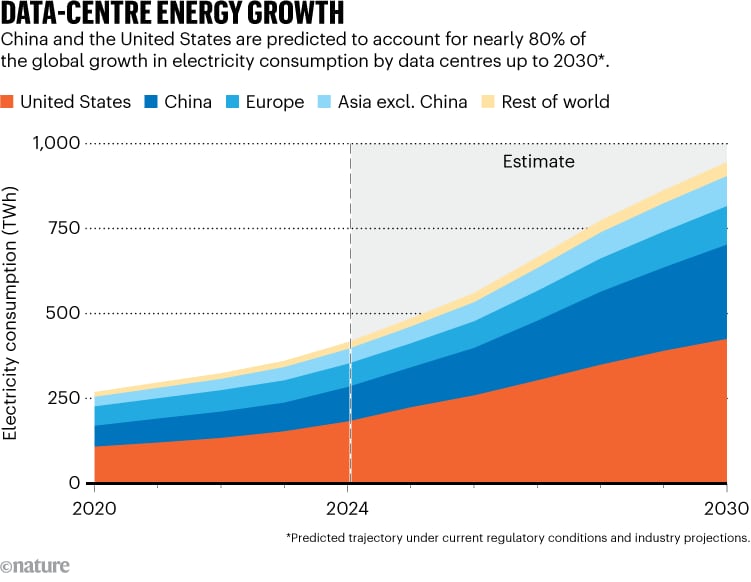

IEA chart projecting data centre electricity consumption growth to 2030, with China, US, and Asia leading nearly 80% of global increase.

這場辯論的背景是全球 AI 基礎設施持續膨脹的能源需求。

根據國際能源署(IEA)的數據,全球資料中心在 2024 年消耗約 415 太瓦時(TWh)的電力,約佔全球總用電量的 1.5%。

在美國,資料中心用電量在 2023 年達到約 176 TWh,佔全國總用電量的 4.4%。

IEA 預測,到 2030 年,全球資料中心用電量可能飆升至 945 TWh,幾乎是 2024 年的 2.3 倍,相當於日本目前一整年的用電量。其中,AI 專用伺服器在 2024 年已佔資料中心伺服器用電的 24%,佔資料中心總能耗的 15%。

AI 工作負載對硬體的需求也在根本改變資料中心的設計。傳統 CPU 伺服器功耗約 300-500 瓦,而 GPU 加速伺服器動輒 3,000-5,000 瓦以上,AI 訓練叢集甚至可達每台伺服器 10,000 瓦。

這場辯論為何重要?

從能源數字到價值觀之爭

Altman 的類比引發的爭議,表面上是能源數據的比較,實質上反映了 AI 產業在面對環境質疑時的敘事策略。正如 AI Dev Day India 所評論的,Altman 將「生物性食物消耗」等同於「電力訓練週期」的類比,標誌著科技巨頭在 2026 年對抗環境監管的一種「永久性論述轉向」——試圖把評估標準從絕對能耗轉移到「智能效率」。

「建更乾淨的能源,而不是更慢的 AI」

Altman 給出的解方——加速清潔能源建設,而非放緩 AI 發展——代表了矽谷的主流立場。但批評者認為,這種論述迴避了一個核心問題:當 AI 公司以指數級速度擴張運算需求,清潔能源的建設速度能否跟上?而這種「先發展、後補救」的邏輯,是否本身就值得被質疑?

對台灣科技產業的啟示

對關注 AI 發展的台灣讀者而言,這場辯論具有多重意義。台灣半導體產業是全球 AI 算力的核心供應者,AI 運算需求的暴增直接牽動台灣的能源政策、電力供應及產業佈局。在全球 AI 能耗辯論升溫之際,如何在推動 AI 產業發展的同時確保能源永續性,將成為台灣不可迴避的議題。

延伸思考

這場因一段訪談引爆的論戰,揭示了 AI 產業面臨的根本張力:如何在持續擴大的運算需求與環境承諾之間取得平衡。Altman 的類比或許試圖為 AI 能耗提供一個新的思考角度,但當訓練一個模型的能耗等同於培養數千個人類時,「重新框架」與「淡化問題」之間的界線,恐怕比他想得更模糊。