免費就能用的最強開源 AI模型—Google Gemma 4 來了

Google 於 2026 年 4 月發布 Gemma 4 開源模型系列,首次採用 Apache 2.0 授權,允許免費商業使用。四款模型覆蓋手機到工作站,旗艦版 31B 在 Arena AI 全球開源排名第三,效能超越 20 倍規模的競爭對手。對企業與開發者而言,這是目前最具競爭力的免費可商用 AI 選項。

你是否一直在找一款能跑在自己設備上、不需要花大錢、又真的夠強的 AI 模型?2026 年 4 月 2 日,Google 正式發布 Gemma 4 系列開源模型,首次採用 Apache 2.0 授權,讓開發者和企業可以完全免費商業使用。這不只是一次版本更新,更是 Google 向開源 AI 社群釋出的最大善意——而且這次,連跑在手機上的小模型都能打敗比它大 20 倍的競爭對手。

Gemma 4 是什麼?Google 最新開源模型正式亮相

Gemma 4 是 Google 於 2026 年 4 月 2 日正式發布的最新一代開源 AI 模型系列,底層技術與 Gemini 3 相同。Google 明確表示,Gemma 4 是「使用與 Gemini 3 相同的世界級研究和技術」所打造,換句話說,這是一款「平民版 Gemini」,但以開源形式免費釋出給全球開發者。

Gemma 4 最受矚目的地方有兩個:第一是它首次採用 Apache 2.0 授權,相較於過去 Gemma 系列較為保守的授權限制,這次的開放程度大幅提升;第二是效能——Google 聲稱 Gemma 4 能夠「超越規模大 20 倍的模型」,這在 AI 業界並不常見。

對於台灣的開發者、新創公司和內容創作者而言,Gemma 4 代表的是:你終於有一款能部署在自己伺服器甚至手機上、不用擔心版權問題、又具備真實競爭力的 AI 模型。

四款模型規格完整比較

Gemma 4 系列共推出四款模型,針對不同運算資源和應用場景設計。從邊緣設備(如手機、樹莓派(Raspberry Pi,一款低價小型電腦))到高效能工作站,都有對應的版本可選。

| 模型名稱 | 參數規模 | 適用裝置 | 上下文視窗 | Arena AI 排名 | 授權 |

|---|---|---|---|---|---|

| Gemma 4 E2B(Effective 2B) | 20 億 | 手機、Raspberry Pi | 128K tokens | 邊緣設備頂級 | Apache 2.0 |

| Gemma 4 E4B(Effective 4B) | 40 億 | 手機、Jetson Nano | 128K tokens | 邊緣設備頂級 | Apache 2.0 |

| Gemma 4 26B MoE | 260 億(混合專家) | 高效能 GPU 工作站 | 256K tokens | 全球開源第 6 名 | Apache 2.0 |

| Gemma 4 31B Dense | 310 億 | 高效能 GPU 工作站 | 256K tokens | 全球開源第 3 名 | Apache 2.0 |

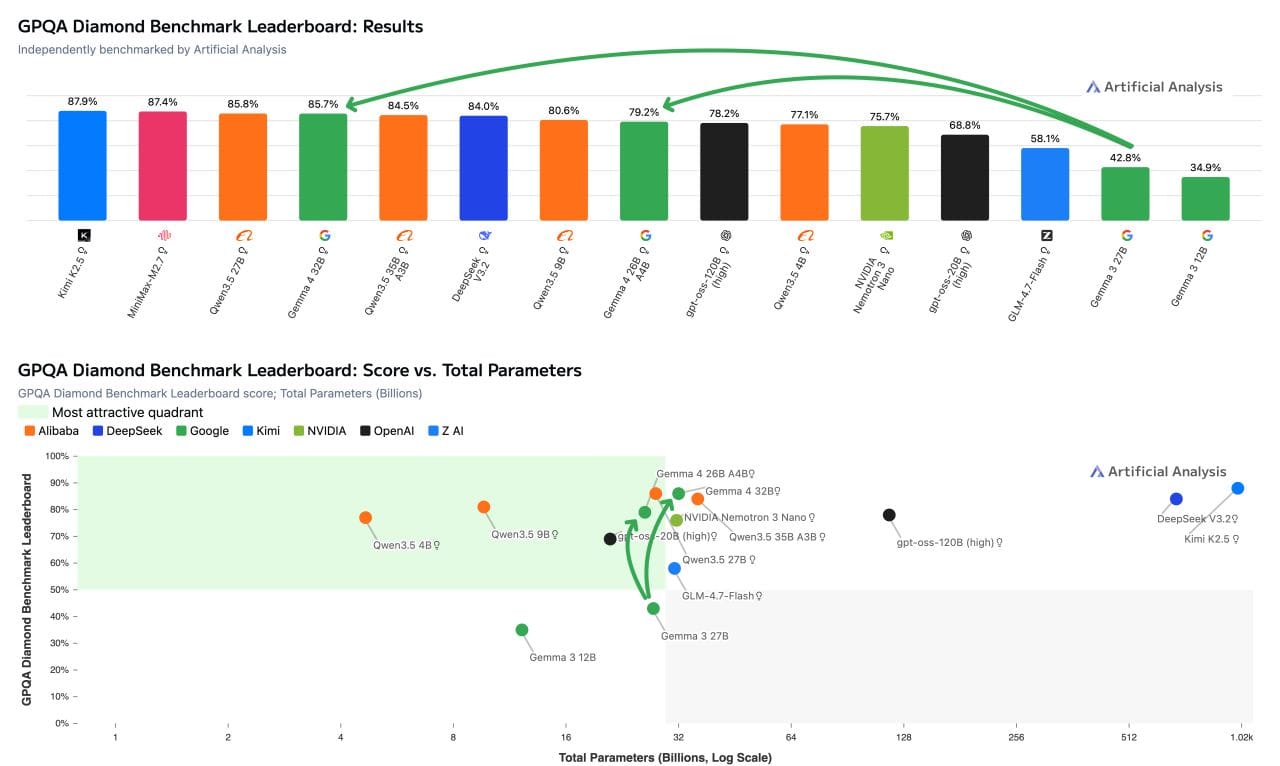

四款模型中,Gemma 4 31B Dense 是旗艦版本,在 Arena AI 的文字排行榜上拿下全球開源模型第 3 名,僅次於少數閉源或規模更大的競爭者。而 26B MoE 版本採用「混合專家架構(Mixture of Experts)」,在相同硬體上能以更低運算成本達到接近旗艦的效果,全球排名第 6。

對一般用戶最有感的,是 E2B 和 E4B 兩款邊緣模型。這兩款模型能跑在手機、Raspberry Pi 甚至 Jetson Nano 等低功耗設備上,卻仍具備 128K tokens 的超長上下文視窗,在 Gemma 4 發布之前,這類規格幾乎只在雲端大模型上才能見到。

Apache 2.0 授權的意義:這次比以前更重要

Gemma 4 採用 Apache 2.0 授權是這次發布中最值得特別關注的一件事。過去的 Gemma 系列模型使用較為嚴格的自訂授權條款,雖然允許研究使用,但在商業用途上有諸多限制,讓許多企業望之卻步。

Apache 2.0 是業界最被廣泛接受的開源授權之一,核心精神是:你可以免費使用、修改、再分發,甚至用於商業產品,唯一要求是保留原始版權聲明。這意味著,台灣的新創公司現在可以拿 Gemma 4 的模型權重,直接用在自己的 SaaS 產品、App 或企業內部系統,完全不需要支付授權費,也不用擔心未來 Google 改變政策後的法律風險。

這項授權變化的市場意義:Gemma 4 開源模型正式進入企業採購考量的選項清單,而不只是工程師玩玩的實驗品。對比 Meta Llama 系列同樣受歡迎的開源策略,Google 這次選擇在授權上向開源社群靠攏,可以視為一次清楚的市場信號——Google 打算在開源 AI 領域長期競爭。

Gemma 4 能做什麼:多模態、多語言與代理工作流

Gemma 4 不只是一款文字模型,它支援多模態輸入,包括圖片、影片和原生音訊輸入。這讓 Gemma 4 能夠直接處理語音識別任務,不需要串接額外的語音轉文字服務。

在語言支援上,Gemma 4 原生訓練涵蓋超過 140 種語言,繁體中文當然包含在內。這對於希望在地化部署的台灣團隊來說是一大優勢,不需要另外進行語言微調(fine-tuning)就能得到相對穩定的中文輸出品質。

在應用能力上,Gemma 4 系列支援複雜邏輯推理和「代理工作流(Agentic Workflows)」,意即模型可以被設計成能夠自主規劃步驟、呼叫外部工具、完成多步驟任務的 AI Agent。這個方向與目前整個 AI 產業的主流趨勢一致——2026 年,AI Agent 正在從概念走向實際部署。

值得一提的是上下文視窗的規格。小型邊緣模型(E2B、E4B)支援 128K tokens 的上下文,大型模型(26B、31B)則最高支援 256K tokens。256K tokens 大約相當於一本 200 頁的書,代表你可以把一份完整的長合約、一個完整的程式碼庫,或數十封電子郵件同時丟進模型做分析,不需要截斷內容。

如何取得 Gemma 4:從 Hugging Face 到 Ollama

Gemma 4 目前已透過多個平台釋出,涵蓋大部分開發者慣用的工具鏈。

取得方式如下:在 Hugging Face 上搜尋 google/gemma-4 即可找到所有四款模型的權重,直接下載使用。若你習慣用 Ollama 在本機跑模型,Gemma 4 的版本也已在 Ollama 的模型庫上架。想在 Kaggle 的環境中實驗,同樣可以找到完整的 Gemma 4 系列。

針對行動裝置的開發者,Google 也在 Google AI Edge Gallery 和 Google AI Studio 提供了對應的整合入口,方便直接測試和部署到 Android 裝置上。值得注意的是,Google 同步發布了 Android AI Core Developer Preview,讓開發者可以在 Android 原生環境中直接呼叫 Gemma 4 的推理能力,不需要將模型上傳到外部雲端。

對非工程師的讀者,目前最快上手的方式是透過 Google AI Studio(ai.google.dev)直接在瀏覽器中測試 Gemma 4 的各款模型,無需本地安裝任何軟體。

Gemma 4 對非工程師的實際意義

如果你不是工程師,你可能會問:Gemma 4 跟我有什麼關係?答案是:間接的,但很真實。

首先,Apache 2.0 授權代表更多工具和服務會以 Gemma 4 作為底層模型開發,未來你使用的許多 AI 工具,背後的模型可能就是 Gemma 4。這類工具通常比使用付費 API 的服務定價更低,因為不需要支付每次呼叫的費用。

其次,對於在台灣經營自媒體、電商或小型服務業的人來說,Gemma 4 的本地部署能力代表「不把資料傳到外部雲端」的可能性。資料隱私越來越重要,特別是當你處理客戶資訊或企業機密文件時,能在自己伺服器或設備上跑 AI 模型,是一項真實的競爭優勢。

第三,Gemma 4 在效能上的表現讓競爭加劇,這直接帶動整個市場的模型品質提升與價格下降。今天 Google 開源,明天 OpenAI 和 Anthropic 就必須給出更好的理由讓你繼續付費使用他們的閉源模型。對用戶來說,這是好事。

Gemma 4 的發布提醒我們:AI 的門檻正在快速下降,而開源社群的力量,是讓這件事發生的最重要推手之一。

資料來源

- Google announces open Gemma 4 model with Apache 2.0 license – 9to5Google

- Google releases Gemma 4, a family of open models built off of Gemini 3 – Engadget

- Google's Gemma 4 is now available with Apache 2.0 licensing for the first time – The Decoder

- Announcing Gemma 4 in the AICore Developer Preview – Android Developers Blog

- Google releases its most powerful open-source AI models yet – Neowin