【NVIDIA 專訪】機器人產品負責人 Spencer Huang——帶你了解機器人「如何認識世界」

NVIDIA 發表最新 Cosmos 世界基礎模型,搭配 Omniverse 實體模擬平台,讓 AI 不只能「想像世界」,還能精準生成高擬真互動資料。從感知、決策到動作,全在虛擬空間中練功千萬次,改寫未來 AI 訓練邏輯!

NVIDIA自己創造出一個世界,讓 AI 自己學

我們早已習慣大語言模型(LLM)如 ChatGPT 的聰明機智,因為它們有整個人類網路歷史作為語料來源。但當你試著讓一個機器人在現實世界中開門、拿東西、走樓梯……資料就不夠用了。畢竟,我們並沒有成千上萬小機器人天天在街頭練習,留下可供學習的動作紀錄。

正如NVIDIA機器人產品負責人 Spencer Huang 所說:「你可以請人收集這些互動資料,但很花時間,也不夠多;你也可以用 AI 合成,但品質參差不齊;而從網路抓的影片又不夠精準。唯一可行的方式是——自己創造出一個世界,讓 AI 自己學。」

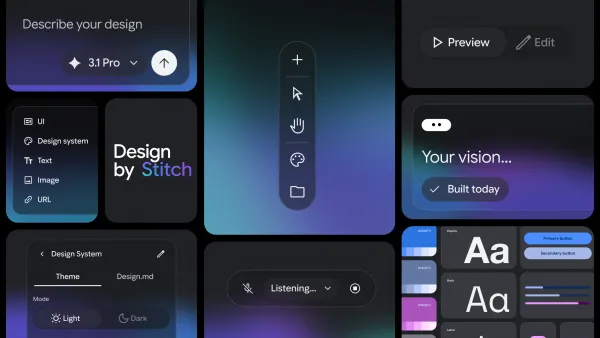

這正是 NVIDIA 所提出的解方:結合 Omniverse 實體模擬平台 和最新推出的 Cosmos 世界基礎模型,打造出一個「訓練用世界生成器」。

什麼是 Cosmos?給機器人一個能練功的虛擬世界

Cosmos 是一個專為「物理 AI」打造的世界基礎模型(World Foundation Model, WFM),它能根據文字、影像、感測數據等輸入,自動「推理」與「生成」虛擬世界的狀態、動作軌跡甚至物體互動。

這次 NVIDIA 發布了三大功能核心:

- Cosmos Transfer:能根據深度圖、雷達點雲、動作軌跡等輸入,輸出真實感極高的影片片段,適合用於訓練自駕車、機器人感知模型。

- Cosmos Predict:可根據起點與終點畫面,自動補出中間的動作過程。例如機器人從 A 走到 B,它會自動預測路線與行為邏輯。這項技術也被企業用於自駕與仿人機器人的訓練。

- Cosmos Reason:具備時空推理能力的開放式模型,能「看懂」影片並用自然語言預測行為後果,比如一個人走進斑馬線會發生什麼。

這些模型可透過 Hugging Face、GitHub 獲取試用,也支援 PyTorch 與 NVIDIA NeMo 框架做後訓練,整合性極高。

Omniverse:讓世界具現的物理模擬舞台

Cosmos 再強大,還需要一個「世界」讓它發揮。這就是 NVIDIA Omniverse 的角色——一個支援真實物理、可編輯、可視覺化的 3D 模擬平台。

Spencer Huang 在實機展示中,示範了如何利用 Omniverse 搭配 Cosmos:「我輸入了一個請求,讓場景中的木質桌面變成鋼鐵表面,大約 6 秒就能產生結果,整體往返不到 9 秒。」不再需要手動修改 3D 模型,只要下個 prompt,Cosmos 就能理解並轉換模擬環境。

這種方式大幅加速資料擴增(data augmentation),比傳統方式省時上百倍。舉例來說,NVIDIA 推出的 Isaac GR00T 藍圖,就是透過 Cosmos + Omniverse,將原本需要幾天的動作資料收集濃縮成幾小時完成。

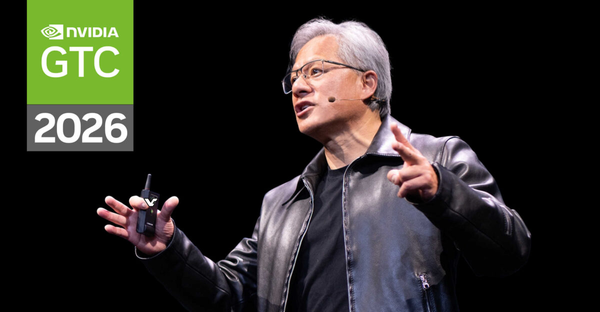

這是一場 AI 訓練方式的大翻轉

NVIDIA CEO 黃仁勳在 GTC 發表會上指出:「就像 LLM 顛覆了語言生成,Cosmos 將為物理 AI 帶來突破性躍進。」透過 Cosmos,機器人不必再靠真實世界中耗時又高風險的嘗試來學習,而是能在虛擬環境中進行無限次模擬與修正。

簡單說,LLM 用的是「讀書法」,Cosmos 帶來的,則是「實作法」。未來從仿人機器人、智慧車輛,到手術機器手臂,都能透過這樣的模型進行訓練與強化。

而當「大腦」Cosmos 結合「世界」Omniverse,我們正在見證一個全新 AI 訓練時代的誕生。

Spencer Huang, NVIDIA’s Robotics Product Lead: Teaching Robots to Understand the World

NVIDIA Is Building Virtual Worlds So AI Can Learn by Doing

Large language models like ChatGPT learn from text. But training robots to interact with the real world — open doors, pick up objects, avoid people — requires data we simply don’t have.

“We don’t have millions of robots practicing in the streets,” says Spencer Huang, NVIDIA’s Robotics Product Lead. “Real-world data is limited, synthetic data can be low quality, and internet videos aren’t precise. The only scalable solution is to build a world where AI can learn on its own.”

That’s exactly what NVIDIA is doing — combining its Omniverse simulation platform with the new Cosmos World Foundation Models (WFMs) to generate high-quality, physics-based training data at scale.

Cosmos: A Scalable Engine for Physical AI

Cosmos enables robots to learn in realistic virtual environments. It includes:

- Cosmos Transfer – Turns depth maps, LiDAR, and motion data into photorealistic video for training.

- Cosmos Predict – Fills in motion paths between states (e.g. robot going from A to B).

- Cosmos Reason – Interprets video and predicts outcomes with natural language.

These models support PyTorch and NeMo, and are available on GitHub and Hugging Face.

Omniverse: Where Cosmos Comes Alive

Omniverse provides the 3D, editable, physics-accurate environment Cosmos needs. In a demo, Huang showed a simple prompt changing a wooden table into steel — generated in under 9 seconds.

This dramatically accelerates data augmentation. For instance, the Isaac GR00T system compresses days of robot motion data collection into just hours.

A New Era of AI Training

“Just as LLMs changed language AI, Cosmos is a leap for physical AI,” said Jensen Huang at GTC. Now, robots can train through millions of simulations — safely, endlessly, virtually.

LLMs learn by reading. Cosmos learns by doing.

From robots to self-driving cars to surgical systems, Cosmos and Omniverse are reshaping how AI learns to move, act, and adapt in the real world.

Special thanks to Spencer Huang for the insights!