AI 開始看懂監控畫面了:Perceptron Mk1 影片理解模型,比 OpenAI 便宜 9 成

新創 Perceptron 發布影片理解模型 Mk1,API 定價每百萬 token 0.15 美元,宣稱比 Anthropic、OpenAI、Google 便宜 80–90%。Mk1 聚焦看懂影片而非生成影片,主攻工廠安全、安防監控、機器人訓練與內容審核場景,影片 AI 成本戰正式開打。

Perceptron Mk1 聚焦影片理解

Perceptron Mk1 是一款針對影片理解與 embodied reasoning 設計的視覺語言模型,不是單純的影片生成工具。

根據 Perceptron 透過 Business Wire 發布的公告,Mk1 的定位是讓 AI 系統理解真實世界的視覺資料,包括影片、影像、空間關係、物體動態與事件因果。公司把它稱為 physical AI 模型,意思是模型不只讀懂文字或靜態圖片,而是要理解物體如何在時間與空間中移動。

這和大家熟悉的 AI 影片生成不同。像 Google Veo 3.1 影片生成模型主要解決「如何產生影片」;Perceptron Mk1 則更像是解決「如何看懂影片」。一個負責創作,一個負責理解,兩者都屬於影片 AI,但商業落點完全不同。

根據 VentureBeat 報導,Mk1 可以分析長影片、回傳特定時間點、進行密集計數、讀取類比儀表、辨識物件位置,甚至判斷籃球出手是否早於計時器響起。

最大賣點是成本與效能比

Perceptron Mk1 最醒目的主張,是把高階影片理解模型的成本壓到更接近大規模部署的水位。

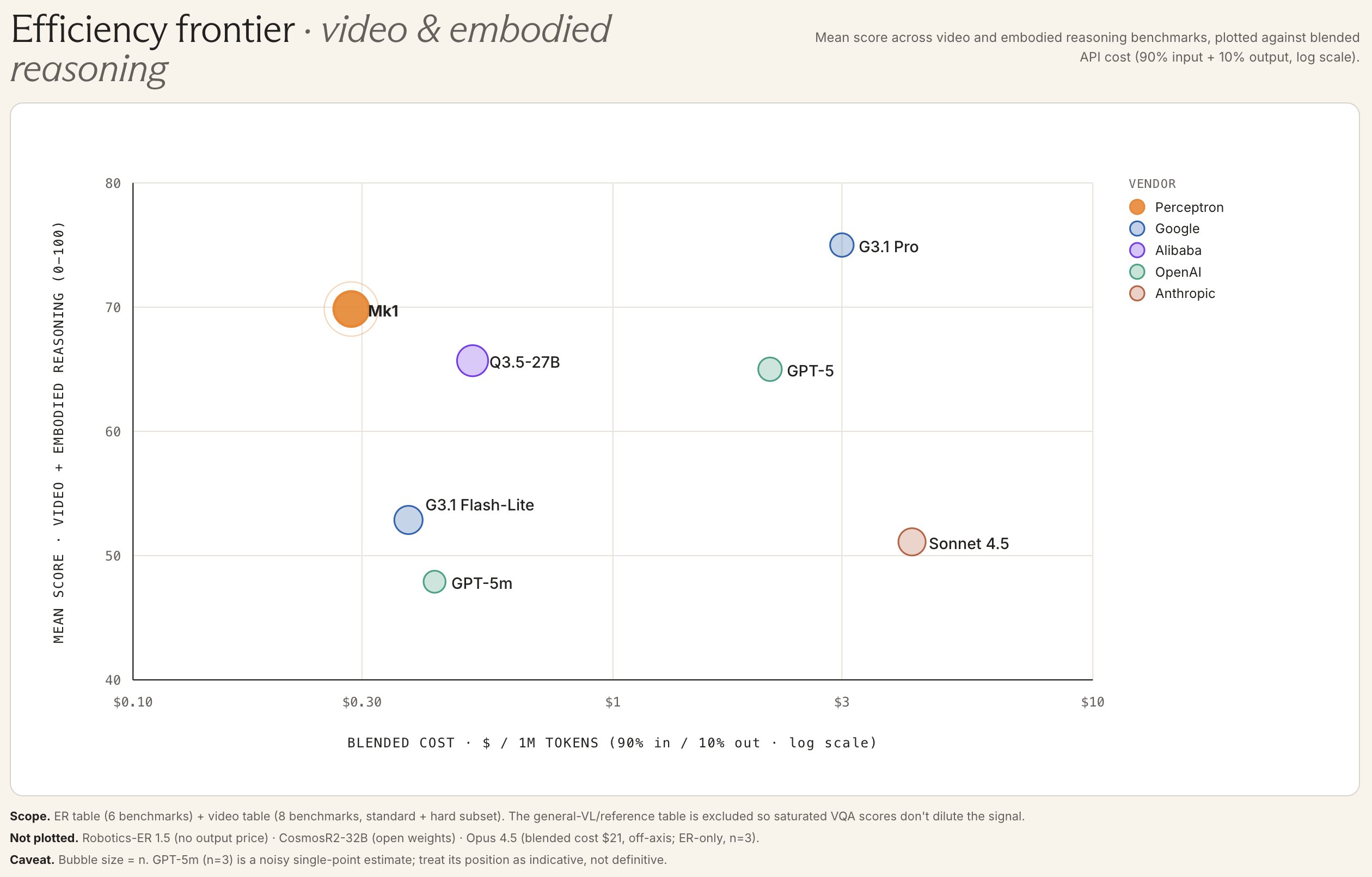

VentureBeat 報導指出,Mk1 的 API 價格為每百萬輸入 token 0.15 美元、每百萬輸出 token 1.50 美元。Perceptron 將它放在所謂 Efficiency Frontier 上比較,宣稱在影片與 embodied reasoning benchmark 上接近或超越部分 frontier model,同時維持更低的 blended cost。

這個價格策略很關鍵。影片資料量遠大於文字,若每次分析直播、監控、工廠產線或長影片都要支付高額推理成本,企業很難把影片 AI 放進日常流程。低成本不代表一定準確,但它會改變試算表:過去只能抽樣分析的影片,可能變成可以持續分析。

| 比較面向 | 一般多模態大模型 | Perceptron Mk1 主張 |

|---|---|---|

| 核心定位 | 通用文字、圖像、影片理解 | 影片理解與 physical AI |

| 成本結構 | 影片分析成本較高 | 每百萬輸入 token 0.15 美元 |

| 主要任務 | 問答、摘要、圖像描述 | 時間推理、物體追蹤、計數、事件偵測 |

| 適用場景 | 通用助理與知識工作 | 工廠、安防、機器人、內容審核、運動剪輯 |

| 主要風險 | 對影片時間軸理解不穩 | 新模型仍需真實資料驗證 |

不過這裡要保守看待。Perceptron 的 benchmark 與價格很有吸引力,但企業採購不能只看公開分數。真正的測試應該回到自己的影片資料:光線、角度、遮擋、鏡頭解析度、工作規則、事件定義都會影響結果。

影片 AI 需要時間推理能力

Perceptron Mk1 的技術重點,是讓模型理解影片中的時間連續性,而不是把影片切成一堆互不相關的圖片。

VentureBeat 報導提到,Mk1 可以用最高 2 FPS 處理原生影片,並支援約 32K token context window。它的目標是維持物體在不同影格中的身份,即使物體短暫被遮擋,也能追蹤事件如何發生。這對安防、機器人、品質檢測與運動剪輯很重要。

企業真正需要的不是「畫面裡有一個人」,而是:這個人是否在進入危險區前戴上安全帽、這個包裹是否從貨架 A 被移到貨架 B、機械手臂是否成功抓取並放下零件、球員是否在哨聲前完成出手。這些問題都不是靜態圖片能完整回答的,需要模型理解時間、位置、順序、物體關係與因果。

對內容產業來說,這類能力也很有用。AI 不只可以生成影片,也可以理解已存在的影片資料庫,幫創作者找出片段、剪輯 highlight、標註角色動作或檢查內容風險。這和 AI 短影音爆紅帶來的內容生產變化形成對照:一邊是生成內容爆炸,另一邊需要更便宜的影片理解工具來整理、審核與再利用內容。

企業場景比展示更重要

Perceptron Mk1 的真正價值,要看它能否進入高頻、低容錯的企業流程。

Perceptron 的公告列出多個應用方向,包括製造與工業安全、媒體內容搜尋、機器人與自動化、地理空間與關鍵基礎設施、安防監控,以及增強 Claude、Codex 等文字型 agent 的視覺能力。這些場景共同特徵是:它們都有大量視覺資料,而且人工檢查成本高。

落地時有兩個難題。第一是錯誤成本:模型漏掉一個影片 highlight 可能只是效率問題,但若漏掉工廠安全風險、錯判監控事件或誤導機器人操作,就可能變成營運與責任問題。第二是整合成本:影片 AI 模型本身只是起點,企業還需要把它接進攝影機、資料管線、權限系統、稽核紀錄與人工審核流程。Perceptron 同步推出 SDK 與 Focus、Counting、In-Context Learning 等功能,就是想降低這一層整合門檻。

Benchmark 應視為測試起點

Perceptron Mk1 的 benchmark 結果值得關注,但還不能直接等同於生產環境可靠性。

VentureBeat 報導指出,Mk1 在 EmbSpatialBench、RefSpatialBench、EgoSchema Hard Subset、VSI-Bench 等影片與空間推理 benchmark 上有強勢表現。例如在 VSI-Bench 中,Mk1 達到 88.5;在 RefSpatialBench 中,VentureBeat 稱它相較部分競品有明顯領先。

比較務實的導入方式應該分三層:用公開 benchmark 判斷模型是否值得進入 pilot;用企業自己的影片建立私有測試集,測試漏報、誤報與時間點準確度;最後進行流程驗證,測試模型如何接人工審核、如何處理不確定情況,以及每個有效事件的實際成本。

Perceptron Mk1 顯示影片 AI 成本戰開始

Perceptron Mk1 的發布,代表影片 AI 的競爭正在從生成效果延伸到理解成本。

過去兩年,市場焦點大多放在 AI 影片生成:誰能做出更逼真的畫面、更穩定的角色、更長的鏡頭。但企業真正擁有最多的,其實不是要生成的新影片,而是已經存在的大量錄影、監控、會議、體育賽事、物流影像與生產線資料。

如果影片理解成本下降,企業就能開始問新的問題:能不能每天分析所有工廠畫面,而不是抽查幾段?能不能自動剪出所有比賽 highlight?能不能讓客服、保險、安防與品質控管系統看懂影片證據?

接下來值得觀察三件事:Perceptron 是否能公布更多可重現的評測與客戶案例;Mk1 在真實企業資料上的誤報與漏報表現;以及 OpenAI、Google、Anthropic、NVIDIA、Qwen 等多模態模型是否會跟進壓低影片理解成本。如果這場成本戰真的打開,影片 AI 會從創作工具往營運基礎設施移動。

想每週掌握最新 AI 工具與趨勢?訂閱 AI 郵報,每週精選重點直送信箱,讓你不錯過任何重要動態。