Claude Managed Agents 推出 dreaming 研究預覽

Anthropic 於 2026 年 5 月 6 日推出 Claude Managed Agents dreaming 研究預覽,讓 AI Agent 能在任務之間回顧過去 session 並整理記憶庫,合併重複、替換過期內容。這不是 AI 有意識,而是企業 Agent 走向長期記憶管理與可治理自我改進的關鍵一步。

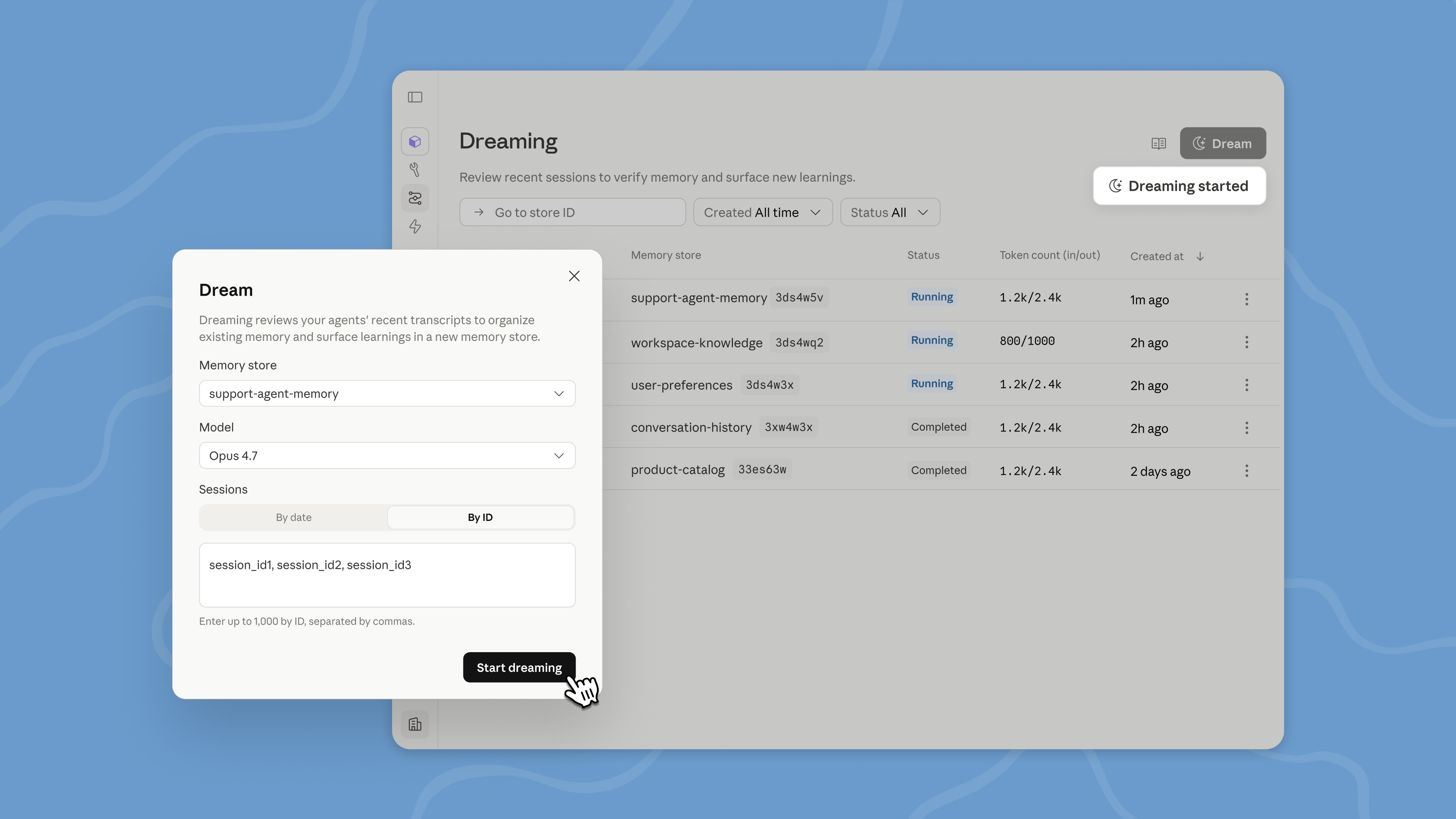

Anthropic 在 2026 年 5 月 6 日宣布,Claude Managed Agents 新增 dreaming 研究預覽功能,讓 AI Agent 能在任務之間回顧過去 session 與 memory store,整理重複、過期或互相矛盾的記憶。這項功能不是讓 AI 真的「做夢」,而是把 Agent 的長期工作紀錄轉化成更乾淨、可審查、可延續的記憶庫。

這則消息值得關注,因為 AI Agent 的競爭焦點正在從「能不能完成單次任務」,轉向「能不能在多次任務中累積經驗、減少重複錯誤、並符合企業治理需求」。對企業來說,Claude Managed Agents dreaming 的重點不是擬人化命名,而是 Anthropic 正試圖補上 Agent 長期運作最難的一塊:記憶管理。

Anthropic 正式推出 dreaming 研究預覽

Claude Managed Agents dreaming 是一個讓 Agent 回顧過去工作紀錄並整理記憶的研究預覽功能。根據 Anthropic 官方公告,dreaming 會檢查 agent sessions 與 memory stores,找出工作模式,並整理出更有用的記憶,幫助 Agent 在後續任務中表現更穩定。

這次發布發生在 Anthropic 的 Code with Claude 開發者活動期間。Reuters 報導指出,dreaming 是 Anthropic 推動企業客戶採用 Agent 工具的一部分,也和 Claude Code 這類 coding agent 的需求成長有關。

這次更新的核心重點可以拆成三件事:

- dreaming 是 Research Preview:目前不是全面開放的正式功能,需要申請或符合 Claude Platform 的測試條件。

- dreaming 面向 Managed Agents:它不是一般 Claude 聊天功能,而是給開發者建立可長時間執行任務的 Agent 基礎設施。

- dreaming 強調可審查記憶:Anthropic 表示,使用者可以選擇讓 dreaming 自動更新記憶,也可以先審查變更再決定是否採用。

這也說明 Anthropic 對企業 AI Agent 的策略:不只是推出更強模型,而是把記憶、分工、評估與工作流管理包進 Claude Platform。這和 Claude Cowork Dispatch 的遠端工作流方向一致,都是把 Claude 從「對話工具」推向「可交辦任務的數位工作系統」。

dreaming 的運作方式是整理記憶

dreaming 是指 Claude 在任務之外,讀取既有記憶庫與過去 session,重新整理出新的 output memory store。根據 Claude API 文件,一個 dream 會讀取預先存在的 memory store,並可選擇加入最多 100 個過去 sessions,最後產生一個新的記憶庫輸出。

這裡最重要的設計,是 dreaming 不會直接覆蓋原本的 input memory store。文件說明,dream 的輸出會是另一個獨立 memory store,因此開發者可以先檢查結果,如果不滿意,也能丟棄輸出。

對企業而言,這個細節比功能名稱更重要。因為在金融、法律、醫療、顧問、軟體開發等情境中,Agent 的記憶如果被自動改寫,可能會帶來風險。Anthropic 採用「產生新記憶庫,再讓人或系統決定是否採用」的方式,讓 Claude Managed Agents dreaming 更接近可治理的企業功能。

| 項目 | 傳統 Agent 記憶 | Claude Managed Agents dreaming |

|---|---|---|

| 記憶更新方式 | 任務中逐步寫入,容易零碎累積 | 任務之間回顧整理,重新組織記憶 |

| 常見問題 | 重複、過期、互相矛盾 | 合併重複資訊,替換過期內容 |

| 審查方式 | 可能難以追蹤每次變更 | 產生新的 output memory store,可先審查 |

| 適合場景 | 短期任務、單次互動 | 長流程工作、多 session 任務、企業 Agent |

| 主要價值 | 記住局部上下文 | 萃取長期模式並改善後續任務 |

如果把 AI Agent 當成企業流程的一部分,dreaming 的價值就很清楚:它讓 Agent 不只是「記住更多」,而是「整理得更好」。這也是 自進化 AI Agent討論中最核心的能力之一,因為真正可用的 Agent 不能每次都從零開始,也不能把錯誤經驗原封不動地累積下去。

dreaming 不是 AI 有意識

dreaming 不是 AI 真的擁有夢境或意識,而是一個記憶整理與模式萃取流程。這點需要特別說清楚,因為 AI 公司近年常使用「記憶」、「推理」、「代理」、「做夢」等接近人類認知的詞彙,容易讓一般使用者誤以為模型具備人類式的內在經驗。

Wired 在 2026 年 5 月 7 日的評論就批評,AI 公司用人類心理活動命名功能,可能加深使用者對 AI 能力的誤解。這個提醒很重要,因為 Claude Managed Agents dreaming 的實際作用,是分析過去任務紀錄並更新記憶結構,而不是產生任何主觀感受。

更精準的說法是:dreaming 是一種背景整理程序。它會把 Agent 曾經做過的事、常犯的錯、使用者偏好、團隊流程與常見模式,轉換成比較適合後續任務使用的記憶。

這種設計的價值不在於讓 AI 更像人,而在於讓 AI Agent 更適合長期工作。當企業把 Agent 放進客服、程式維護、研究、財務審核或知識管理流程時,真正需要的是可控、可查、可回滾的記憶系統,而不是神秘化的「AI 內心世界」。

Managed Agents 正成為 Anthropic 的平台策略

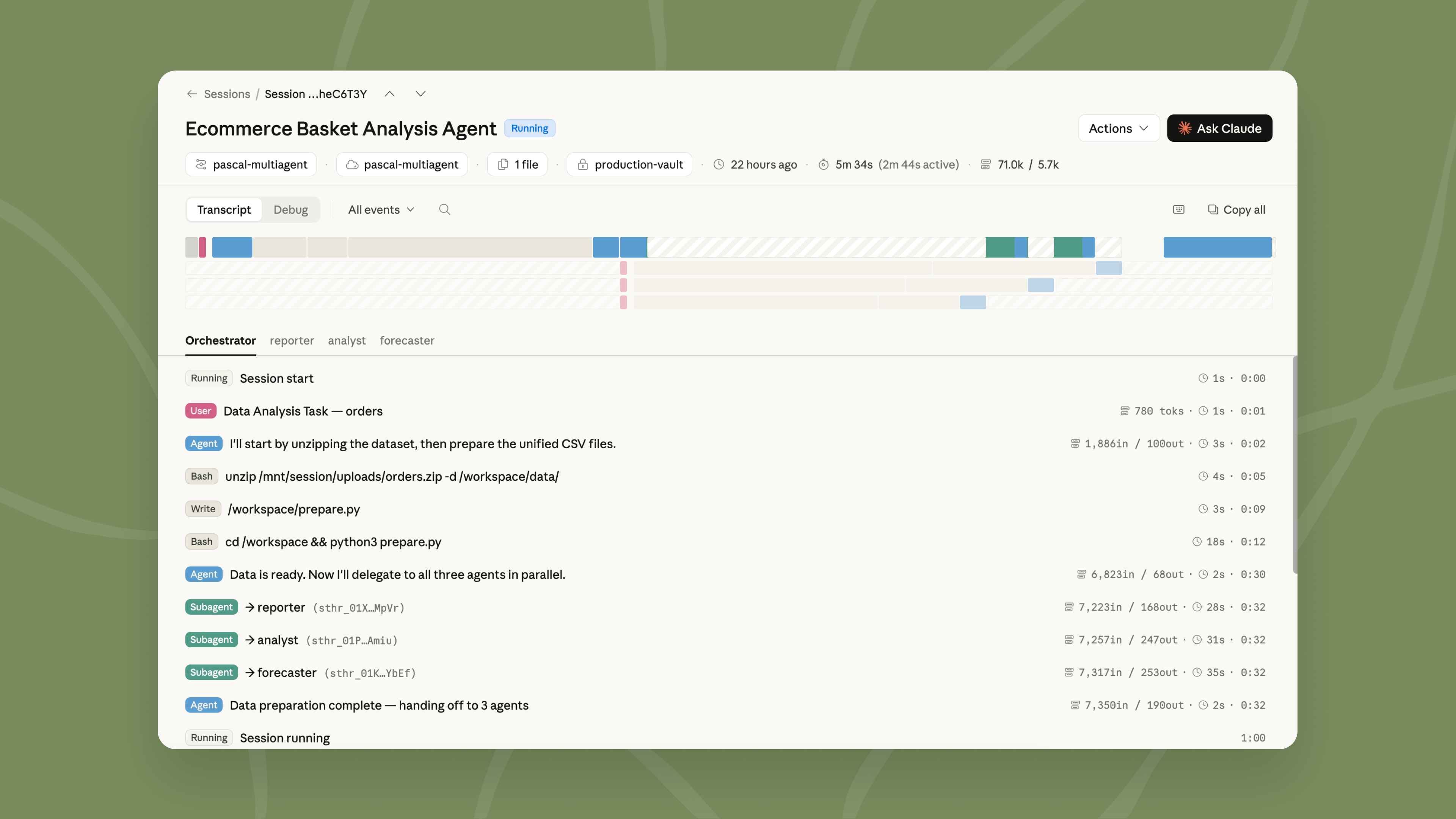

Claude Managed Agents dreaming 顯示 Anthropic 正把 Agent 從單一模型能力,推向完整平台能力。這次官方公告不只提到 dreaming,也同步提到 outcomes、multiagent orchestration 與 webhooks,代表 Anthropic 想讓開發者建立更能長時間執行、分工協作、並檢查成果品質的 Agent。

Image Credits: Anthropic

dreaming 負責長期記憶整理,outcomes 負責設定成功標準,multiagent orchestration 負責把複雜任務拆給 specialist agents,webhooks 則讓外部系統能接收 Agent 狀態與事件。這些功能組合起來,才是企業 Agent 真正需要的基礎設施。

這也讓 Claude Managed Agents 與一般聊天機器人拉開差距。一般 AI 工具多半解決「這次對話要回答什麼」,Managed Agents 則處理「這個任務如何跨時間、跨工具、跨角色完成」。這和 Gemini Enterprise Agent Platform背後的趨勢相同:大公司正在把 AI Agent 打造成企業級平台,而不是單一功能。

| 功能 | 主要作用 | 對企業的意義 |

|---|---|---|

| dreaming | 整理過去 sessions 與 memory stores | 讓 Agent 累積經驗並降低重複錯誤 |

| outcomes | 定義任務成功標準與評估方式 | 讓 Agent 輸出更容易被檢查 |

| multiagent orchestration | 將複雜任務分派給多個 specialist agents | 提升長流程任務處理能力 |

| webhooks | 將 Agent 狀態與事件回傳外部系統 | 更容易整合進企業工作流 |

這代表企業 AI Agent 的競爭正在進入下一階段。未來廠商比的不只是模型分數,而是誰能提供更完整的記憶、權限、評估、協作與審計能力。Claude Managed Agents dreaming 正是 Anthropic 在這條路上的重要一步。

企業導入需要同時看見機會與風險

Claude Managed Agents dreaming 的最大機會,是讓企業 Agent 更接近可以長期合作的數位同事。當 Agent 能在任務之間整理經驗,企業就有機會減少重複提示、降低交接成本,並讓 Agent 更理解團隊偏好。

不過,這項功能也帶來新的治理問題。Agent 從過去任務中萃取的記憶,可能包含錯誤偏好、過期流程、敏感資訊或不該被長期保留的內容。即使 Anthropic 設計了可審查的 output memory store,企業仍需要建立自己的資料保留、權限控管與審核流程。

後續值得觀察的重點包括:

- 企業是否願意讓 Agent 長期保存工作記憶:尤其是金融、法務、醫療與資安場景,記憶保存本身就是治理議題。

- dreaming 能否真正降低錯誤率:功能名稱吸睛,但關鍵仍是實際任務品質是否提升。

- 人類審查會不會成為瓶頸:如果每次記憶更新都要人工檢查,導入效率可能受限。

- Anthropic 如何界定安全邊界:Agent 自我改進聽起來強大,但企業更需要可預測、可回溯、可停止的系統。

整體來看,Claude Managed Agents dreaming 是一個重要訊號:AI Agent 正從「會做事」走向「會累積工作經驗」。但越接近長期自主工作,越需要清楚的審查、權限與治理機制。對企業而言,這不是單純升級功能,而是重新設計人與 AI Agent 協作方式的開始。

想每週掌握最新 AI 工具與趨勢?訂閱 AI 郵報,每週精選重點直送信箱,讓你不錯過任何重要動態。

資料來源

- Anthropic 官方公告:New in Claude Managed Agents dreaming outcomes and multiagent orchestration

- Claude API 文件:Dreams

- Reuters via Yahoo Tech:Anthropic unveils dreaming feature to help its AI agents self improve

- Ars Technica:Anthropic's Claude Managed Agents can now dream sort of

- Wired:I Am Begging AI Companies to Stop Naming Features After Human Processes