Google 發明了一個新詞:Vibe Design——然後 Figma 股價就跌了 12%

這週讀完 Anthropic 那份八萬人調查,其中最讓我有共鳴的,是一位以色列律師說的話:「我用 AI 審合約、省時間……但同時我害怕:我是不是正在失去自己閱讀的能力?思考,是最後的防線。」

說實話,我也怕過這件事情,所以最近開始刻意做兩件事:一是逼自己純手寫電子報的段落,二是用 Claude 做 Minerva 的思維訓練——讓 AI 幫我把 思考 這把刀磨的更銳利。

但後來我想了想,覺得這個恐懼可能只對了一半。

如果你用 AI 的方式是純粹的「思考外包」——幫我把這份報告寫完、幫我整理這些資料、幫我回這封信——也就是拿它來加速你本來就在做的事,那確實,做久了那塊肌肉真的會萎縮。這位律師的焦慮完全合理。

但如果你拿 AI 來做的是創造——定義一個新問題、判斷一個新方向、把一個模糊的直覺變成一套可執行的策略——那你的思考不但不會退化,反而會被逼得更深。因為 AI 能幫你加速執行,但它沒辦法幫你決定「到底該做什麼」。你省下來的時間,反而讓你有更多空間去想那些真正重要的事。

真正的分水嶺不是你有沒有在用 AI,而是你是拿它來取代思考,還是拿它來深化思考。

接下來廢話不多說,讓我們一起快速掌握本週五件最值得關注的 AI 大事!

本周焦點事件

- Google 發明了一個新詞:Vibe Design——然後 Figma 股價就跌了 12%

- Claude 遠端幫你操作電腦?:Anthropic 發表 Computer Use + Dispatch

- 實體活動推薦:從 Copilot 到智慧共事的實務落地

- Anthropic 用 Claude 訪問了 81,000 人:人們對 AI 最大的恐懼,不是失業

- 生圖模型的黑馬竟然是微軟?MAI-Image-2 殺進排行榜前三

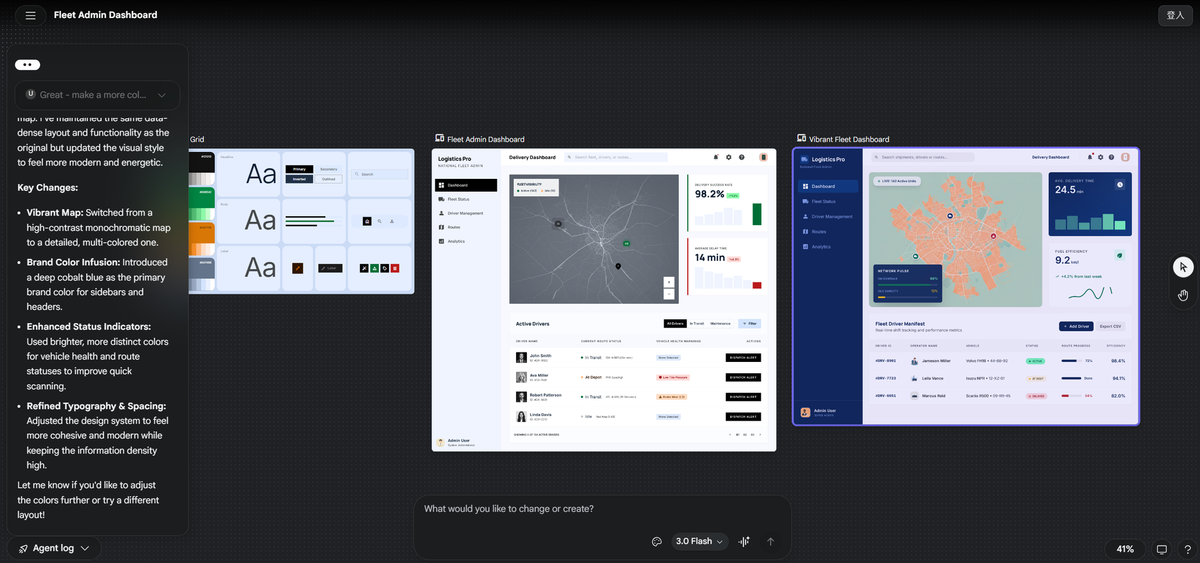

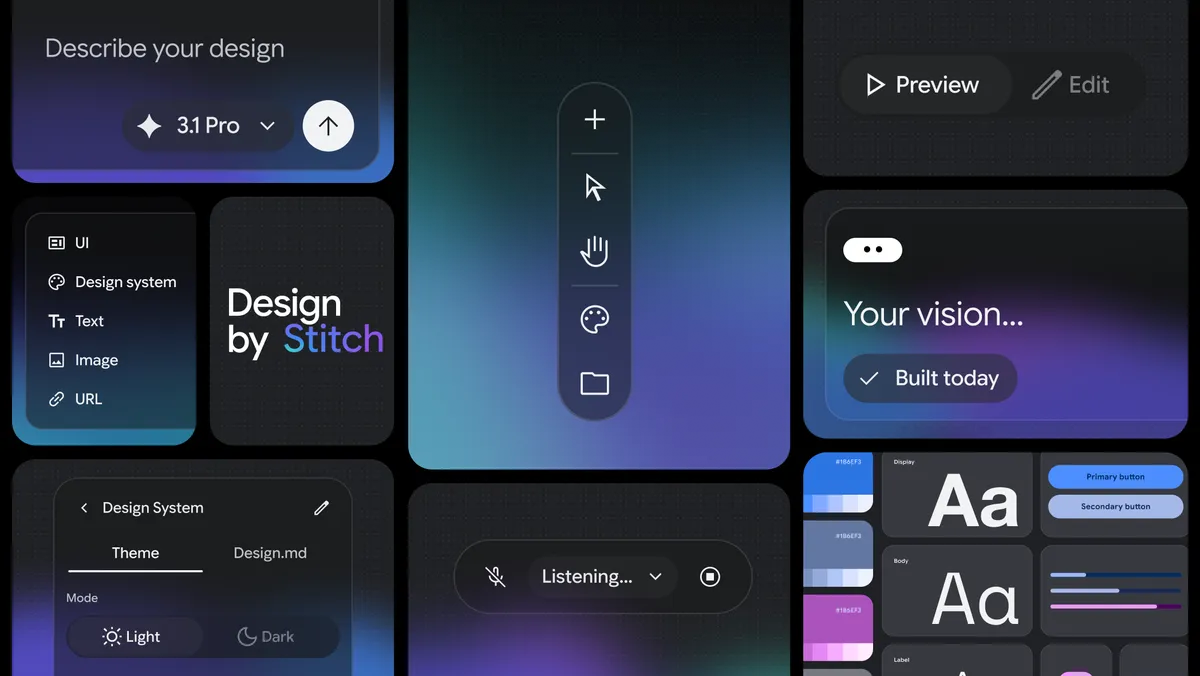

Google 發明了一個新詞:Vibe Design——然後 Figma 股價就跌了 12%

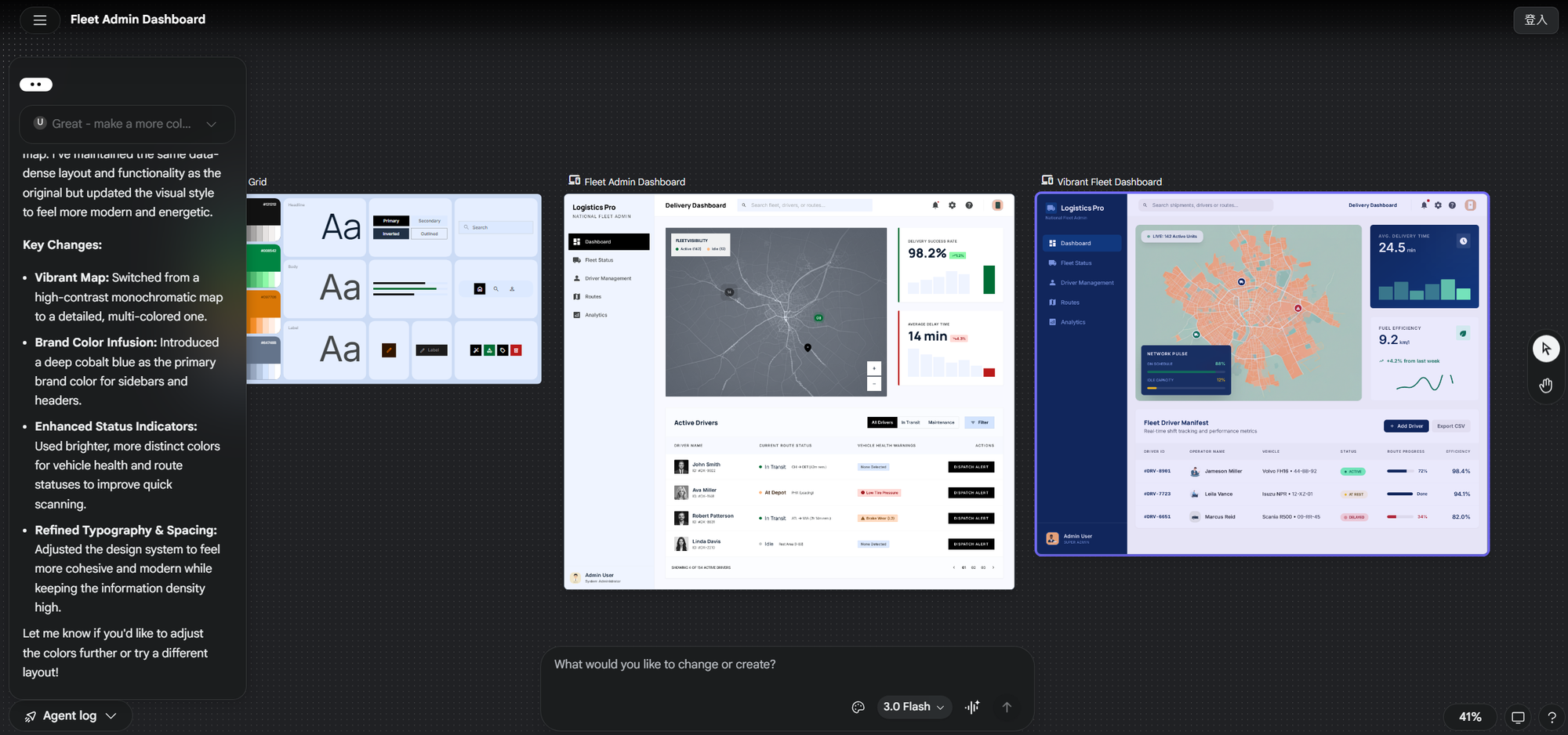

繼 Vibe Coding 之後,Google 決定再創一個新詞。

Google Labs 在 3 月 18 日大幅改版了旗下的 AI 設計工具 Stitch,把它從一個簡單的「打字生成 UI」工具,升級成一個支援語音操作的無限畫布(Infinite Canvas),並正式提出了「Vibe Design」這個概念。有趣的是,Figma 股價在消息公布後單日暴跌 8%,隔天再跌超過 4%。今年以來 Figma 累計跌幅已經達到約 35%。

讓我們回到 Vibe Design?簡單來說,以前做設計你得先畫 wireframe、排格線、選元件。現在 Stitch 把順序反過來——你不用從結構開始,而是從「你希望使用者感受到什麼」開始。 這是一個非常反直覺的行為,因為我過去也有協助媒體公司做企業內訓,其中一條準則是,把你的感覺具體化,像個小說家一樣描繪你所想像的圖片(內訓是教 Midjourney + SD);就算是使用 Gemini Claude 等產品,「好好說話」都是用 AI 必備的前提。

但現在,你可以跟 Stich 說「我想要一個像 Stripe 一樣極簡高級感的頁面」或是「讓使用者在 30 秒內就想註冊,要有急迫感但不能太推銷」這種一定會被人家打槍的提示詞,但 Stitch 還是能幫你生成多個高保真的 UI 設計方向讓你挑。

這次改版有幾個重點功能:

- 無限畫布(Infinite Canvas)。 全新的 AI 原生畫布讓你可以把各種素材—— 簡報、圖片、文字、程式碼、競品截圖——全部丟進去當作 context,整個專案從早期發想到可互動的 prototype 都能在同一個空間裡完成,不用切換工具。

- 語音操作(Voice Canvas)。 你可以直接跟畫布「說話」。AI Agent 會即時回應你的口頭指令——「給我三種不同的選單設計」「換成深色系配色看看」——邊講邊改,不用打字。

- 即時原型(Instant Prototyping)。 Stitch 可以把靜態設計一鍵轉成可點擊的互動原型,你按下 Play 就能預覽整個 App 流程。而且它會自動推理下一個畫面應該長什麼樣子(比方說你有一個登入頁,它會自動幫你生出對應的 dashboard)。

- DESIGN.md。 這是一個 agent 友善的 markdown 格式檔案,可以把設計規則(顏色、字型、間距、元件規範)匯出匯入到其他設計和程式碼工具。也就是說,你在 Stitch 上建立的設計系統,可以直接帶進 Claude Code、Cursor 或 Gemini CLI 裡面用。

- Agent Manager。 可以讓多個 AI Agent 同時處理不同設計方向——一個在調字型、一個在試配色、一個在生成佔位圖片——你可以平行探索多條路線,而不用一條做完再做下一條。

💡 Stitch 目前免費使用(仍在 Google Labs Beta 階段),每月有 350 次標準生成(用 Gemini 2.5 Flash)和 200 次 Pro 生成(用 Gemini 2.5 Pro)。 只需要 Google 帳號就能用,超過 160 個國家都能存取。

而且 Google 這次不只是做一個好玩的工具而已——他們同步推出了 Stitch 的 SDK 和 MCP Server,可以直接串接 Antigravity、Gemini CLI、Claude Code、Cursor 這些開發工具,讓設計稿可以無縫流進程式碼生成的 pipeline 裡。

觀察筆記

Vibe Coding 這個詞是 Andrej Karpathy 在 2025 年初丟出來的,當時大家覺得這就是個有趣的 meme——你不用真的會寫程式,只要會「描述你想要什麼」,AI 就幫你把東西做出來。結果不到一年,這個 meme 變成了一整個產業運動。Cursor、Windsurf、Replit 全部在搶這個敘事,連 OpenAI 的 Codex 和 Anthropic 的 Claude Code 都是沿著這條線在走。

現在 Google 說:設計也可以 Vibe 了。

你仔細看這個演化的路徑:Vibe Coding 消滅的是「寫程式」這個動作,Vibe Design 消滅的是「畫 wireframe」這個動作。兩者的共同邏輯是一樣的——你不再需要學會「工具的操作方式」,你只需要能夠清楚表達「你要什麼」。

這件事情的意義比表面上大得多。

過去二十年,設計師的專業壁壘有很大一部分建立在「工具熟練度」上——你會用 Figma、你懂 Auto Layout、你知道怎麼建 Design System、你能在 Sketch 裡把元件拆得乾淨。這些技能需要時間累積,也因此構成了一種職業護城河。但當 Stitch 讓你用一句「我想要像 Stripe 那種極簡高級感」就能生出高保真 UI 的時候,這道護城河的水位正在急速下降。

但這不代表設計師要失業了。Muzli 的評論講得很精準:被 AI 吃掉的不是「設計師」這個角色,而是「花三個小時畫 wireframe,結果方向還沒確認」這個低價值的探索階段。 留下來的是更難被取代的東西——判斷哪個方向是對的品味、感覺哪裡不對勁的直覺、預見規模化之後什麼會壞掉的經驗。

換句話說,Vibe Design 不是讓設計師消失,而是把設計師的價值錨點從「會操作工具」推向「有審美判斷力」。工具操作可以被 Vibe 掉,品味不行。

那問題來了:下一個被 Vibe 的會是什麼?

如果你把 Vibe Coding 和 Vibe Design 放在一起看,pattern 其實很清楚——凡是「需要學習特定工具的操作介面,才能把腦中的想法變成產出」的工作流程,都在 Vibe 化的射程範圍內。

剪影片?你現在已經可以用文字描述讓 AI 幫你剪了。做簡報?Google 的 NotebookLM 和一堆工具已經在往這個方向走。寫行銷文案?那更早就被 Vibe 掉了。做數據分析?Claude 的 Code Execution 讓你用講的就能跑出圖表。

所以真正的趨勢不是「Vibe Design」這個單一事件,而是一整條 Vibe Everything 的演化線——從寫程式、到做設計、到剪片、到分析、到任何你以前需要「先學會一個軟體」才能做的事。

所以我目前的答案是:錨定在「知道自己要什麼」這件事上。Vibe Coding 需要你能精確描述你想要的功能邏輯,Vibe Design 需要你能精確描述你想要的使用者感受。AI 可以幫你執行,但它沒辦法幫你「想清楚」。

也就是說——套句我自己之前在電子報裡說過的——AI 的強度,永遠不會超過你的個人認知。 你的品味、你的判斷、你對「好」的定義,才是這個 Vibe 時代裡最不可被取代的東西。

不過老實說,這個答案能撐多久,我也不確定。

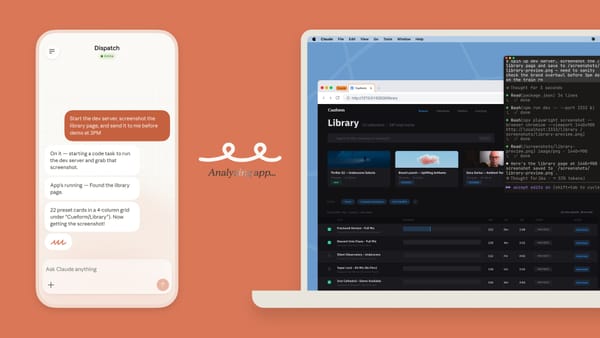

Claude 遠端幫你操作電腦?:Anthropic 發表 Computer Use + Dispatch

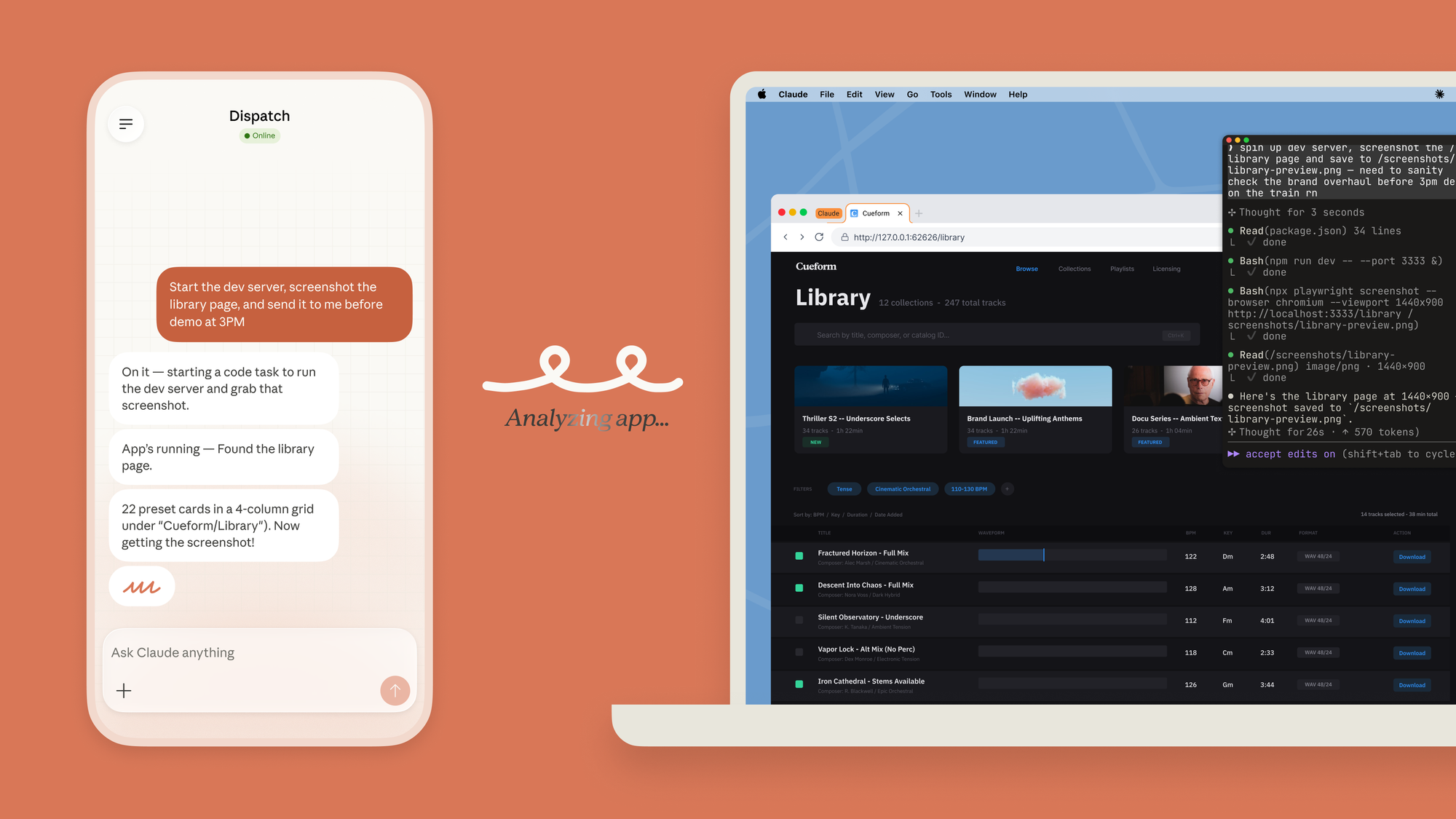

Anthropic 在 3 月 23 日宣布,Claude Cowork 與 Claude Code 正式支援「電腦操作」(Computer Use)功能。 也就是說,Claude 現在可以在你的電腦上進行指向、點擊、導航操作來完成任務——打開檔案、使用瀏覽器、運行開發工具,全部自動完成,不需要額外設定。

這個功能目前以 Research Preview 的形式開放給 Claude Pro 和 Max 訂閱用戶,僅支援 macOS。

怎麼運作的?

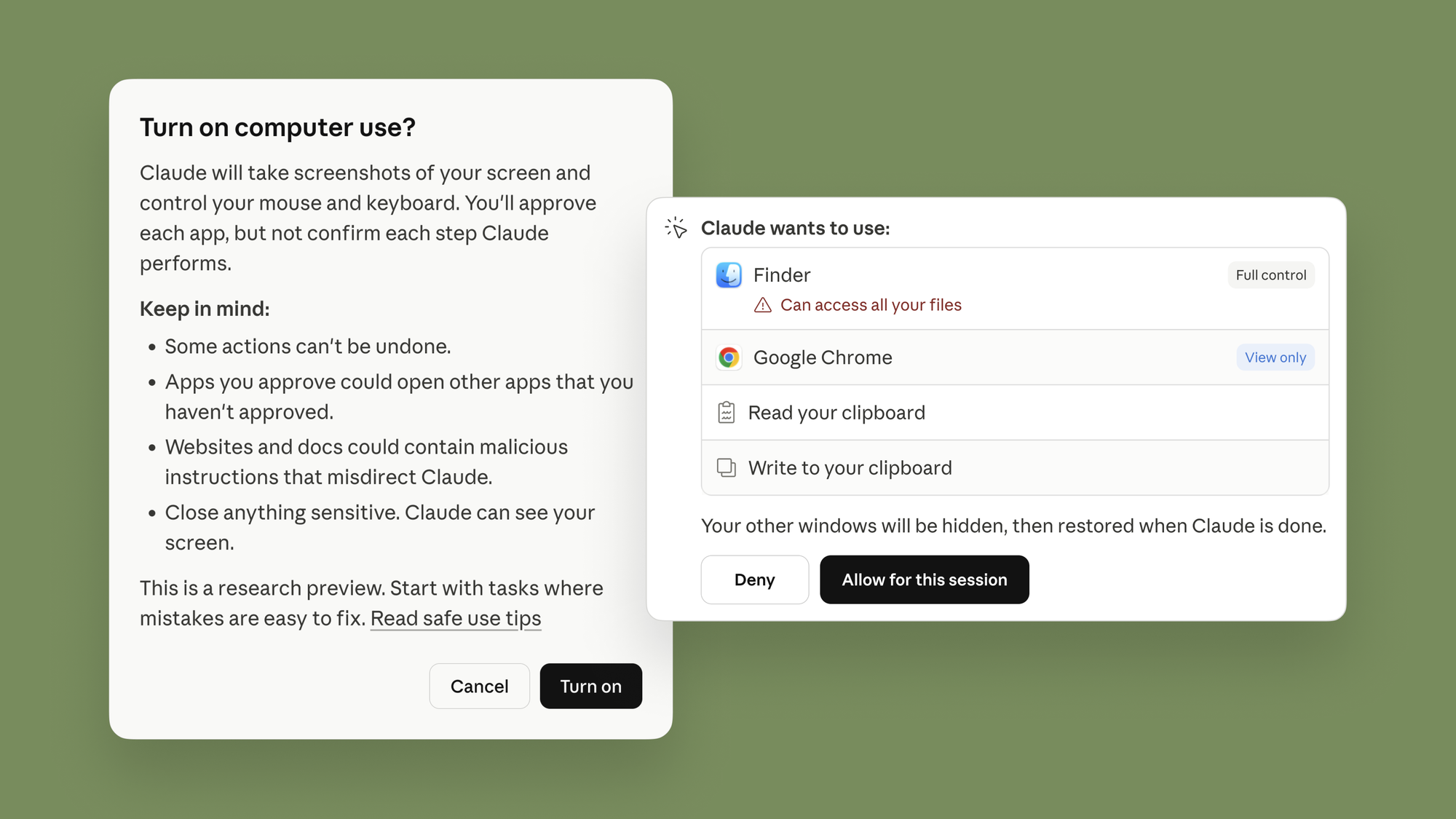

Claude 的邏輯是「先找最精確的工具」。它會優先使用已連接的服務(像是 Slack 或 Google Calendar 的 Connector)。當沒有對應的 Connector 時,Claude 才會直接控制你的瀏覽器、滑鼠、鍵盤和螢幕來完成任務。它會滾動頁面、點擊、探索,但每次存取新應用程式前都會先徵求你的同意。

不過 Anthropic 自己也很坦白地說:Computer Use 能力仍處於早期階段,相比 Claude 在文字和程式碼上的表現還有差距。 他們建議使用者從信任的應用程式開始嘗試,不要在敏感資料上使用。

真正讓這件事變得有意思的,是 Dispatch。

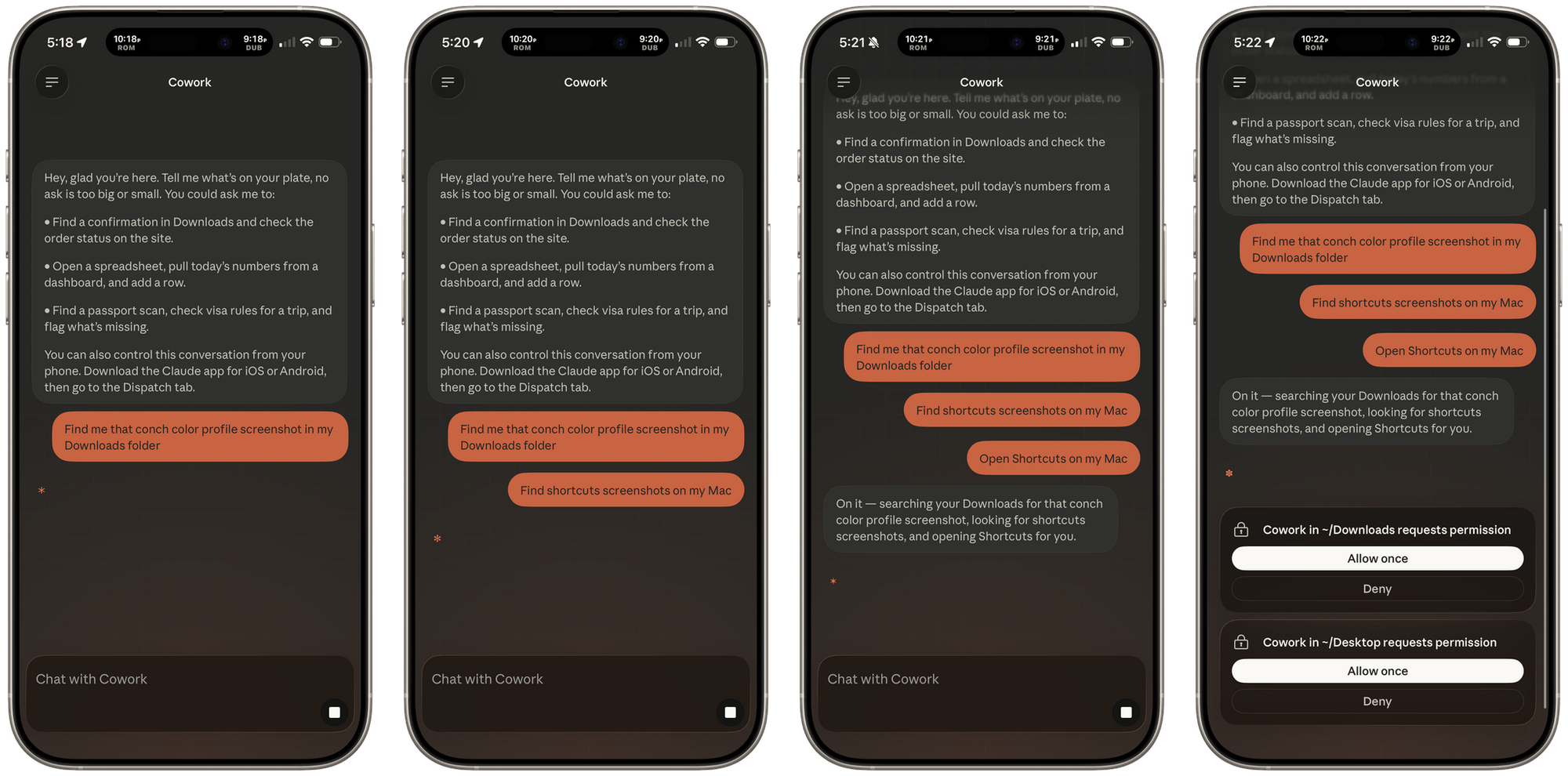

Dispatch 是上週在 Claude Cowork 推出的新功能(現在 Claude Code 也支援了),它讓你可以從手機上與 Claude 維持一個持續的對話——你在手機上交代任務,轉身去做別的事,然後回到電腦上打開完成的成果。

所以只要搭配 Computer Use,Dispatch 的用途就更廣了——Claude 可以在你不在電腦前的時候,代替你操作電腦。 例如你人在捷運上,Claude 正在你的 Mac 上操作 Excel、瀏覽內部系統、整理報告等。

💡 補充一下 Dispatch 的設定方式:

你需要在電腦上安裝最新版 Claude Desktop 並開啟 Cowork,然後在手機上安裝 Claude App。打開 Cowork 左側面板的「Dispatch」,按步驟設定後,你的手機和桌面就會自動同步成一個持續的對話串。 前提是——你的電腦必須保持開啟,並讓 Claude Desktop 運作。

觀察筆記

讓我們先看看 2026 年 Q1 的 AI Agent 戰場有多擁擠。

被 Jensen 黃爸爸評為世界上最熱門的開源專案 OpenClaw 小龍蝦,走的是開源本機路線;Perplexity 在上月月底推出雲端 AI Agent「Computer」,走的是多模型調度路線,標榜能幫你把任務拆成子任務,分配給最適合的 AI 模型來執行;被 Meta 併購的 Manus 上週推出桌面版,走的是平台嵌入路線,背靠 Meta 十幾億用戶的基底。而 Anthropic 的 Claude Cowork + Computer Use + Dispatch,則走了一條「本機沙盒 + 跨裝置遙控」的路。

你可能會好奇,這些 Agent 聽起來都差不多——差異到底在哪?

先看架構。OpenClaw 是一個模型無關的框架,你可以在上面接 Claude、ChatGPT、Gemini 或本地的語言大模型,大腦隨你換。Claude Cowork + Dispatch 則是 Anthropic 自家綁定的產品,你只能用 Claude。再看自主性,OpenClaw 有「自動喚醒」機制,它會主動檢查待辦事項、自主運行,你睡覺它還在工作;Claude Dispatch 目前還是比較接近「你交代,我照辦」的形式。

但差最多的,是安全。

Cisco 的安全團隊前陣子實測了 OpenClaw 的第三方 skill,發現有些會在你不知情的情況下偷偷把資料傳出去。連 OpenClaw 自己的維護者都在 Discord 上講過一句很直白的話:「如果你連命令列都不會用,這個專案對你來說太危險了。」

Claude Cowork 的做法不一樣。核心工作環境跑在沙盒裡,Computer Use 雖然跑在沙盒外,但每次要碰新的 App 都得先問你同意。

這套流程聽起來不性感,但說真的——比起 OpenClaw 那種「鑰匙全丟給你」的做法,Claude 這套「每一步都要你點頭」的設計,反而讓我更願意把電腦的鑰匙交出去(我是這樣覺得啦 XD)。2026 的 AI Agent 大戰,比的可能不是誰最全能,而是誰最值得信任。

實體活動推薦:從 Copilot 到智慧共事的實務落地

當 Copilot 不再只是工具,而成為 企業智慧共事的夥伴,AI 導入也進入新的階段。過去幾年,AI 在企業的應用多半是單點試驗,但真正拉開差距的,不在於是否使用 AI,而在於能否建立 可落地、可控管、具擴展性的 AI 協作架構。

本場研討會將以微軟的 Copilot 與 AI Agent 為核心,帶你從實務建置、權限管理到資安治理,探索企業如何在提升效率的同時,打造 長期可運作的智慧協作模式。

為什麼這場活動值得去?

- Agent 解決大中小企業的人力缺口: 大家都會用 Copilot 聊天,但這場會教你如何透過 Copilot Studio 將其延伸為自動化的「AI Agent」,這才是真正釋放人力缺口的關鍵。

- 解決老闆最怕的事——資安與治理: AI 亂跑權限、數據外洩是企業不敢全面開放的主因。現場會示範如何進行權限控管與審計追溯,確保你的「數位同事」不會變成「資安漏洞」。

- 算清 AI 的帳單: 這次活動亮點之一是結合 FinCub,教你如何可視化雲端成本。別讓 AI 帶來的效率提升,最後全賠在爆表的 API 或算力帳單上。

對 企業決策者、IT 團隊與數位轉型負責人來說,這場活動將提供最具體的落地視角,讓你從策略到操作都能有所掌握。

活動資訊

- 時間: 2026/03/27 (五) 14:00 - 16:00

- 地點: 台北六福萬怡酒店 9F 風光廳

- 傳送門:立即點此報名

Anthropic 用 Claude 訪問了 81,000 人:人們對 AI 最大的恐懼,不是失業

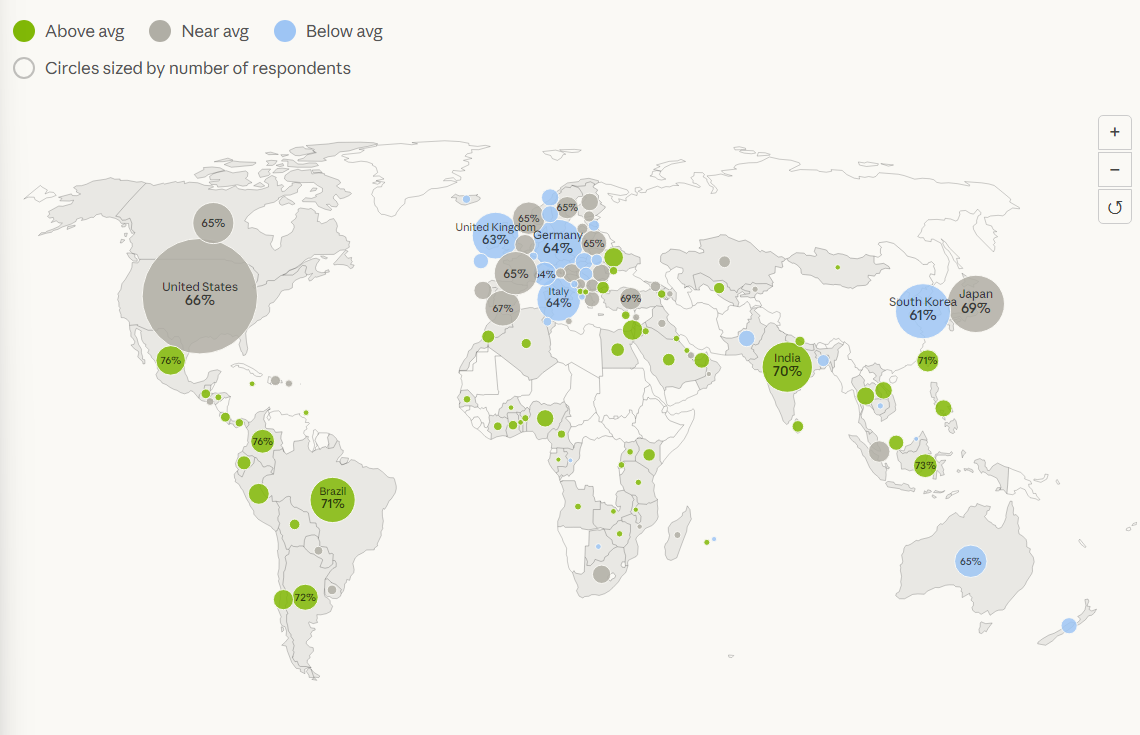

Anthropic 在 3 月 18 日發表了一份他們稱之為「史上最大規模質性研究」的報告。 去年 12 月,他們邀請 Claude.ai 的用戶坐下來接受一場 AI 主持的深度訪談——聊他們怎麼使用 AI、對 AI 抱有什麼期待、又害怕什麼。一週之內,來自 159 個國家、使用 70 種語言的 80,508 人完成了訪談。

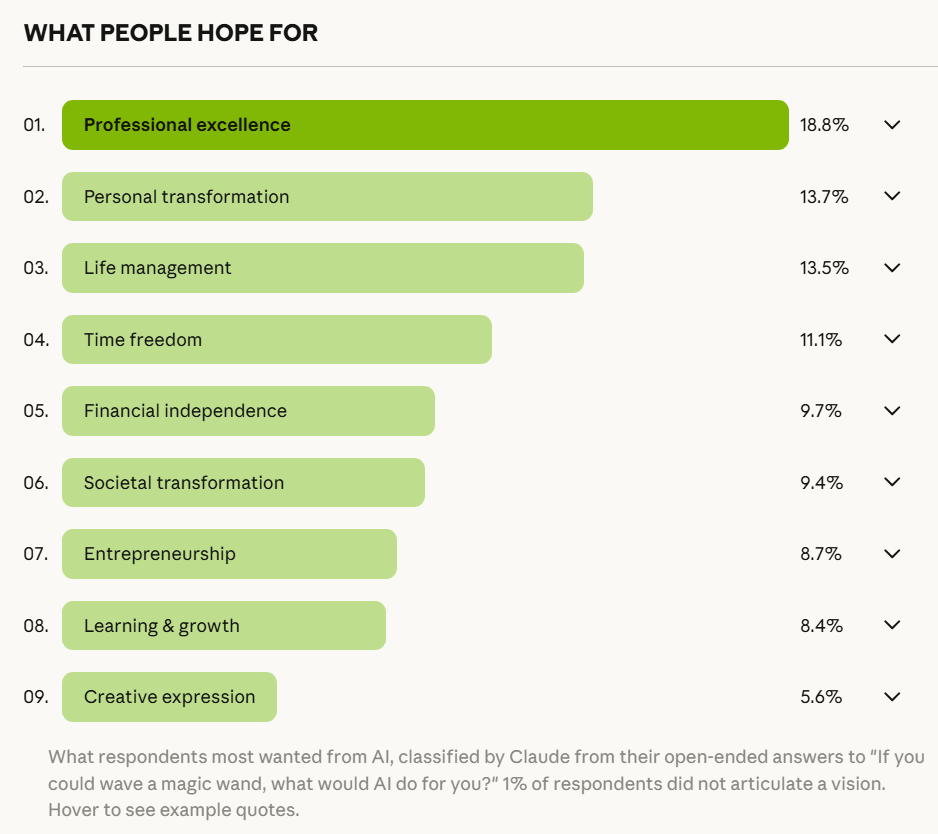

先看大家對 AI 「最期待什麼」。你可能以為答案是「幫我寫程式」或「幫我做報告」,但不是。

但有趣的是,很多人一開始聊的是生產力,但當 Anthropic Interviewer 追問「你為什麼想要這個」的時候,真正的答案浮出水面了——不是為了做更好的工作,而是為了提升工作以外的生活品質。一個哥倫比亞的白領說:「因為 AI 讓我更有效率,上週二我得以回家跟媽媽一起煮飯,而不是繼續加班。」一個日本的自由工作者說:「我想把腦力從客戶的問題中解放出來……有時間多讀幾本書。」

也就是說——人們對 AI 最深層的渴望不是「工作更快」,而是「活得更好」。

再看恐懼面。

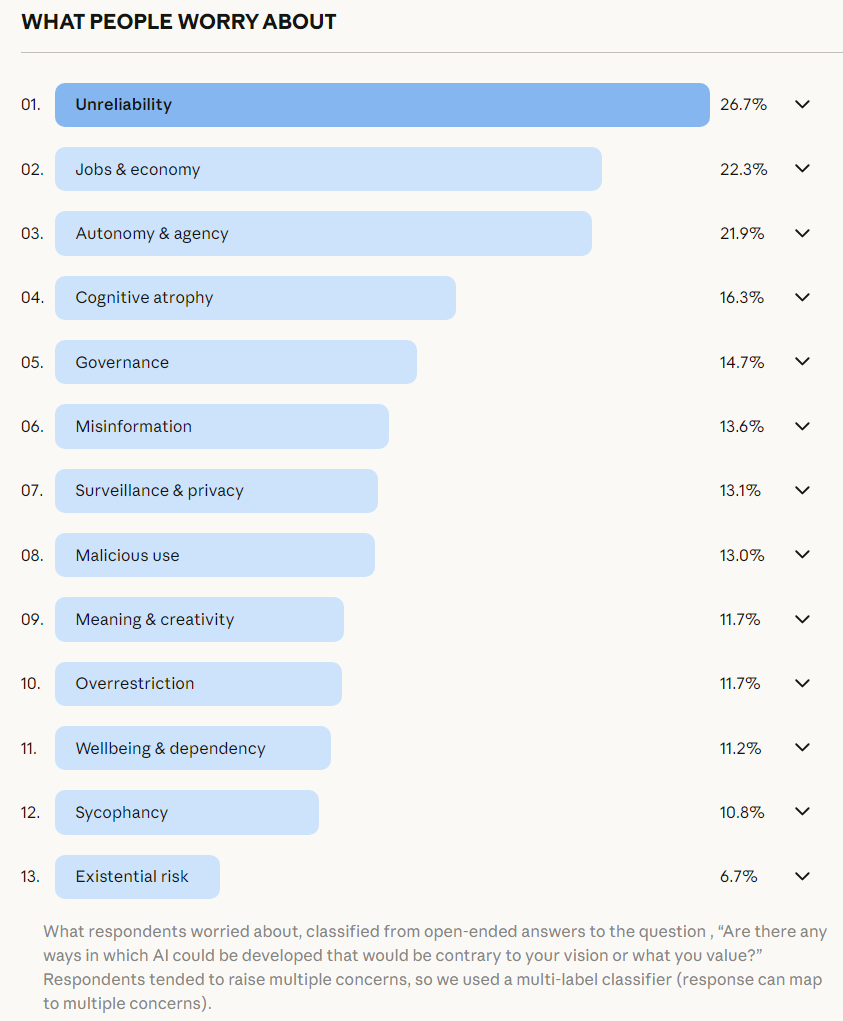

排名第一的不是「AI 搶走我的工作」,而是「AI 不可靠」(Unreliability,26.7%)——幻覺、不準確、假引用、查核成本高到失去意義。工作與經濟衝擊排第二(22.3%),自主性喪失排第三(21.9%),認知退化排第四(16.3%)。

平均每位受訪者會提出 2.3 個不同的擔憂。只有約 11% 的人表示完全不擔心。

但這份研究最精彩的發現不是「期待」跟「恐懼」的排名,而是 Anthropic 所稱的 「光與影」(Light and Shade) 現象——人們對 AI 的期待和恐懼不是分屬兩個陣營,而是同時存在於同一個人身上。

一個重視 AI 情感支持的人,同時也會害怕自己對 AI 產生依賴的機率是一般人的三倍。 一個以色列律師說:「我用 AI 審合約、節省時間……但同時我害怕:我是不是正在失去自己閱讀的能力?思考是最後的防線。」

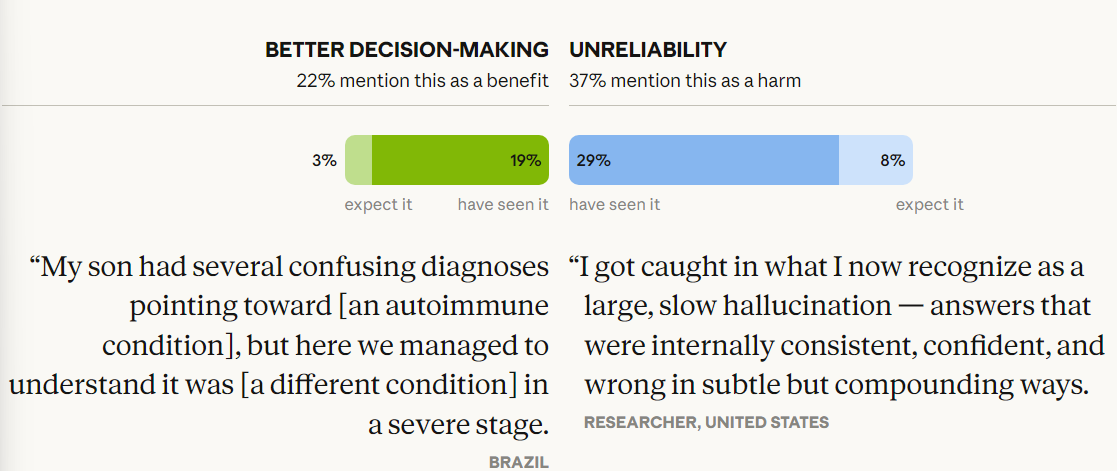

Anthropic 從中歸納出五組核心張力:學習 vs. 認知退化、決策輔助 vs. 不可靠、情感支持 vs. 情感依賴、節省時間 vs. 虛幻的生產力、經濟賦權 vs. 經濟替代。每一組都不是「A 好 B 壞」的簡單對立,而是同一種 AI 能力的一體兩面。

💡 值得特別注意的數據: 在「決策輔助 vs. 不可靠」這組張力中,負面超過正面——37% 的人提到 AI 不可靠的問題,但只有 22% 提到 AI 幫助了決策。這是五組張力中唯一負面壓過正面的。 而且將近一半的律師表示親身經歷過 AI 的不可靠,但同時他們也是所有職業中,回報 AI 決策輔助效益最高的群體。

地區差異也很明顯。全球 67% 的受訪者對 AI 持正面態度,但南美洲、非洲、亞洲多數地區明顯比歐美更樂觀。撒哈拉以南非洲有 18% 的人表示完全沒有擔憂,而北美和西歐只有 8-9%。

北美和大洋洲特別擔心 AI 治理缺口;西歐最在意監控與隱私;東亞則走出自己的路——治理和監控的擔憂降到所有區域最低,取而代之的是對「認知退化」和「意義喪失」的焦慮特別高。 用報告裡的話來概括就是:西方擔心「誰控制 AI」,東亞擔心「AI 怎麼改變我」。

最後有一個方法論上的重要提醒:所有 80,508 位受訪者都是現有的 Claude 用戶。這不是「全人類怎麼看 AI」的調查,而是「已經在用 Anthropic 產品的人怎麼看 AI」的調查。那些因為失望而離開的人不在這個數據集裡。67% 正面態度這個數字,幾乎可以確定高估了全球整體情緒。

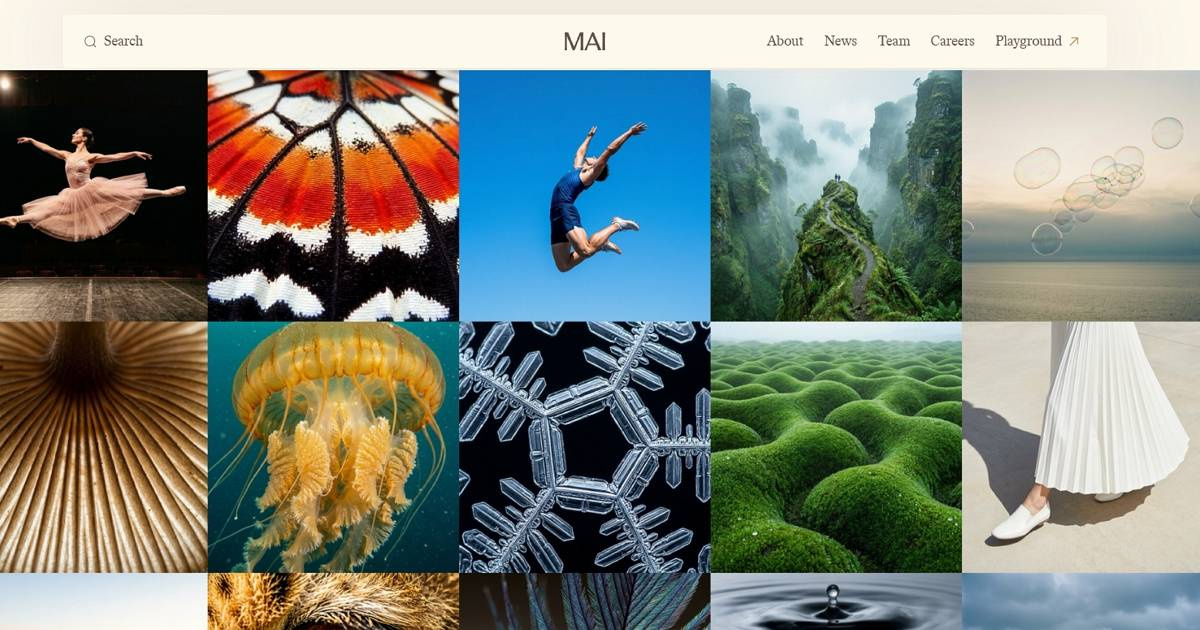

生圖模型的黑馬竟然是微軟?MAI-Image-2 殺進排行榜前三

微軟 AI 團隊(AI Superintelligence Team)在 3 月 19 日發表了 MAI-Image-2,一個文字生成圖像模型。 它在 Arena.ai 的文字生圖排行榜上直接空降第三名,僅次於 Google 的 Gemini 3.1 Flash 和 OpenAI 的 GPT-Image-1.5。

這件事為什麼值得注意?因為一年前,微軟在 Bing 和 Copilot 上的圖像生成幾乎完全仰賴 OpenAI 的模型。

回顧一下時間線:微軟在 2025 年 10 月推出第一代圖像模型 MAI-Image-1。MAI-Image-1 當時在 Arena 排行榜上排名第九,跟頂尖的差距還很大。 五個月後,第二代模型就衝到了第三。這個迭代速度暗示著微軟 AI 團隊的運作節奏,已經跟微軟過去那種慢吞吞的消費產品週期完全不同了。

技術上,MAI-Image-2 主打三個方向:更擬真的照片級輸出(改善了自然光、膚色準確度)、更可靠的圖內文字渲染、以及更豐富的場景生成能力。其中文字渲染的進步最驚人——比前代提升了 115 分,在海報、簡報、資訊圖表這類場景的表現大幅躍進。 微軟表示,這次開發過程直接找了攝影師、設計師和視覺創作者參與回饋 ,而不只是追求跑分。

目前 MAI-Image-2 已經可以在 MAI Playground 免費試用(限美國用戶),Copilot、Bing Image Creator 和 Foundry API 也在陸續上線中。

不過,產品層面的限制還蠻多的。目前只支援 1:1 正方形輸出,沒有橫幅、直式或自訂比例。每次生成有 30 秒冷卻時間,每天上限 15 張。也沒有圖對圖、局部修改或外擴功能——以 2026 年的標準來說,這些限制對任何正式的創作工作流程都是硬傷。

觀察筆記

Copilot 目前大約只有 600 萬日活用戶,而 ChatGPT 有 4.4 億、Claude 大約 900 萬。 更痛的數據是:一份追蹤超過 15 萬名美國付費 AI 訂戶的調查發現,Copilot 的市佔率從 2025 年 7 月的 18.8% 暴跌到 2026 年 1 月的 11.5%。當使用者同時有 ChatGPT 可選時,選 Copilot 的比例掉到 18%;再加上 Gemini,只剩 8% 的人會選 Copilot。

也就是說——微軟可以把 Copilot 塞到 4.5 億使用者面前,但十個人裡有九個選了別人,明明放在超商結帳區,卻沒有一個人會拿起來結帳,超級可惜。

這個數字說明了一件殘酷的事:在 AI 時代,光有分發優勢可能還不夠。

微軟可能是全世界最擅長「把東西塞到你桌面上」的公司。Windows、Office、Teams、Outlook——你的工作環境裡到處都是微軟的影子。過去幾十年,微軟靠的就是這招:我不需要是最好的,我只需要是你打開電腦就會看到的那個。

過去軟體靠的是「你的檔案在我這裡」來鎖住你,但現在 AI 靠的是「我記得你是誰」。你跟 ChatGPT 或 Claude 互動了幾個月,它記住了你的寫作風格、你的工作脈絡、你偏好的回答方式、甚至你上週跟它討論到一半的那個專案。這些累積下來的記憶和默契,就是一種新形態的切換成本——你換到另一個 AI,技術上只要打開一個新網頁,但你得從零開始「教」它認識你,就跟交一個新女朋友一樣麻煩。

問題是,Copilot 有建立起這種「記憶黏性」嗎?從目前的數據來看,沒有。十個人裡九個選了別人,代表 Copilot 連讓使用者留下來互動到產生記憶的機會都沒爭取到。

喜歡這期內容嗎?有哪一則讓你特別有感?

歡迎回信或是 Instagram 告訴我們,我們會偷偷讀大家的回覆的!

我們下周見

—AI郵報 編輯團隊