Subquadratic 發表 SubQ:1200 萬 Token 長上下文模型,挑戰 Transformer 成本瓶頸

AI 新創 Subquadratic 推出 SubQ,宣稱以全次平方稀疏注意力架構支援 1200 萬 token 長上下文,並募得 2900 萬美元種子輪資金,瞄準 coding agent、企業知識庫與長期 AI agent 工作流。

AI 新創公司 Subquadratic 正式推出長上下文大型語言模型 SubQ,主打 1200 萬 token reasoning、稀疏注意力架構與更低推理成本。這家公司同時宣布已募得 2900 萬美元種子輪資金,試圖切入目前 AI agent、程式碼理解與企業知識庫面臨的最大痛點:模型看得不夠多,或者看得越多就越貴。

SubQ 是什麼?

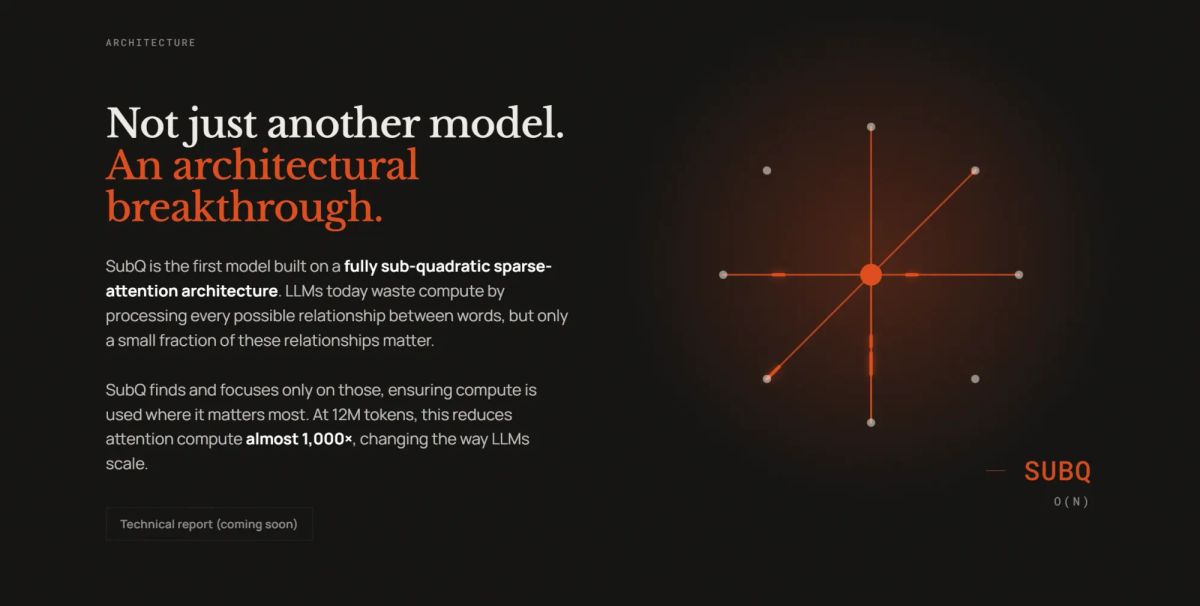

SubQ 是 Subquadratic 發表的長上下文 LLM。官方宣稱,SubQ 採用 fully sub-quadratic sparse-attention architecture,能在 1200 萬 token 規模下進行推理,讓 AI agent 一次處理完整程式碼庫、數月 pull request、長期互動歷史與持久狀態。

Subquadratic 核心規格包括:

- 1200 萬 token reasoning

- 150 tokens per second

- 成本約為其他領先 LLM 的五分之一

- 12M token 下 attention compute 減少近 1000 倍

- API 支援 streaming、tool use 與 OpenAI-compatible endpoints

Introducing SubQ - a major breakthrough in LLM intelligence.

— Alexander Whedon (@alex_whedon) May 5, 2026

It is the first model built on a fully sub-quadratic sparse-attention architecture (SSA),

And the first frontier model with a 12 million token context window which is:

- 52x faster than FlashAttention at 1MM tokens

-… pic.twitter.com/eZL0VOqBB4

為什麼 Transformer 長上下文很貴?

傳統 Transformer 的 self-attention 會比較每個 token 與其他 token 的關係,因此上下文越長,計算量會呈平方成長,也就是常見的 O(n²) 問題。當輸入從 128K token 擴大到 1M token,甚至 12M token 時,推理成本與延遲會快速上升。

這也是為什麼許多企業 AI 系統仍依賴 RAG、chunking、摘要記憶與多階段 agent workflow。這些方法能降低模型一次要看的內容,但也會帶來資訊遺失、檢索偏差與工程複雜度。

SubQ 的主張是:與其把問題交給外部檢索與 prompt 工程,不如讓模型本身能以更低成本處理完整上下文。

Alex Whedon:SubQ 是 LLM 智慧的重大突破

Subquadratic 共同創辦人兼 CTO Alex Whedon 在 X 上表示,SubQ 是 LLM intelligence 的重大突破,並稱它是第一個基於 fully sub-quadratic sparse-attention architecture 的前沿模型。

他也提到,SubQ 具備 1200 萬 token context window,在 100 萬 token 情境下比 FlashAttention 快 52 倍,且成本低於 Opus 的 5%。這些說法與 SubQ 官方網站的定位一致:SubQ 的核心賣點不是聊天能力,而是超長上下文推理的速度與經濟性。

募資 2900 萬美元,鎖定企業與開發者市場

Subquadratic 已完成 2900 萬美元種子輪募資,投資人包括前 SoftBank Vision Fund 合夥人 Javier Villamizar、Tinder 共同創辦人 Justin Mateen,以及 Anthropic、OpenAI、Stripe、Brex 的早期投資人。

Subquadratic CEO Justin Dangel 在訪談中表示,公司重點在於把 dense attention 的 quadratic scaling 架構轉向 sparse attention 的 linear architecture。CTO Alex Whedon 則指出,若輸入長度加倍,傳統 quadratic scaling 需要約四倍計算量;但 linear scaling 只需要約兩倍。

這也是 SubQ 商業敘事的核心:長上下文不是單純模型規格,而是 AI 應用能否大規模部署的成本問題。

SubQ 的三個產品方向

Subquadratic 目前將 SubQ 包裝成三種產品進入 private beta。

第一是 SubQ API,面向開發者與企業團隊,主打單次 API call 處理完整 repo、pipeline state 或大型文件集,並提供 OpenAI-compatible endpoints。

第二是 SubQ Code,這是一個面向 coding agent 的命令列工具,可接入 Claude Code、Codex 與 Cursor,用於快速 map codebase、蒐集上下文與回答大量 token 的程式碼問題。官方宣稱可降低約 25% 帳單,並讓探索速度提升 10 倍。

第三是 SubQ Search,定位為長上下文搜尋與 Deep Research 工具,目標是在接近聊天機器人的速度下處理大型資料與研究任務。

Benchmark:官方數據亮眼,但仍需獨立驗證

Subquadratic 公布的 benchmark 顯示,SubQ 1M-Preview 在 RULER @ 128K 測試達到 95.0%,MRCR v2 8-needle 1M 測試為 65.9%,SWE-Bench Verified 為 81.8%。官方也表示 SubQ 結果經第三方驗證。

Subquadratic 稱 SubQ 在 RULER 128K benchmark 上以約 8 美元成本達到 95% accuracy,而 Claude Opus 約為 2600 美元、accuracy 約 94%。若這項成本差距能被獨立重現,會是長上下文推理市場的重要訊號。

不過,SubQ 技術報告目前仍未完整公開,外部研究者尚無法全面檢視架構細節、測試條件與真實應用表現。因此現階段更精準的說法是:SubQ 提出了非常激進的長上下文成本主張,但仍等待公開技術報告與第三方 benchmark 進一步驗證。

產業意義:AI Agent 的瓶頸可能從模型能力轉向記憶成本

SubQ 的發表切中當前 AI agent 的核心問題。許多代理系統不是不能推理,而是無法穩定記住完整背景。開發者必須不斷設計檢索、摘要、壓縮、上下文排序與工具調用策略,才能讓模型在有限 context window 中做出可用決策。

如果 1200 萬 token 長上下文能以可接受成本運作,AI agent 的設計方式可能會改變。完整 codebase、完整文件庫、長期任務紀錄與多日工作狀態,都有機會被放入單一推理環境中。這會降低 RAG 與多代理協調的需求,也可能讓 coding agent、企業知識管理與長流程自動化更接近產品化。

仍要保持觀察的風險

SubQ 的敘事很有吸引力,但 AI 產業過去也出現過許多 subquadratic attention、linear attention、state space model 與 sparse attention 方案。這些方法常見挑戰是:理論上更省計算,但在 frontier-level 任務、複雜推理與泛化能力上不一定能維持同等品質。

因此,SubQ 接下來最重要的觀察點包括:技術報告是否公開、API 價格是否真的具備成本優勢、12M token 長上下文是否能在真實企業資料中穩定運作,以及第三方測試是否能重現官方 benchmark。

參考來源:SubQ 官方網站、Subquadratic 官方發表文章、SiliconANGLE 報導、Alex Whedon X 貼文