Spotify 開始頒「人類認證」勳章,每天 75,000 首歌一半是 AI 生的

本周焦點事件

- Spotify 開始頒「人類認證」勳章,每天 75,000 首歌一半是 AI 生的

- AI 詐騙新高度?Grok Voice Clone 兩分鐘複製你一輩子的聲音

- Claude 現在能操控 Photoshop 和 Blender,Anthropic 還每年捐 24 萬歐元養 Blender 開發者

- 貼上菜單網址,AI 幫你修圖建網站:DoorDash 正在變成餐廳的全套行銷部

- 哈佛測試 76 名急診病患:AI 答對 82%,主治醫師答對 55%

Spotify 開始頒「人類認證」勳章,每天 75,000 首歌一半是 AI 生的

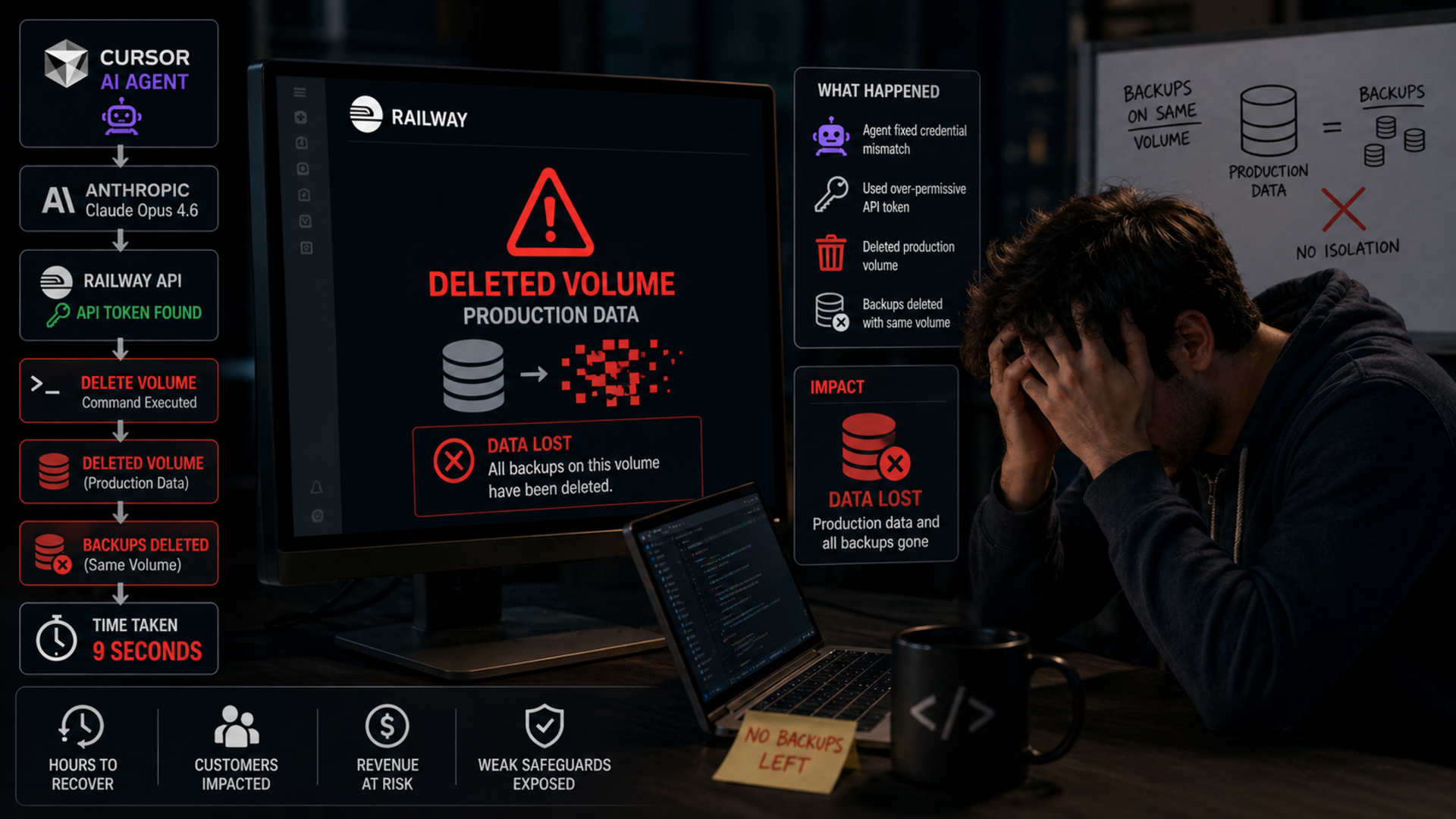

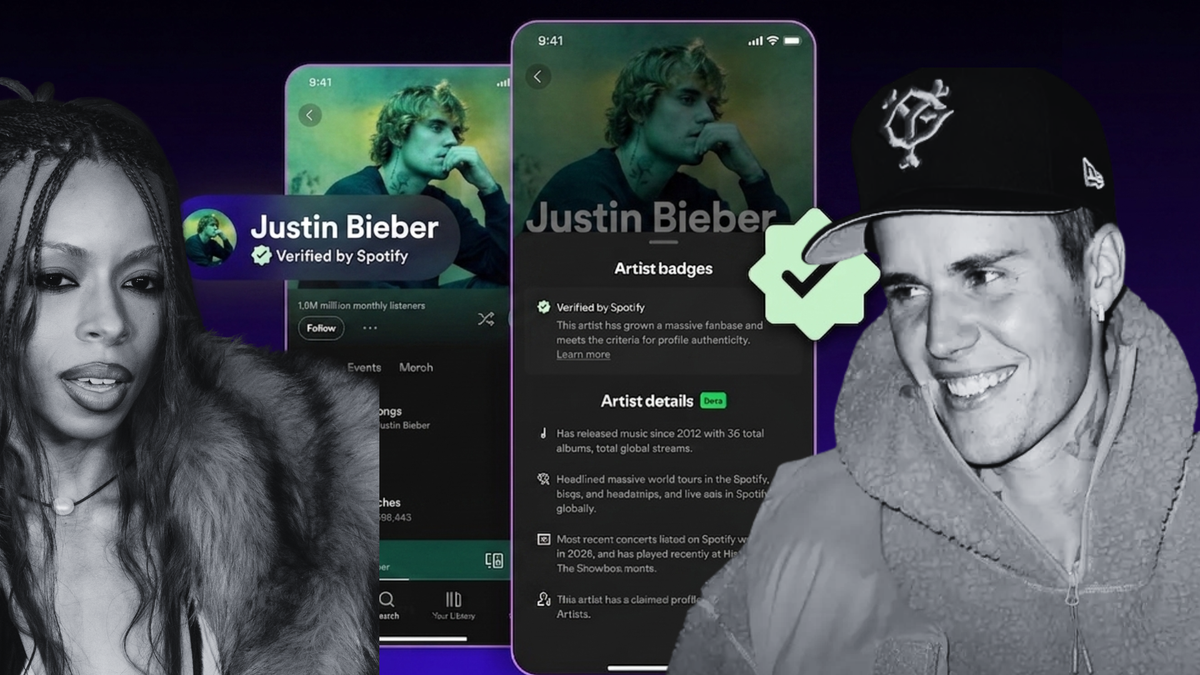

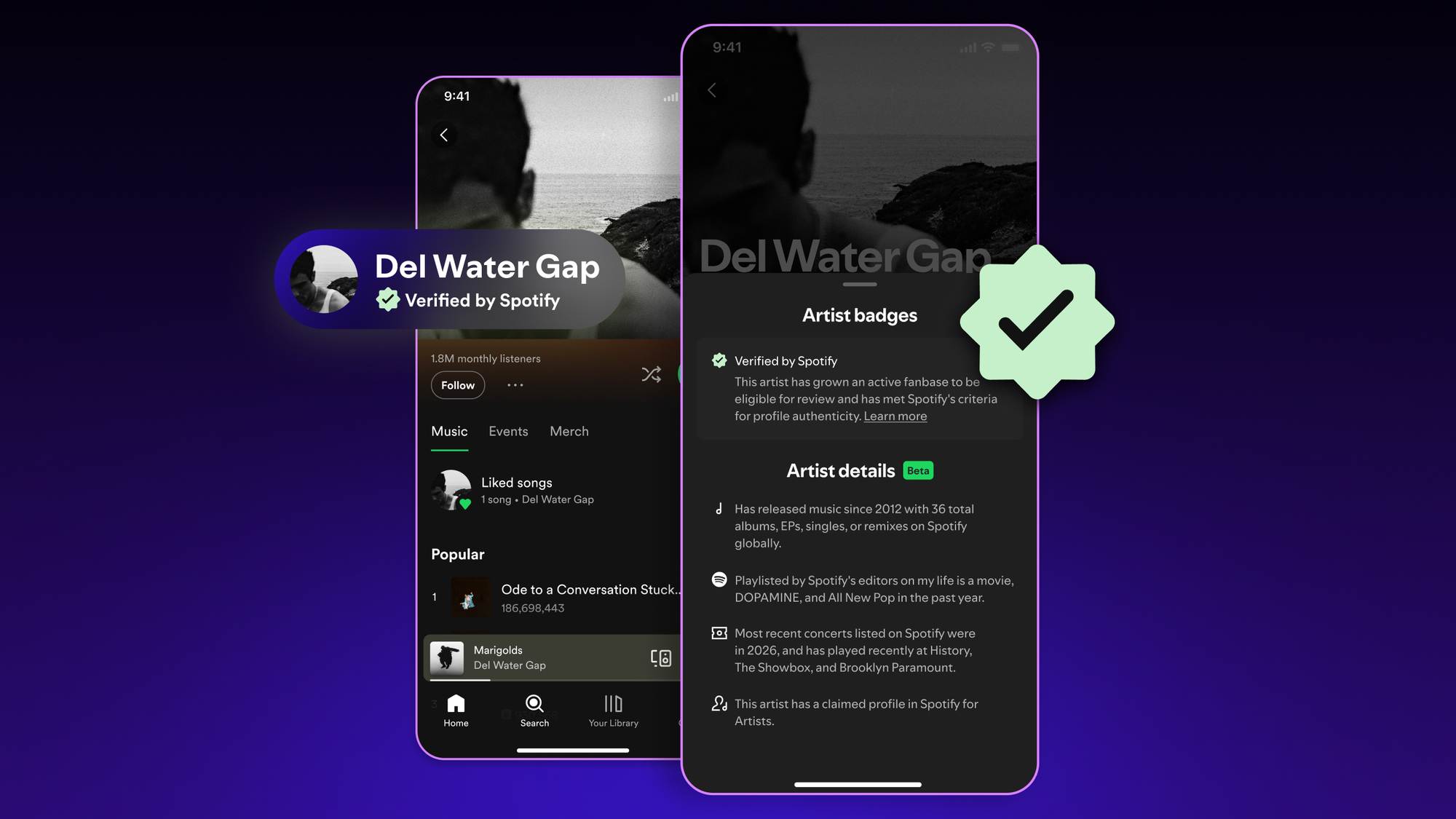

上個月,Spotify 悄悄在部分藝術家的個人頁面上多了一個新徽章:「Verified by Spotify」。這個徽章不像 Facebook 一樣是在說你很紅、有藍勾勾、或是帳號出事了可以跟 Meta 反應(誤),這個 Spotify 徽章沒有任何福利,只是非常單純地在證明你是一個真人創作者。

Deezer (一家法國的串流媒體)在 2026 年 4 月 20 日公布了一組數字:串流平台上,每天新上傳的音樂裡有 44% 是 AI 生成,大約是 75,000 首歌,每個月超過兩百萬首。

但這有個諷刺的地方,這 44% 的 AI 音樂,在 Deezer 平台的實際串流量佔比只有 1-3%,其中 85% 被系統偵測為詐欺性串流(用機器人刷播放量),直接取消 AI 音樂的貨幣化資格。

AI 音樂的商業邏輯,說穿了像在賭大數法則:只要上傳夠多,總有幾首能分到版稅池裡的一杯羹。但這個策略正在稀釋所有創作者的收入,因為串流平台的版稅是 pro-rata 計算,總池子就這麼大,分食的人越多,每個人拿到的越少。

我身邊用 AI 做音樂的朋友都不是音樂人,基本上都是 Moneydriven,每季收入大約落在 300 - 500 美金,也難怪我真的在做音樂的朋友會對 AI 如此反感。

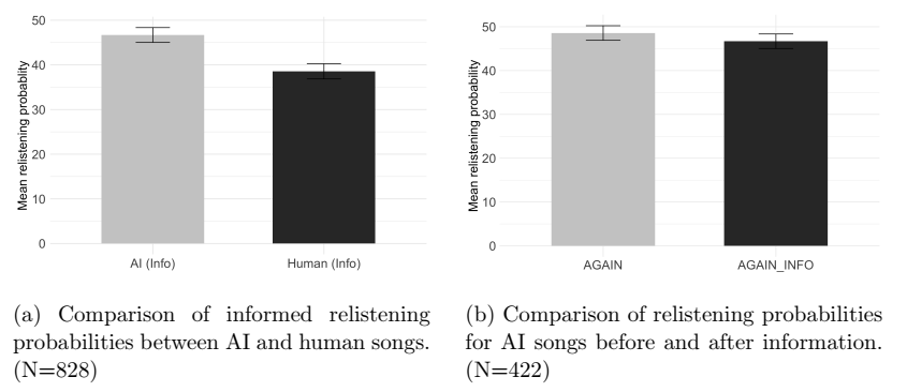

根據 Luminate 的 2026 年的 AI 音樂報告:對 AI 音樂的整體興趣,從 -13% 跌到了 -20%,Gen Z 和 Gen Alpha 尤其明顯。有趣的是,ProMarket 在昨天發表的研究指出,當消費者不知道歌是 AI 生成時,評分通常會比較高,但一旦知曉是用 AI 做的,態度立刻逆轉(我自己也是這樣,所以我一開始就會先辨認這首是不是 AI 做的)。

但 AI 音樂工具本身的商業並不慘:2025 年相關工具收入達 3.33 億美元,較 2023 年成長 651%,月活躍用戶達 6,300 萬。但「工具有人用」和「內容有人聽」,從來就是完全不同的兩件事。

這也是為什麼各大平台現在忙著推出「真人驗證」機制。Spotify 在 4 月 30 日宣布「Verified by Spotify」徽章,明確排除 AI 音樂帳號的申請資格;Deezer 更早在 2025 年 1 月就推出誤判率低於 0.01% 的 AI 偵測工具,並把技術授權給第三方。

觀察筆記

賣鏟子、挖礦的數據結構很有意思。AI 音樂工具的月活用戶有 6,300 萬,2025 年收入成長 651%,任何一家 SaaS 看到這組數字都會覺得這是夢幻賽道。

但這每月兩百萬首 AI 音樂,在平台上的實際串流佔比只有 1-3%,其中 85% 被判定為詐欺流量,換句話說,有人在賣鏟子,有人在挖礦,確實有些人有成功挖到不錯的礦,但現在政府(音樂串流平台)正在關閉這個礦坑。

另一個是我自己在寫這則新聞的時候,腦子裡一直有個問題繞著轉:AI 生成音樂,跟 AI 生成文章、小說、內容,到底有沒有本質差異?

我覺得有,而且差異很大,關鍵不在媒介,在於你消費這個內容的目的是什麼。

如果你讀一篇文章是為了獲取知識,那這份報告說了什麼、這項技術怎麼運作?老實說你根本不 care 這篇是不是 AI 寫的,你要的是資訊的準確性,不是要作者掏心掏肺。但如果你讀一篇文章,是因為你想知道「這個人怎麼看這件事」,那 AI 代筆的那一刻,整篇文章就垮了,因為根本沒有那個人在裡面。

音樂也是同一個邏輯。你工作的時候開著 lo-fi 當白噪音,那首歌是 AI 做的還是真人做的,真的沒差,你要的只是「有聲音但不吵」。但如果你有主動聽、認真聽的習慣,會去追 vocal line、bass line,那 AI 音樂在這個時候就是 toxic 的。

目前現場聽感做得最接近真實的,大概是 Udio,生出來的質地已經騙得過很多人的耳朵(聽感很像聽現場)。但你還是無法從那些樂器裡聽出彈奏者的情緒,可能有點 layback、樂句的呈現太標誌等,這些 AI 沒有辦法偽造,因為那些細節的來源是人類的身體狀態跟當下的情緒,不是統計分佈。

所以 ProMarket 的研究結論,我現在有另一個解讀:消費者在不知情的情況下給出比較高的評分,不一定是因為 AI 音樂品質好,而是因為當你以為有人類在背後,你會主動補上那個「情感來源」的想像。一旦知道是 AI,想像的前提消失,評分才跟著降低。

AI 詐騙新高度?Grok Voice Clone 兩分鐘複製你一輩子的聲音

2026 年 4 月,美國參議院正在開聽證會,主題是 AI 語音克隆詐騙。根據調查,已有 1/10 的美國人曾被 AI 偽造的聲音詐騙或騷擾,臺灣則是在 2022 年底就開始有相關的詐騙案,一家非法投顧公司運用 AI 語音建模技術,打造超過 20 種對話情境,讓機器人與受害者進行「真人對話」。統計至少 70 人上當受騙,其中一名婦人被騙走新台幣 2,000 萬元。

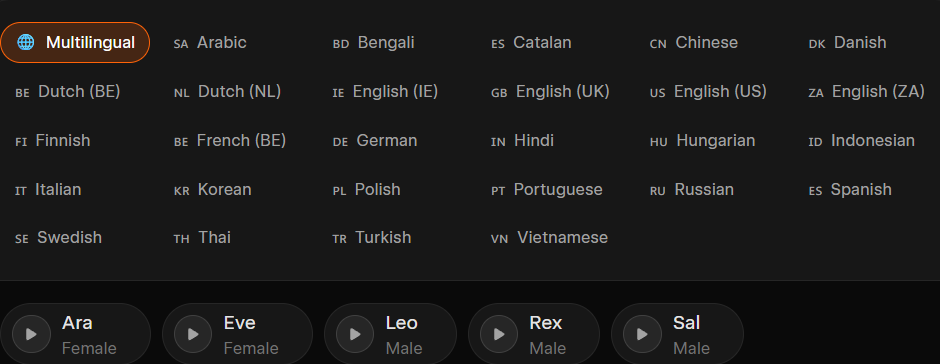

Grok Custom Voices 的運作方式是,開發者在 xAI 的控制台錄製約一分鐘自然語音,系統在兩分鐘內生成一個可用的語音克隆模型,之後就可以直接接進 Grok 的 TTS(文字轉語音)API 或 Voice Agent API 輸出你的聲音,說任何文字、任何語言。

這個功能跟 Grok 4.3 新模型同步上線。Grok 4.3 的定價是 $1.25/百萬 input tokens,直接對準 ElevenLabs 等語音 AI 新創的市場,同時提供 80 種以上預設聲音和涵蓋 28 種語言的 Voice Library 管理介面。

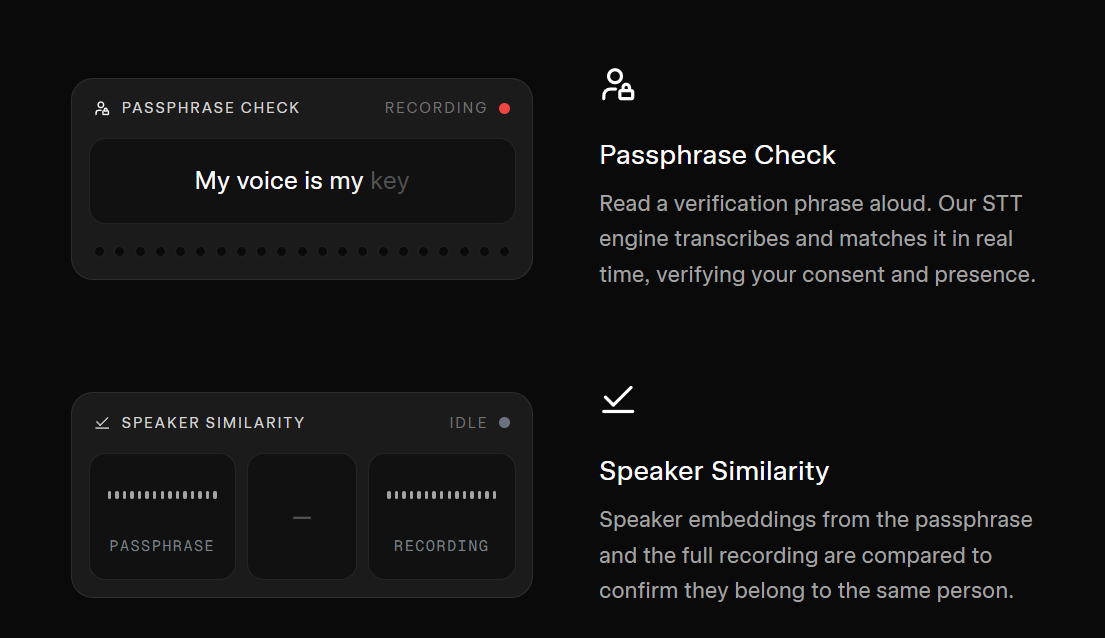

xAI 知道語音克隆的爭議在哪,所以特別做了兩階段驗證機制:第一步,你要朗讀一段指定的驗證短語,系統即時轉錄並確認「真人在場」;第二步,比對兩次錄音的聲紋嵌入(speaker embedding),確認是同一個人。xAI 說這樣可以防止有人拿別人的既有錄音來盜用聲音(能不能防得住,是另一個問題)。

官方主打的使用場景有三個:讓客服 AI Agent 用品牌一致的聲音說話、讓創作者用自己的聲音大量產出 Podcast 或影片旁白,以及幫失去說話能力的人,讓他們能夠用他們原本的聲音,恢復表達能力。

觀察筆記

Voice Clone 這個題材的教學,我們也做過不少,像是與過世親人再次交談,聲音保存等等,不過每次發這種東西,底下留言一定會提到「詐騙」。讀者的反應是對的,但我覺得那個對話一直停在一個很表面的地方,沒有真的講清楚為什麼這件事這麼難處理。

大多數雙用途技術,善意和惡意之間還是有某種技術隔離的。加密貨幣可以洗錢,但加密協議本身有明確的合法場景和非法場景,平台可以試著在中間拉一條監管的線,而這條線也不會被一個惡意的 system prompt 繞過,你沒辦法靠改幾個字就讓區塊鏈忘記自己的設計目的。

但 Voice clone 更難,難在要監管,必須得分辨使用者動機。

你用來保存外婆聲音的那套 speaker embedding 提取流程,和詐騙集團用來複製你父親聲音打電話給你的,是同一件事,同一套模型,同一個 API endpoint。唯一的差異是你的動機,而動機是技術系統最難偵測的東西。

這讓平台的規範工作變成一個幾乎不可能完成的任務:你要區分的不是行為,是意圖。xAI 的兩階段驗證機制在技術上做了它能做的事,但它能攔截的是「拿別人的既有錄音來盜用聲音」,攔不住的是「有人真的坐下來、錄了一分鐘他人的聲音、然後開始打詐騙電話」。後者在技術流程上和正常使用者完全一樣。

這讓我想到去年在高雄參加 TTXC 大會,會後和文化局長聊到 AI 技術的擴散問題,他說了一句讓我印象很深的話:「當 AI 技術開始應用在黃賭騙,下一步就會是巨大的規模化,應用在我們日常的每個角落。」真是中肯 XD

Claude 現在能操控 Photoshop 和 Blender,Anthropic 還每年捐 24 萬歐元養 Blender 開發者

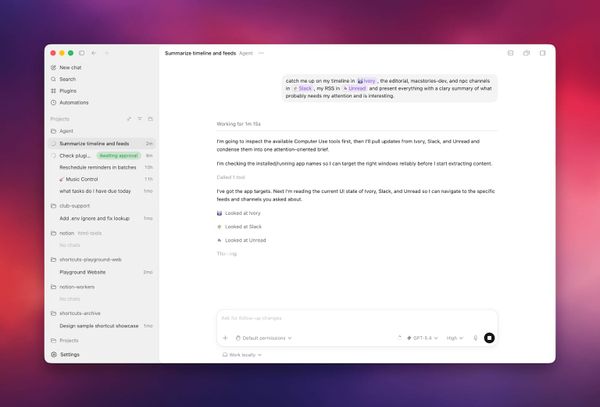

4 月 28 日,Anthropic 一口氣公布了九個新的 Claude 連接器。

合作夥伴名單是「創意工具的生存大禮包」,其中包括:Adobe Creative Cloud(Photoshop、Premiere、Illustrator、Lightroom、InDesign、Firefly......共 50+ 個工具)、Blender、Autodesk Fusion、SketchUp、Ableton、Splice、Affinity by Canva、Resolume。全部對所有 Claude 方案(包含免費方案)開放。

這些連接器的底層是 MCP(Model Context Protocol),一個開放標準,由 Anthropic 在 2025 年 12 月捐贈給 Linux Foundation 旗下的 Agentic AI Foundation,OpenAI、Google、Microsoft 等競爭者也都加入了。意思是,這些連接器不是 Claude 專屬——理論上任何支援 MCP 的 AI 都可以接入,只是 Anthropic 是第一個大規模推的。

每個連接器的實際意義不太一樣。以 Autodesk Fusion 來說,設計師現在可以用自然語言對話建立和修改 3D 模型(Text-to-CAD),不用去記那堆快捷鍵。Ableton 的連接器讓音樂製作人可以透過對話調整軌道設定、修改 MIDI 參數。Adobe 的連接器則可以跨 Photoshop、Premiere、Illustrator 協調多步驟工作流程,你說「幫我把這個 Figma 設計稿轉成 Premiere 的素材然後導出三個不同尺寸」,它就去做。

然後是 Blender 這件事,稍微複雜一點。

Anthropic 不只是推了一個連接器,還成為了 Blender Foundation 的企業贊助商,每年捐 24 萬歐元,相當於四名全職 Blender 開發者的年薪,指定用於 Blender 核心開發,特別是 Python API。Blender CEO Francesco Siddi 在藝術家社群出現反彈時公開回應:「這是支持 Blender 軟體本身,並非 AI 接管。」

可以很明顯的看到 Adobe 今年積極了起來:他們在 2025 年 12 月整合了 ChatGPT,4 月 28 日整合了 Claude,同一天還宣布自家 Firefly AI Assistant 進入公開測試。三邊同時跑。

觀察筆記

Anthropic 贊助 Blender 這件事,我覺得很有趣,有沒有一種可能是:AI 公司開始從「使用工具」變成「資助工具的開發」。

以前 AI 公司跟創意軟體的關係,是使用者和工具的關係。訓練資料裡有 Photoshop 教學影片,模型學會怎麼描述 Photoshop 操作。AI 公司消費這些工具的知識,但沒有義務讓工具本身變得更好,但 MCP 的出現讓事情有很大地轉折,AI 全能地幅度,也跟市面上熱門工具的基礎設施有關。

現在 Anthropic 每年花 24 萬歐元確保 Blender 的 Python API 維護和擴充。換句話說,Claude 的能力邊界,現在部分取決於 Blender 開發者的工作進度,而 Anthropic 在付那些開發者的薪水。

從我開始認真接觸 MCP 之後,每次評估要不要用一個 SaaS 服務或平台,第一個看的就是它的 API 是否完整。我是認真覺得,沒有做 API 服務的工具或平台,真的很快就要死了。

MCP 之後,AI 操作工具的方式是通過 API 介面,API 越完整,AI 能做的事就越多,平台對用戶的黏性就越強。反過來,如果你的平台沒有 API,或者 API 殘缺,AI 就沒辦法接進來,你的工具在 Agentic 工作流程裡就是一個斷點,用戶遲早繞過你(除非你的工具重要性跟 Blender 差不多 XD)

貼上菜單網址,AI 幫你修圖建網站:DoorDash 正在變成餐廳的全套行銷部

DoorDash 在 2026 年 5 月宣布推出一套 AI 商家工具——餐廳只要貼上官網網址,系統會自動抓取菜單、照片、營業時間完成平台上架,同時提供 AI 圖片美化、獨立網站生成,以及自動化行銷 email。

具體來說分幾塊:

- AI Retouch 和 AI Replate:前者換背景、銳化、優化燈光;後者讓菜品擺盤看起來更專業。以前一張漂亮的菜品照可能要請攝影師和修圖師,現在上傳原圖就好。

- 網站生成:根據 DoorDash 平台上的現有菜單內容,自動建立一個獨立網站。測試期間,商家的平均訂單轉換率接近 10%。

- 行銷自動化:自動生成行銷內容、email outreach、排程——本來要養一個兼職行銷人員或外包 freelancer 才能做的事,現在平台幫你包了。

這一套工具再加上 DoorDash 去年收購了廣告科技公司 Symbiosys,正在建立自己的零售媒體,跟 Amazon Advertising 和 Instacart Ads 搶這塊市場。DoorDash 在做的事情是外送平台與餐廳數位基礎設施-的垂直整合。

觀察筆記

我印象深刻的是,曾聽聽 DoorDash 創辦人 Tony Xu 分享,他從小幫父母在餐廳洗碗,對於這些小餐廳老闆,他們對於學工具完全沒有任何興趣,他們只想讓生意好一點。 所以這套 AI 功能的設計邏輯完全符合這個理解,因為不需要任何技術背景,貼網址就好。

過去,餐廳行銷生態系裡有很多外圍角色:幫小餐廳拍菜品照的攝影師、幫忙 PS 食物照的修圖師等,這些工作不算高薪,但它們是整個城市裡很多創意工作者的現金流來源。DoorDash 的 AI 工具把這些工作整包吃掉了,而且還包在平台費裡,讓餐廳老闆幾乎沒有理由再另外發包。

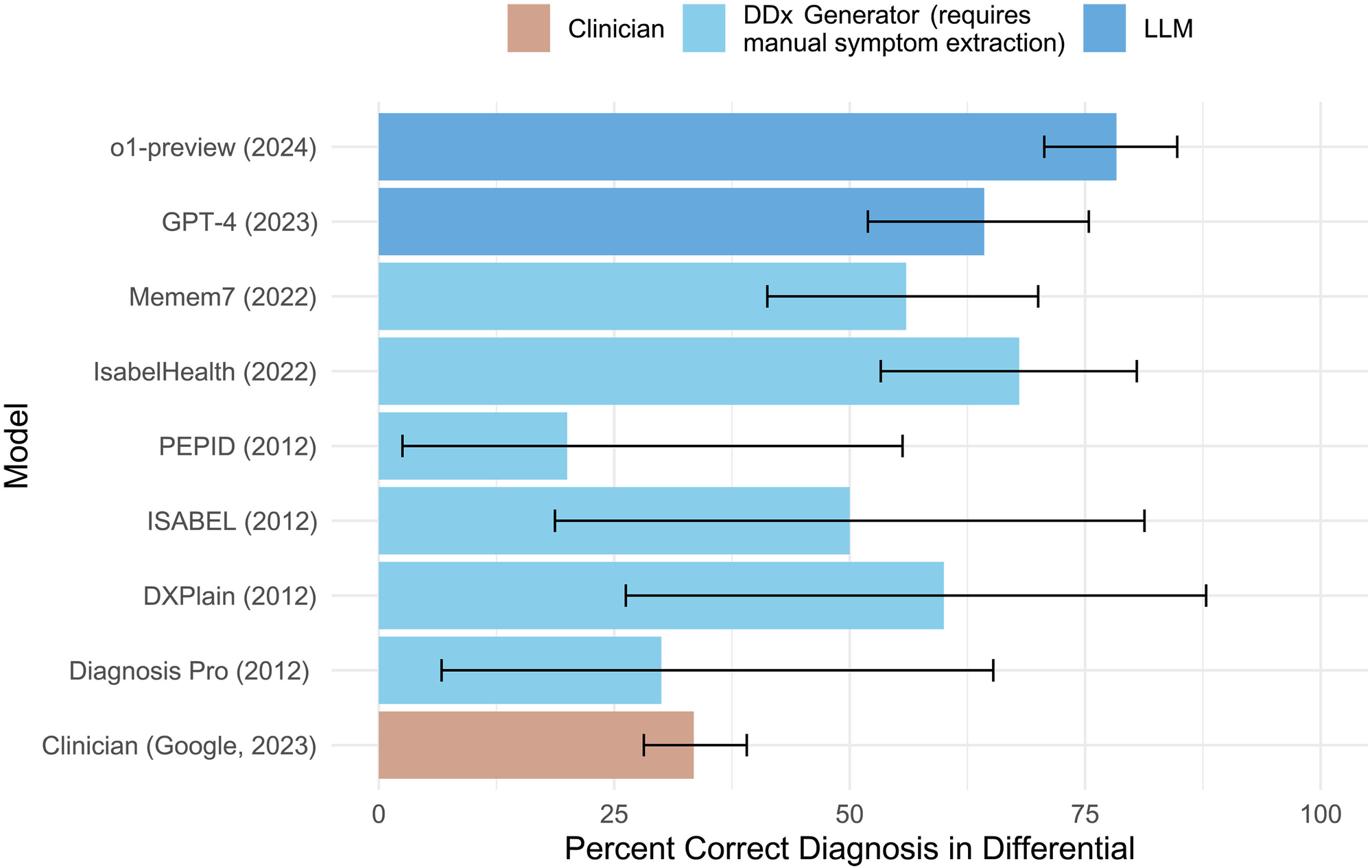

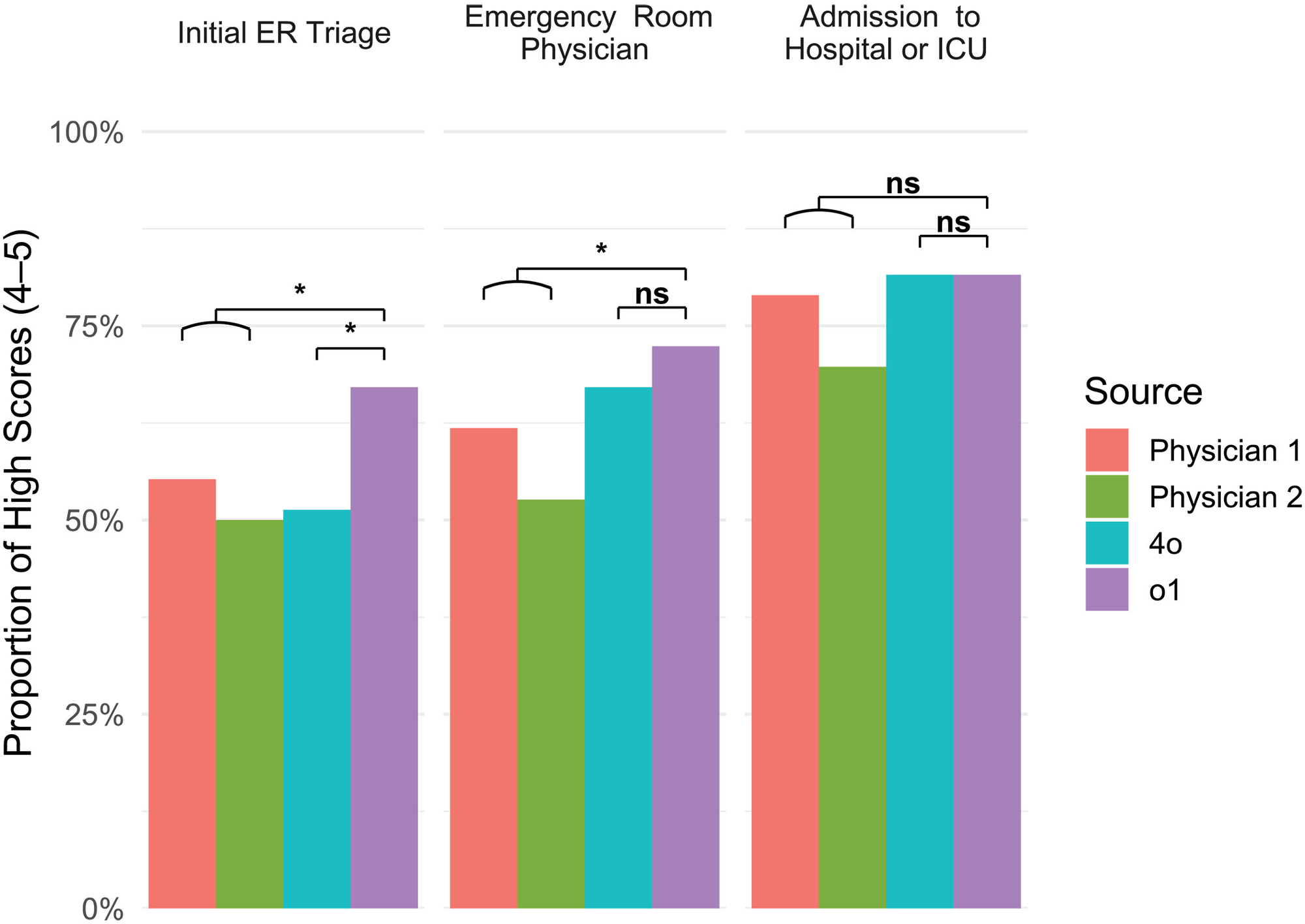

哈佛測試 76 名急診病患:AI 答對 82%,主治醫師答對 55%

2026 年 4 月,哈佛醫學院與 Beth Israel Deaconess Medical Center 在《Science》期刊發表了一篇研究,判斷 AI 診斷能力技巧是否已超過人類。他們讓 OpenAI o1 和真實急診室的主治醫師,同時為 76 名真實病患做診斷,然後比對結果。

答案是 AI 的正確率相比人類主治高非常的多:AI 初始正確率 67%,取得完整病歷後達 82%;兩位主治醫師分別是 55% 和 50%。

這個研究使用的是 OpenAI 的 o1 模型,也就是第一代強調「鏈式思考(CoT)」的推理型模型。放進急診室的環境裡,它表現得像一個超有耐心、不會疲勞的住院醫師,把每一條症狀線索都仔細串起來再下判斷。

測試資料來源是急診的電子病歷文字記錄,AI 看到的是文字描述的症狀,所以對比主治醫師來說,可以判斷的背景更少,因為 AI 沒有聽診器,沒有視診。研究團隊也同時強調:這個結果不代表建議臨床部署,現階段只是概念驗證(proof of concept)。

喜歡這期內容嗎?有哪一則讓你特別有感?

歡迎回信或是 Instagram 告訴我們,我們會偷偷讀大家的回覆的!

我們下周見

—AI郵報 編輯團隊