【AI 新手包 #5 打造工具自動化】:AI 工具協作製作超過 100 支教學影片:流程、踩坑與最佳組合公開

我們用 AI 工具協作製作超過 100 支教學影片,從腳本、配音、插畫動畫到後製流程,全都拆成可複製的標準作業。這篇會公開我們實戰中踩過的坑、最佳工具組合,以及為什麼聲音永遠是影像的起點。

不是一鍵生成,而是協作生產

過去一年半來,我們團隊製作了超過 100 支教學影片,

內容涵蓋從 AI 工具介紹、使用實例,到創作應用與人物故事,

每支影片的風格都不太一樣,但背後其實都有一套共通的製作流程。

我們不是靠「一鍵生成」就能把影片生出來,

而是一步步打造出一條 AI 工具協作的影片產線,

把腳本、配音、畫面、剪輯與後製拆成模組,

讓 AI 在正確的位置上幫我們節省時間、提高穩定度。

這篇文章會公開我們最常處理的三種教學影片類型,

也會拆解我們實際操作的七個製作步驟,

從「純人工」到「AI 協作」的差別到底在哪、怎麼做更快更穩,

以及我們踩過的坑與目前最推薦的工具組合。

如果你也想靠 AI 幫你批量做影片,

這篇會是你搭建第一條 AI 媒體工廠的使用說明書。

我們做的教學影片,分成這三種類型

要用 AI 做影片,第一件事不是選工具,而是先搞清楚你要做哪一種內容。

我們過去製作的 100 多支影片,大致可分成三種類型,每種都有不同的節奏與素材邏輯:

1. 故事型

這類影片通常從一個個人經驗或真實情境出發,帶出工具應用。

像是我們做過的〈我幫媽媽生了她沒拍到的結婚照〉,

就是用情感敘事串起畫面、配音與 AI 圖像,插入畫面節奏會比較細緻。

這類影片重視共鳴,畫面節奏較慢,insert 畫面與字幕呈現都要貼近情境。

2. 垂直型(流程導向)

這種影片會聚焦在某一個產業情境中,帶出完整流程,像是:

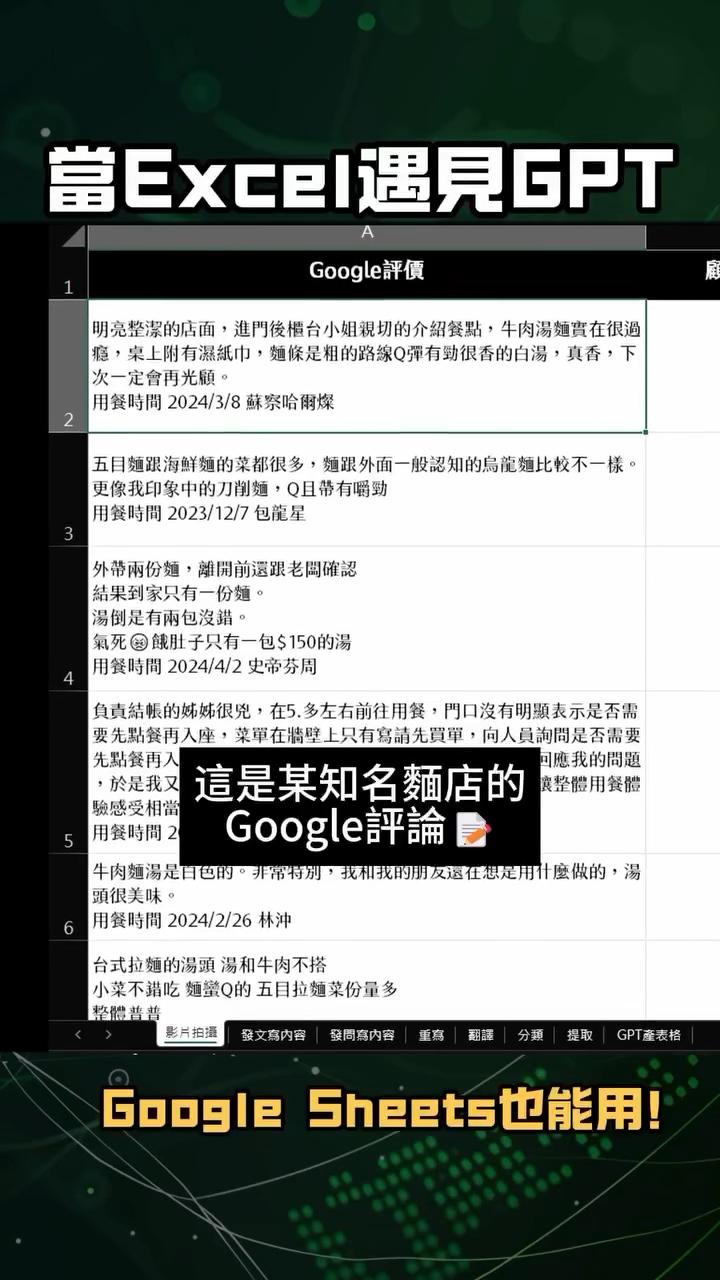

「餐廳老闆如何用 Excel AI 自動化回應顧客評論」,

這類內容的腳本結構類似教案,要拆出每個動作對應的工具,

也最需要插入操作畫面與畫面分段設計。

3. 水平型(功能導向)

這類影片是比較多工具、同一功能的並排介紹,

像是「五款 AI 配音工具誰最好用?」或「三種 AI 字幕工具實測」。

節奏會比較快,資訊密度高,畫面通常包含比較表、icon、字幕說明。

我們在製作這類內容時,最依賴腳本組織與配音清晰度,

也會優先使用 AI 工具幫我們快速產出畫面模擬與段落對照圖。

完整製作流程公開:從腳本到成片,我們怎麼協作 AI

做影片最怕的不是剪輯,而是「每次都從零開始」。

我們之所以能穩定產出 100 支以上的教學影片,

關鍵不在某個神工具,而在於:把製作流程模組化,讓 AI 在對的位置接手。

以下是我們每支影片都會走的七個製作步驟,

每個環節都曾經是人工處理,現在則有 AI 工具協作,大幅提高效率與穩定性。

1. 腳本產製

以前怎麼做:

每支腳本從白紙開始寫,要自己想架構、舉例、轉場語,

常常光是敲完初稿就花上一整天。

現在怎麼做:

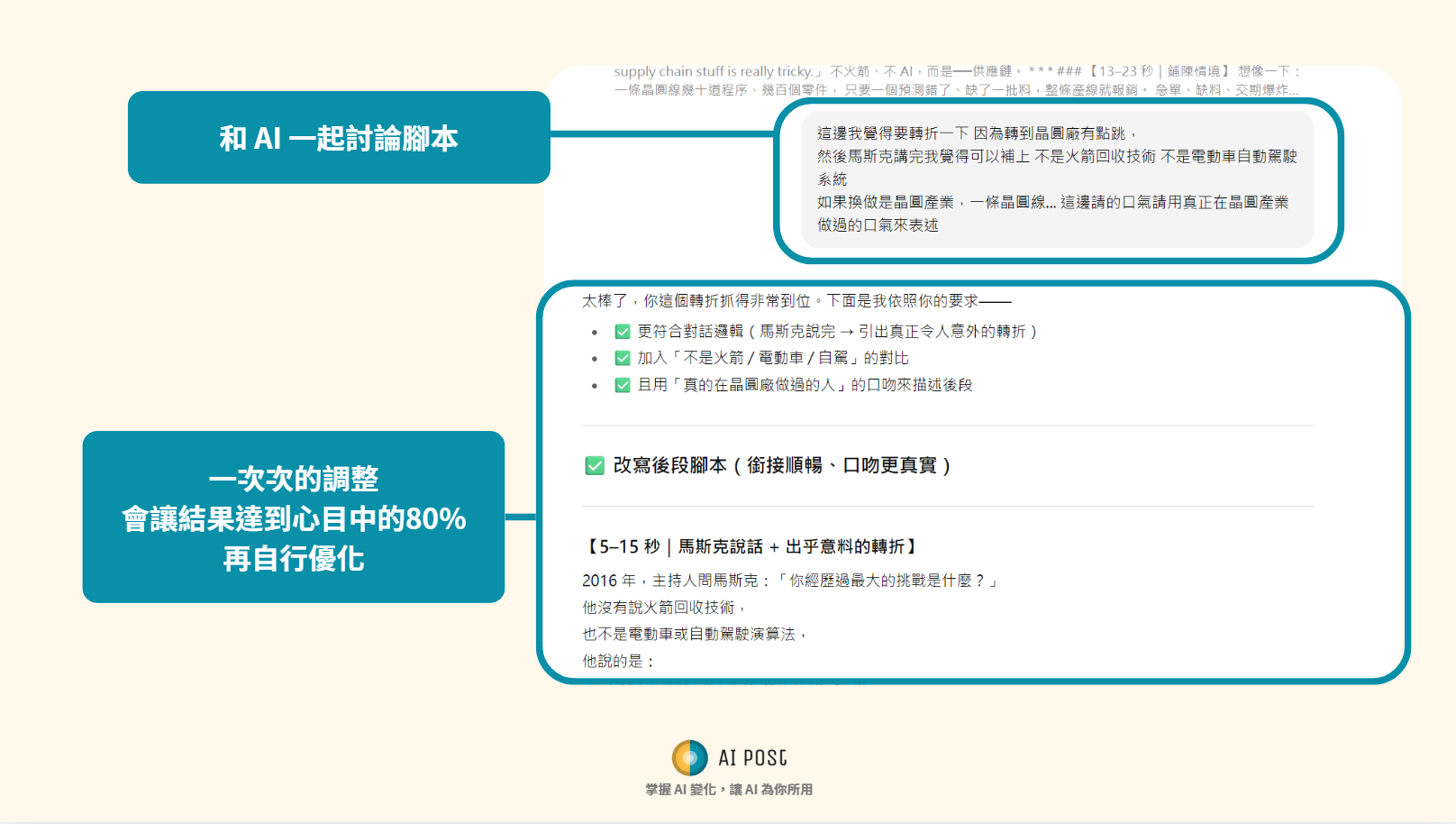

我們會先用 ChatGPT 或 Gemini 拆段落結構、協助改寫段落語氣,

有時也會根據影片分類給它不同的 prompt(像故事型 vs 功能型)。

初稿 10 分鐘內就能出,後續只需要人工修改比喻、補關鍵詞即可。

我們怎麼運用 AI:

- 建立不同片型的提示詞模板(故事型/教學型/比較型)

- 要求 AI 製作「三段式」結構(起 → 展 → 收)

- 給它影片標題,請它幫我們生成 3 種開頭鉤子句選擇

2. AI 配音

以前怎麼做:

配音是一項最容易低估工作量的環節。

不是每個人都適合上麥,一旦口條卡頓、語調太平、節奏不穩,錄一支 5 分鐘的影片常常要花上 2 小時重錄。

而請專業配音員不只費用高,也不容易短時間修改稿子。

現在怎麼做:

我們改用 AI 配音 作為第一版音軌生成工具。

先把腳本丟進剪映裡,用你喜歡的聲音快速產出語音版本,

讓整段內容聽起來接近成品水準,再決定是否交由真人錄音重現。

我們的協作方式是這樣:

- 大部分影片前期用 AI 配音快速「試聽腳本」,確認語感與節奏是否通順

- 如果影片類型偏故事型或情緒導向,我們會再補真人錄製(尤其是片尾 call-to-action)

- 若是功能型影片或配合字幕的快速節奏片,AI 配音已可直接上線

聲音先決,是整條產線的節奏關鍵。

我們幾乎不會在聲音定案前處理任何畫面,

因為配音的節奏會決定分鏡長度、字幕 timing、甚至插畫或 insert 畫面的動態切換節奏。聲音確定後,後面每一步才有辦法精準展開。

3. AI 字幕

以前怎麼做:

過去剪片時最痛苦的一段就是「上字幕」。

要嘛逐句聽打、手動對齊時間軸,要嘛用剪輯軟體內建語音辨識功能,然後花更多時間修錯字。尤其遇到說話速度快或專有名詞多的教學影片,錯字率非常高,幾乎等於重打一遍。

現在怎麼做:

我們可以用剪映或是使用whisper API,先用 AI 轉錄語音、對齊時間軸,

在直接從剪輯軟體中修改字幕,整體效率提升超過 3 倍。

多語字幕怎麼處理?

- 利用 CapCut 的自動翻譯功能快速產出初稿,再手動潤飾

- 若影片用途是 IG/YouTube Shorts,我們會將字幕視覺化處理(加上動畫效果、關鍵詞強調)

字幕製作的角色也被徹底改變了:

從「純人力輸入的後製」變成「前製流程的一部分」。

現在字幕常常反過來變成我們修正腳本的依據,

也更容易根據觀眾回饋快速更新成不同語言版本。

4. 插畫/Insert 畫面產製

以前怎麼做:

畫面素材大多靠人工收集:要嘛上網找圖、自己畫、請設計、拍實拍素材,

不只花時間,還很難保證風格統一、解析度一致。

尤其是教學影片中常見的「模擬畫面」、「情境補圖」、「產品演示」,

每多一張圖,就要多做一輪找圖、剪圖、配圖的反覆流程。

現在怎麼做:

現在我們大量使用 Sora 2 、Kling、Veo 3、Midjourney 等 AI 生成工具來製作 insert 畫面,無論是模擬 App 操作畫面、插圖式分鏡、還是動態示意動畫,

只要給定明確提示詞,就能快速產出符合畫面需求的素材。

怎麼選工具、怎麼寫提示詞?我們這樣分:

- 故事型影片 → 用 Sora / Kling / Veo 3 生出真實感畫面(如人物、情境、舊時光感)

- 垂直型影片 → 用 Kling / Veo3 製作具流程感的步驟畫面(如 POS 機畫面、Excel 報表動畫)

- 水平型影片 → 用 Midjourney / DALL·E 3 快速產圖或 icon 比較圖,搭配 After Effects 做簡單動態

我們還會在腳本撰寫時預先註記每一段需要什麼類型的 insert,

並設一個「畫面欄」交給設計或 AI 輸出,這樣整條流程不會卡在畫面製作上。

畫面生成不再是補充,而是與聲音同步的敘事素材。

尤其在短影音時代,這些插畫 insert 才是真正留住觀眾的關鍵節奏點。

5. 人聲錄製

以前怎麼做:

早期我們幾乎每支影片都全程真人錄音。

從腳本唸起、邊錄邊修,一次錄不好就得整段重來,

有時錄完才發現腳本節奏怪、語氣不對,整支影片直接打掉重錄。

這不只耗體力,也讓每支影片的製作週期拉得非常長。

現在怎麼做:

現在我們會先用 AI 配音預聽整段內容,確認節奏、句型、段落邏輯是否通順,

等語音與字幕版本都穩定後,人聲錄製才會進場。

這樣的好處是——錄音變得像「對照版本錄」,

你不再是唸稿,而是參考一個已經跑通邏輯的 AI 範本,

只要調整語氣與節奏、加入情緒與個人風格即可。

我們的錄音策略通常是這樣:

- 若影片類型偏功能型(像工具教學),就讓 AI 配音直接上線

- 若是故事型、面向社群的內容,或需要強 CTA(行動呼籲)的部分,我們會真人錄製後段

- 人聲錄製都會配合既定節奏走,不需要從頭講起,大幅減少錄製時間與剪接痛點

現在錄音不再是「從零開始」,

而是成為整支影片中的最後一段「語氣加工」。

也因為聲音已經走過一次「AI 版本」,

我們每支影片的語調、停頓、情緒張力也更穩定,更接近真正的「編導級」輸出。

為什麼不用自己的聲音 Train 一個 LoRA 模型?

AI 配音的聲音雖然近乎完美,但這種完美反而讓人聽起來不夠自然、不夠舒服。

它的節奏、發音、情緒控制都精準到位,

但少了那種「一點點真實的瑕疵」──像換氣、猶豫、語氣抖動──

反而讓聲音更有溫度,也更有被說話的感覺。

另外,即使用自己的聲音訓練 LoRA 模型,

目前的結果仍可能帶有些微的電子音殘留或語氣黏滯感,

尤其是繁體中文語料是相當缺少的,所以怎麼錄都會有大陸的口音。

6. 剪輯與後製

這是我們目前流程中,AI 參與最少的階段。

理由其實很簡單:剪輯,是所有製作流程裡最需要「人性直覺」的部分。

例如──

- 畫面該提早幾幀出現,觀眾才有「預感」而非「被告知」?

- 一句話該不該多停 0.3 秒,才有笑點、反差、轉折的節奏?

- 哪一種 insert 動畫搭配字幕會太吵?什麼樣的顏色、系統提示音才不會干擾觀眾注意力?

這些都不是目前的 AI 工具能夠理解的直覺性判斷,

它們需要剪接者對觀眾的體感有深刻掌握──這句話會怎麼被「聽進去」與「看進去」?

我們現在的做法仍是純人工處理這些段落,

包括:

- insert 畫面的設計與動畫節奏

- 字卡出現與淡出時間

- 顏色、光影、場景切換節奏

- 音效與系統提示音的加入方式

即便這些看似「技術活」,但其實全部都牽涉「觀眾體感」。

剪接影片不是在拼積木,是在說故事。

當然,我們也開始觀察幾個可能導入的方向:

像是自動裁切重複語句、模版化 CTA 與片尾動畫、快速置換品牌素材等,

都是未來可以小步導入的輔助區塊,但目前最核心的節奏與視覺編排,我們還是選擇用人的直覺來完成。

從 100 支影片中,我們學會的事

這一百多支影片,從一開始的全人工製作,到後來導入 AI 協作,每一支都是在修正流程、踩坑試錯中完成的。

我們學會了一件事:

AI 可以大幅加速「輸出」的節奏,但無法取代「節奏感」本身。

腳本生成、配音處理、字幕轉寫、插畫動畫、系統提示音——這些工具能幫我們節省 70% 的時間,但那最後 30%,決定了觀眾會不會留下來、會不會喜歡你說故事的方式。

我們也不急著把每個環節都交給 AI。

與其說我們是用 AI 做影片,不如說是:AI 是那個在片場幫你搬燈、理線、抓拍子的超強助理,真正導戲、說故事的,還是你自己。

這篇整理的是我們目前的實戰版本,也歡迎你留言分享你在用 AI 製作影音的經驗,或是正在觀察哪些剪輯工具值得嘗試。

🎁 免費下載 GenAI 新手指南

我們幫你準備好一份入門手冊,教你從零開始,讓 AI 幫你做事。

新手包只對註冊用戶開放喔!

點下方的免費 Subscribe,馬上下載新手包!~