Google Veo 4 要來了?全新 Omni 影片模型現身,可以 Remix、改影片、還有超精準文字書寫!

本周焦點事件

- Google Veo 4 要來了?全新 Omni 影片模型現身,可以 Remix、改影片、還有超精準文字書寫!

- Markdown 過時了?Anthropic 工程師:HTML 才是 Claude Code 的終極輸出格式

- AI 會在 2028 開始訓練自己下一代 AI?Anthropic 共同創辦人預測!

- Cloudflare 季報創紀錄,但狠裁 1,100 人:CEO 說,都是 AI 讓這些職位消失的

- Claude Code 新功能 Agent View 上線!

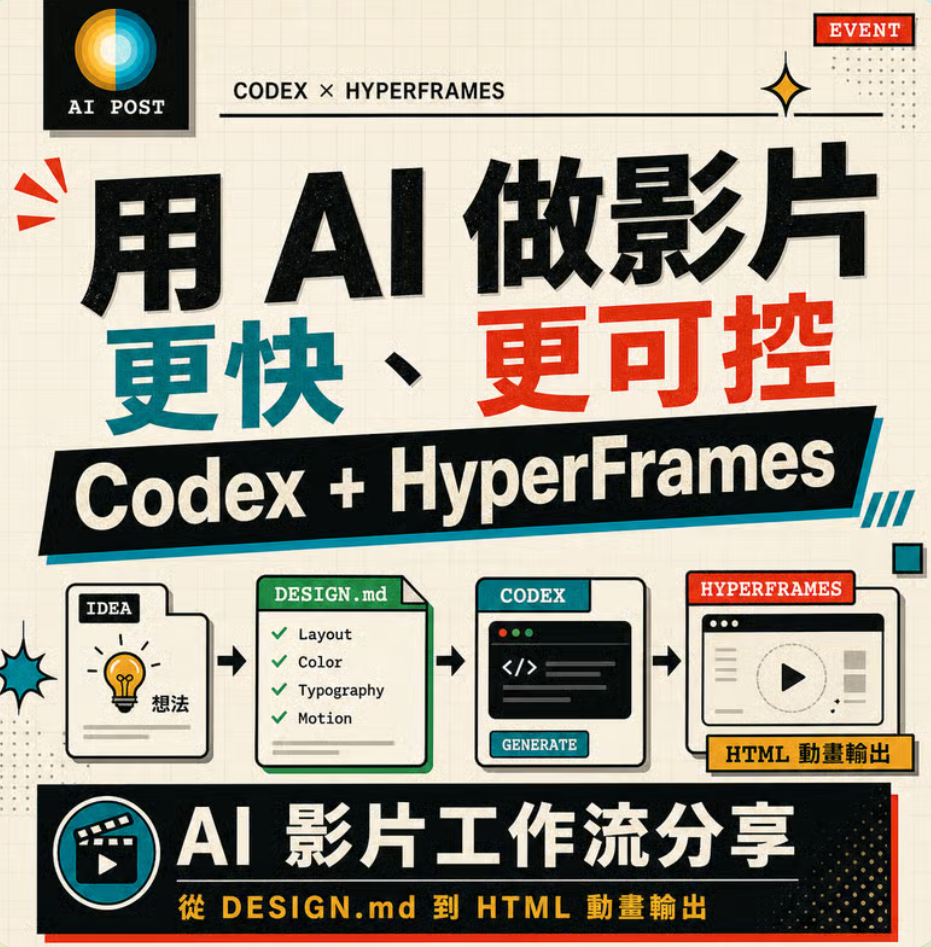

【AI 郵報 Flash Lesson】Codex + HyperFrames 影片工作流,告別剪輯軌,早鳥報名剩 24 小時!

這場 60 分鐘的技術分享,我們將示範如何將影片製作從「過去需要進剪輯軟體、製作素材、設定 Time Frame 等繁瑣的製作過程」轉變為透過 Codex、Design.md 就能快速產出 Motion Graphic 的影片。

本次 Flash Lesson 重點:

- Codex 規劃:利用 AI 撰寫

.md文件,精準定義視覺風格與劇本。 - HTML Composition:跳過剪輯軟體,直接以程式碼架構定義影片內容。

- HyperFrames 渲染:利用最新技術,將互動感十足的畫面(如終端機、聊天框、輸入框)直接自動化產出。

HyperFrames 是 HeyGen 於 2026 年 4 月 17 日釋出的開源影片渲染框架(Apache 2.0),這場課的示範內容包含如何設計「互動式影片」:聊天框浮現、游標點擊動作、輸入框打字效果、終端機指令滾動、狀態切換、最後的 CTA 畫面——每 3–5 秒一個 visual beat,全部在 code 層面定義。改一個動畫時間點?修一行 CSS 重新渲染。換掉一段文案?更新 SCRIPT.md 再跑一次。整個流程可重複、可版控、甚至可以 code review。

活動時間:5月14日 星期四下午8:00 - 下午9:00 GMT+8

票價: NTD 500

名額有限、額滿即止。報名者有回放觀看權限,並附贈課程素材包。

Google Veo 4 要來了?全新 Omni 影片模型現身,可以 Remix、改影片、還有超精準文字書寫!

5 月 2 日,有用戶在 Gemini 正式版 UI 裡發現了一串陌生的文字:「Start with an idea or try a template. Powered by Omni」,一個 Google 還沒有正式宣布的影片模型 Omni Model ,先在介面曝了光。

Google I/O 2026 定在 5 月 19 日才開幕,但這個叫做 Gemini Omni 的新模型,已經提前讓人知道它的存在了,那它到底有什麼特別的呢?

Omni 定位為支援影片重新混製(Remix)、可以用對話框直接編輯影片內容的多功能影片模型。早期展示的亮點是「動態文字書寫精準度」,AI 生成的影片裡,畫面上的文字不再亂跑或變形,這是現有影片 AI 的老問題之一。

Holllllyyyyyyyy @GeminiApp cooked 😳😳

— Chetaslua (@chetaslua) May 11, 2026

🚨 Gemini Omni: New video model

Here is the first output and see the text coherence , if this is not nano banana moment of video then what is ??

direct link for those who believes otherwise in comments pic.twitter.com/LUqJLXUxrf

Omni 和 Google 現役主力 Veo 3.1 的確切關係,Google 官方還沒說清楚。目前業界有三種猜測:Veo 的品牌升級版、獨立的 Gemini 影片模型、或是統一處理圖像和影片的全模態模型。真正的答案大概要等 5 月 19 日 I/O 才會揭曉。

這件事放在一個更大的脈絡裡更有意思:Sora 在 4 月 26 日剛剛關站了。OpenAI 停掉 Sora 的理由是每日推理成本高達 1,500 萬美元、30 天留存率低於 8%,燒錢燒不出用戶黏著度。而 Google 同期把 Veo 3.1 開放給所有 Google 帳號免費使用,免費仔每月也能生成 10 支影片。兩家公司的節奏完全反向,結構性的原因是 Google 有自研 TPU,推理成本比依賴 NVIDIA GPU 的 OpenAI 低得多。

觀察筆記

前陣子 OpenAI 的圖片生成大幅進化,硬是把我拉回去重新試用了一輪。讓我印象最深的除了風格變好看之外,中文字結構穩定性變好,我覺得是一個非常關鍵的功能(雖然遇到「變」或「講」這種筆畫密集、結構複雜的字,偶爾還是會給你一個神秘的變體字,但整體錯誤率的下降幅度,已經讓人非常有感)

這讓我意識到「文字精準度」在視覺相關 AI 裡的分量比我以為的還要重。除了美感問題外,我覺得最重要的是「使用場景的門檻問題」。只要畫面裡的文字是錯的,這支影片就比較沒辦法用,無論是商業廣告、社群貼文、還是任何需要品牌字樣出現的場合。文字不出錯,是影片 AI 從「好玩的玩具」升級成「可以進工作流程的工具」的最後一道門。

Gemini Omni 把「動態文字書寫精準度」當成早期展示的第一個亮點,這個選擇本身就說明了問題。Google 知道整個影片 AI 市場卡在哪裡。一旦這道門打開,最直接受益的其實不是個人創作者,而是需要大量生產本地化內容的品牌和行銷團隊,每個市場、每個語言版本、每個節慶素材,都可以用 AI 快速生成。

Markdown 過時了?Anthropic 工程師:HTML 才是 Claude Code 的終極輸出格式

GPT-4 剛推出的時候,API 呼叫一次上限是 8K tokens,而 Markdown 是省 token 的最佳選擇,因為 ## 比 <h2> 少幾個字元,**粗體** 比 <strong>粗體</strong> 省了一整排 tag。工程師們習慣了 Markdown,自然就把它當成 AI 輸出的「標準格式」。

但現在的 context window 是 1M token (Opus 4.7),情況早就不一樣了。

他的論點是:Markdown 在 2023 年有意義,因為省 token 是當時的核心限制。但在 1M context 的今天,HTML 提供的視覺豐富度、可點擊連結、折疊區塊、互動元素,是 Markdown 的純文字格式完全給不了的。他配了 20 個 HTML 輸出實作範例,展示 Claude 如何能輸出有搜尋欄、有 tab 切換、有可視化圖表的互動式文件,而不只是一坨 ## 和 -。

這篇文章在 X 和 Hacker News 拿下超過 15,000 讚,Django 共同創辦人 Simon Willison 公開說自己「被重新說服了」。Anthropic 內部據稱也已把 HTML 設為計畫、PR Review、設計系統和報告的標準輸出格式。

觀察筆記

我坦白說,看完這篇的第一個反應不是「哇好厲害」,是:他是 Anthropic 員工。

Thariq 在 Anthropic 內部工作,用的是最前沿的模型,而且幾乎可以確定不是自掏腰包在付 API 費用。在這個前提下,HTML 輸出當然是 best practice,因為你不需要在意每次 call 多燒幾百個 token,你只需要在意輸出夠不夠符合你的需求。

但對我這種能用本地跑就本地跑的 token 客家人來說,HTML 的邏輯很難直接套用。同樣一份報告,Markdown 輸出可能 800 tokens,HTML 版本帶上結構、樣式、互動元素,輕鬆衝上 2000。如果你一天要跑幾十次、幾百次,這個差距早就不是格式偏好的問題,是帳單的問題。

這篇文章在 Hacker News 上拿下 15,000 讚,Simon Willison 說被重新說服了。但留言區裡也有不少人直接點出「這是 Anthropic 內部人的視角」。用量無限的人在談輸出格式最佳化,跟用量有限的人在談,根本是兩個不同的優化問題。

Thariq 說的不是錯的,HTML 確實比 Markdown 豐富,這點毫無爭議。但豐富度是你現在最緊缺的資源嗎?對 Anthropic 工程師來說,答案是肯定的。對大多數人,得先問 token 帳單。

AI 會在 2028 開始訓練自己下一代 AI?

AI 能獨立完成任務的時間長度,從 2022 年的 30 秒,成長到 2026 年的 12 小時。

這是 AI 安全評估機構 METR 的數據,也是 Anthropic 共同創辦人 Jack Clark 用來支撐一個很大膽預測的核心論據:在 2028 年底之前,AI 有 60% 以上的機率,將能全自主地訓練出他的下一代新推理模型。

Clark 在電子報中提到,SWE-Bench(評估 AI 解決真實軟體工程問題能力的標準測試)的分數,從 Claude 2 的時代 2%,爬升到最新 Mythos Preview 模型的 93.9%。也就是說,AI 解決真實 coding 問題的能力,在幾年之內從「幾乎做不到」變成了「幾乎全會」。

把這條成長曲線繼續往前拉:Clark 預測今年底,AI 能獨立運作 100 小時不間斷。一旦能長時間自主工作,AI 設計並訓練下一代 AI——就成了它可以做到的事情之一。

同一週,倫敦新創 Recursive Superintelligence(成立只有 4 個月)完成了 5億融資,由 Google Ventures 領投、Nvidia 跟投。目標是全自動化 AI 前沿研究流程。創辦人名單包含前 Salesforce 首席科學家 Richard Socher、UCL 教授 Tim Rocktäschel、前 OpenAI 研究員 Josh Tobin。

觀察筆記

Elon Musk 在幾周前曾在 Podcast 提過一個讓我印象深刻的邏輯:當機器人可以自己生產機器人,萬物的製造成本會趨近於零,因為唯一剩下的邊際成本只有原材料和能源。

AI 訓練下一代 AI,是同一件事的軟體版本。Jack Clark 用 METR 的數據說明的,本質上是一條自主能力的指數曲線,一旦 AI 自主運行的時間夠長,讓 AI 去設計並訓練下一代 AI就不再是科幻。

其實看完這篇我只有一個想法, 假設 AI 是一個物種,它的迭代週期現在是幾個月,目前還需要人工授精,但這個週期現在是以指數等級在下降,且每一代都可以直接參與下一代的設計,未來恐怕比人類還難纏,以前 Elon 他們在吵 AI 的安全性時,坦白說我還沒這麼有感,但我在寫這篇的時候卻開始覺得,這些人類菁英們好像開啟了潘朵拉的盒子。

Cloudflare 季報創紀錄,但狠裁 1,100 人:CEO 說,都是 AI 讓這些職位消失的

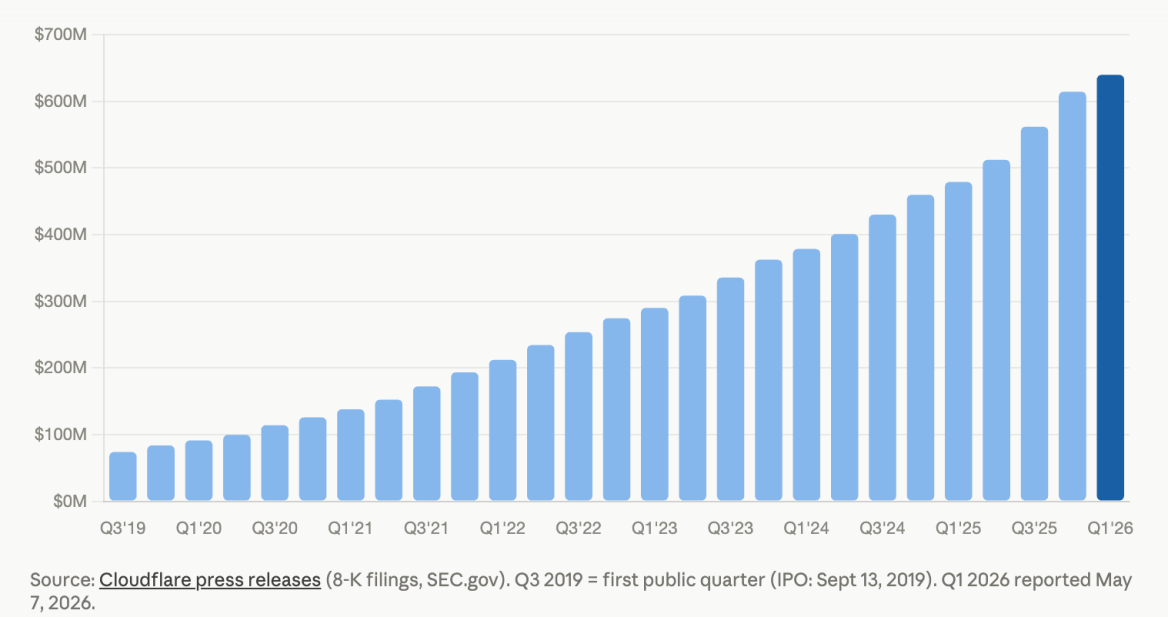

2026 年 Q1,Cloudflare 交出了公司 16 年歷史中最亮眼的季報:營收 $6.398 億,年增 34%,史上最高單季。也是在同一場法說會,CEO Matthew Prince 宣布裁員 1,100 人,約佔全公司員工的 20%,是 Cloudflare 創立以來首次大規模裁員。

Prince 表示:過去三個月,Cloudflare 內部的 AI 使用量增長了 600%,部分員工的生產力提升到原來的 100 倍,「並讓一些職位的人力需求消失了」。公司 100% 的部署代碼,現在都由自主 AI agent 審查。他還補了一句,他預測 2027 年的員工人數,將超過 2026 年任何時間點的水平。也就是說,公司不是在縮減,只是在汰換角色。

有意思的是市場不買帳。季報超預期通常讓股價漲,但這次 Cloudflare 卻跌了 24% 。也在同一個月,Salesforce 裁撤約 4,000 個客服職位,理由是 AI agent 已處理 50% 的客服互動;Amazon 裁了 16,000 人,同期 AWS 成長 24%(13 季最快增速);Oracle 裁員高達 30,000 人,說是要把人力資源轉向 AI 數據中心建設。高成長、高裁員、AI 當理由,在 2026 年已經是一個有固定模板的劇本。

Claude Code 新功能 Agent View 上線!

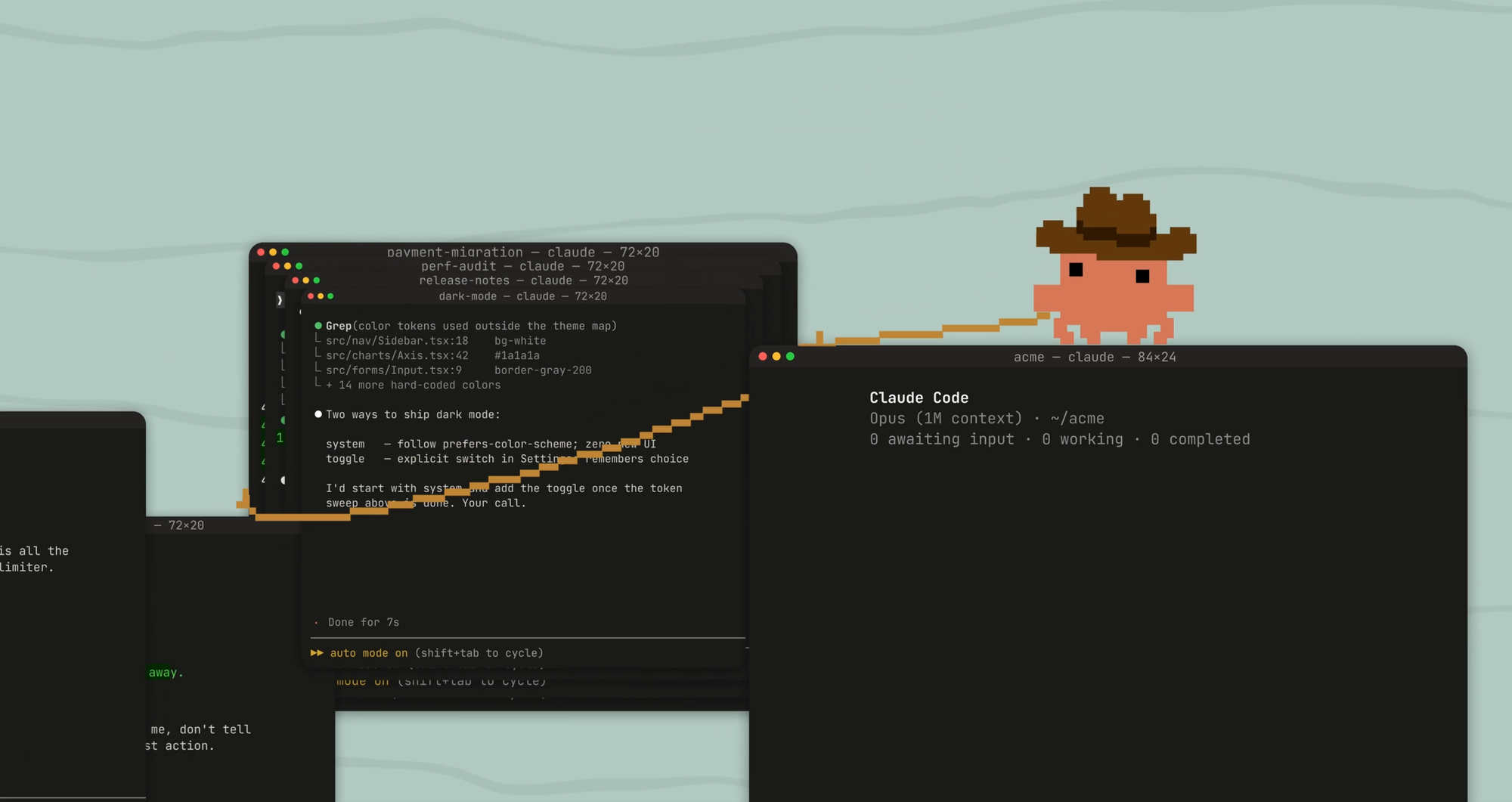

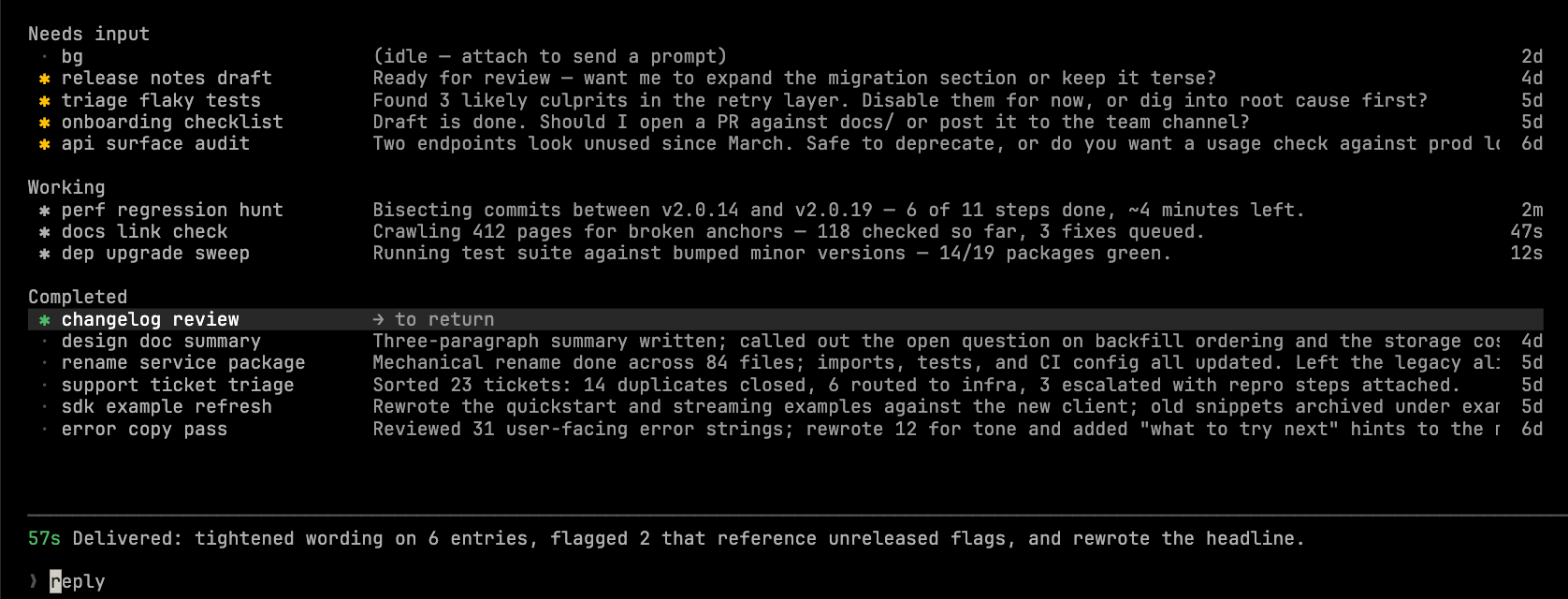

2026 年 5 月 11 日,Anthropic 在 Claude Code 裡推出了一個叫做 Agent View 的研究預覽功能。

你只要在終端機輸入 claude agents,就能打開一個統一的列表視圖,看到所有正在跑的 Claude Code session,確認哪幾個進行中、哪個在等你確認、哪個需要人工介入才能繼續。如果某個 agent 卡住了,它會即時通知你。

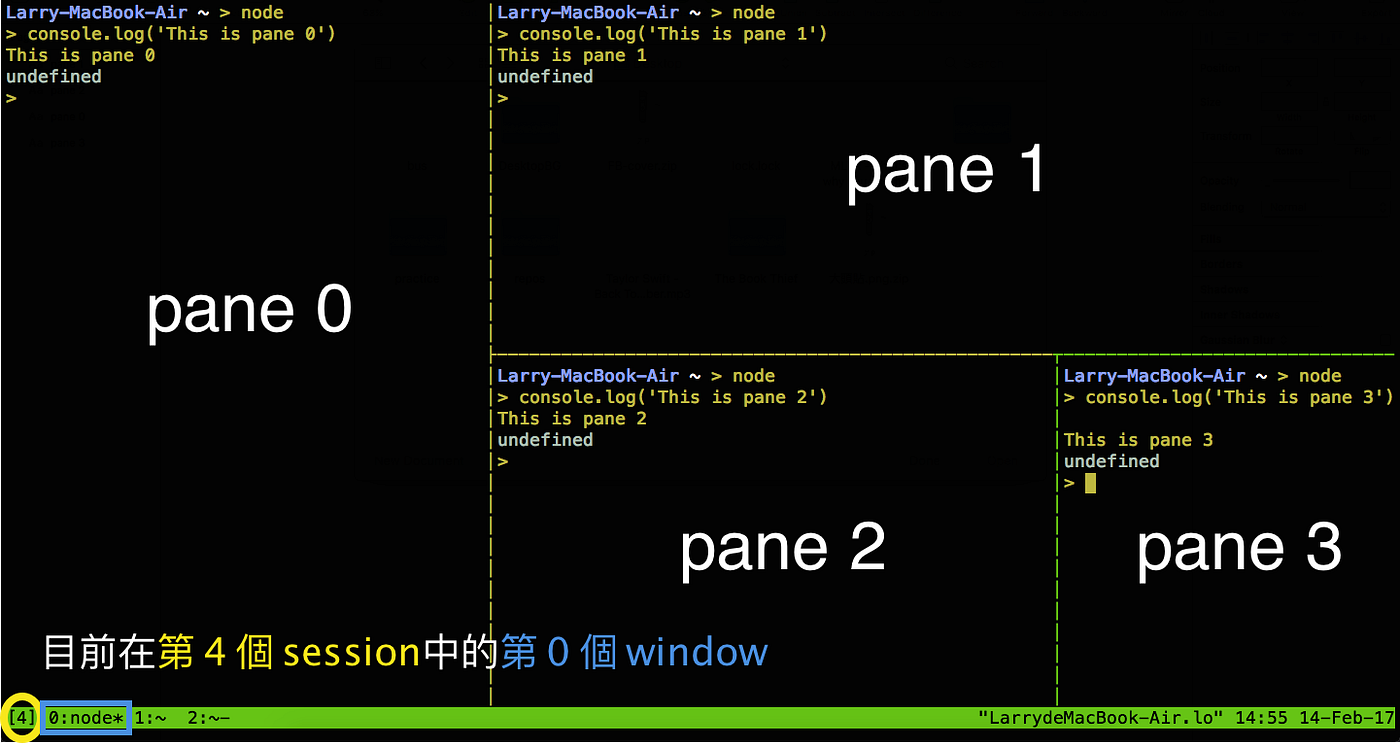

Anthropic 開發者 Thariq 在 X 上說,Agent View 的設計概念是「tmux built for Claude Code」。tmux 是工程師用來在同一個視窗管多個終端 session 的工具——如果你用過 tmux,就懂那個感覺:原本要跳來跳去的多個視窗,現在一眼都能掌握。

目前 Agent View 以 Research Preview 形式推出,需要 Claude Code v2.1.139 或以上版本,支援 Pro、Max、Team、Enterprise 及 API 方案。背景跑的 session 共用主訂閱配額,開太多 agent 同時跑,token 消耗會快很多。

喜歡這期內容嗎?有哪一則讓你特別有感?

歡迎回信或是 Instagram 告訴我們,我們會偷偷讀大家的回覆的!

我們下周見

—AI郵報 編輯團隊