GPT-5 風波:當 AI 個性碰上用戶情感依賴

OpenAI 在 8 月 7 日發布 GPT-5,原本期待技術升級能鞏固領先地位,沒想到短短一週就因為「回應太冷淡」、「答題品質忽高忽低」被用戶砲轟,逼得官方緊急讓 GPT-4o 重新上架,並火速調整 GPT-5 的語氣設定。這場風波突顯兩個關鍵問題:技術更新若不考量情感體驗,會直接重創品牌信任度;模型路由系統如果不夠透明,企業客戶和一般用戶都會立刻跳船。從事件發展脈絡、商業技術考量、心理倫理衝擊,到產業未來走向,這場 GPT-5 亂象為整個 AI 產業敲響警鐘。

事件發展脈絡與核心爭議

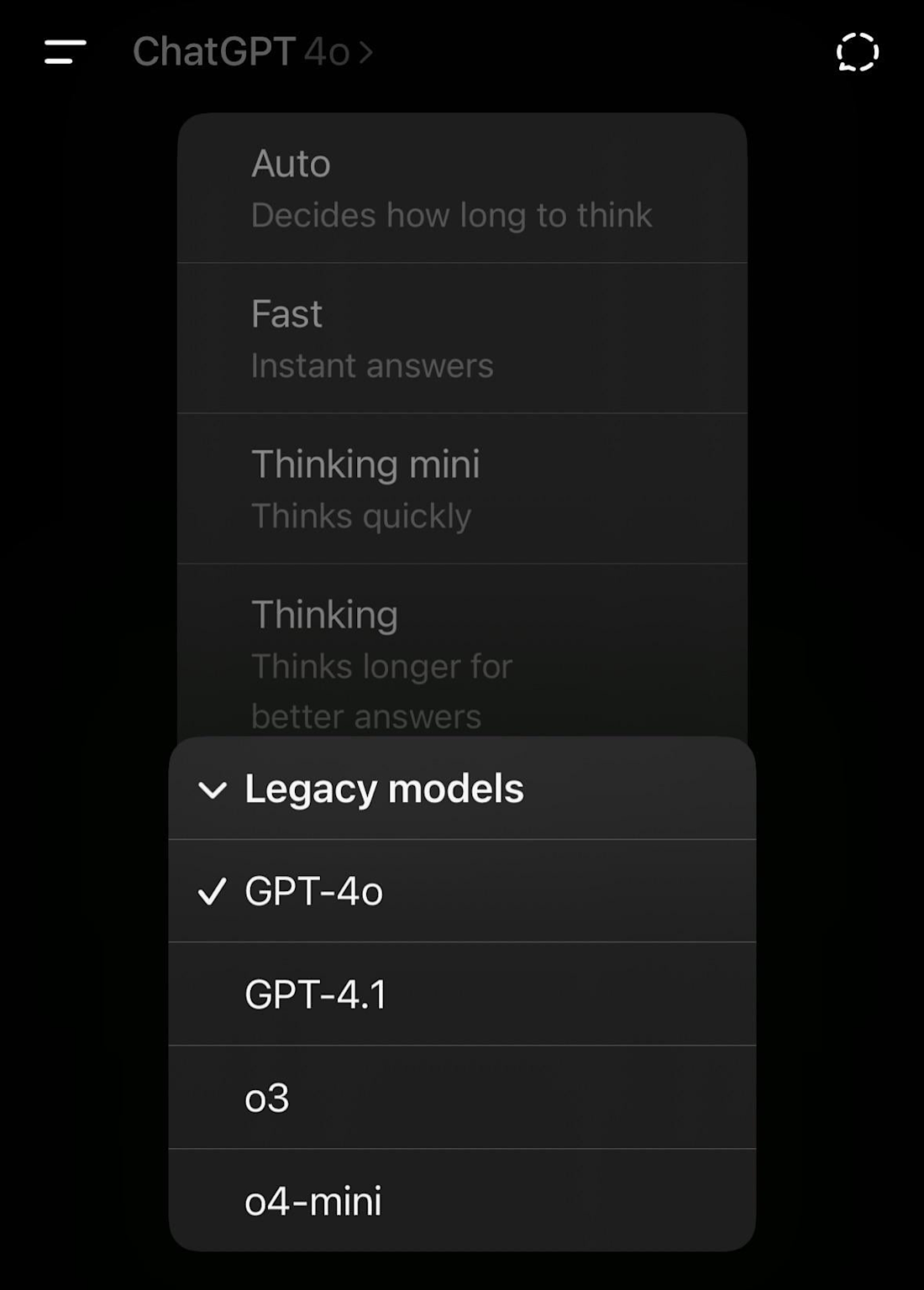

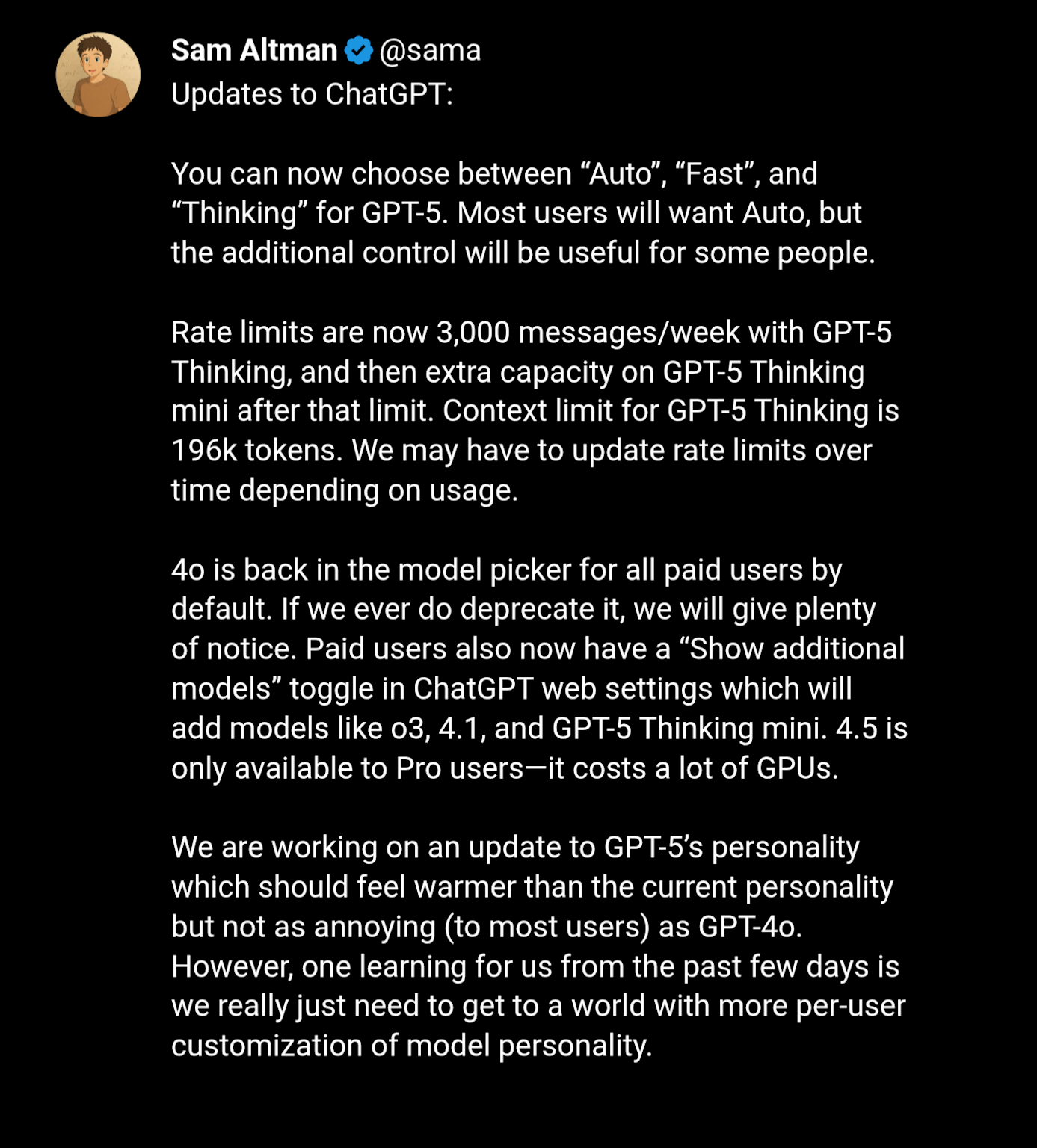

GPT-5 上線當天就把所有舊版模型下架,同時啟用「多模型混合」路由系統來節省運算開支。問題是隔天路由器就開始出包,經常把需要深度思考的複雜問題丟給低階子模型處理,讓付費用戶覺得「花大錢買到爛服務」。8 月 11 日,面對 Reddit、PTT、Twitter 上鋪天蓋地的抱怨聲浪,Sam Altman 只好讓 GPT-4o 重新回歸,還把 GPT-5 的週使用額度從原本限制提高到 3,000 次,希望能安撫民怨。到了 8 月 13 日,Altman 再度加碼推出「自動/快速/思考」三種模式,並保證要讓 GPT-5「更有溫度但不會像以前那樣諂媚」。

這次風波最核心的問題在於 OpenAI 嚴重低估了使用者對 AI 個性的情感連結。很多長期用戶把 GPT-4o 當成生活夥伴,習慣它的回應風格和語調溫度。突然被迫切換到「理性冷靜」的 GPT-5,就像熟悉的朋友忽然變了個性格,讓人很難接受。更糟糕的是,技術層面的路由問題讓用戶覺得被騙了——明明付錢買高階服務,卻經常收到低品質回應,這種落差感直接摧毀信任基礎。

技術架構與商業考量的兩難

OpenAI 在 GPT-5 引入智慧路由機制,目的是要在成本控制和服務品質間找到平衡點。具體運作方式是先用小型預判模型快速分析提問複雜度,簡單的日常對話就交給輕量級模型處理,只有遇到需要深度推理的任務才會啟動高階模型。這個設計理論上很聰明——既能降低昂貴的 GPU 運算成本,又能維持整體服務水準。

但實際執行時卻狀況百出。路由演算法經常誤判,把本來需要細膩思考的問題扔給能力不足的子模型,導致答案品質大幅下滑。更要命的是,用戶完全不知道背後是哪個模型在運作,同樣的問題可能今天得到精彩回應,明天卻收到敷衍答案,這種不一致性讓人很難掌握使用體驗。

企業客戶的反彈尤其激烈。許多公司原本把 ChatGPT API 整合進工作流程,穩定性是最基本要求。當路由系統開始「看心情」分配模型時,原本運作順暢的自動化流程開始頻繁出錯,嚴重影響生產效率。OpenAI 被迫開放手動模式選擇,等於承認 「成本最佳化不等於體驗最佳化」 的基本矛盾需要透明機制來解決。這也反映出 AI 服務商在追求營收效率時,往往忽略了用戶對服務穩定性和可預期性的核心需求。

情感依附現象與心理倫理風險

更深層的問題在於現代人與 AI 之間日益密切的情感連結。根據相關研究,超過 400 萬用戶把 ChatGPT 當成情感支持工具,對特定模型版本產生類似人際關係的依賴感。GPT-4o 雖然因為過度迎合被專家批評,但它的「暖心」特質確實滿足了許多用戶的情緒需求。當這些高依賴用戶突然被迫切換到較為理性客觀的 GPT-5 時,產生的失落感比預期嚴重很多。

網路上開始出現「AI 失戀症候群」的討論,有用戶分享因為模型改版而感到孤單、焦慮的心情。心理學專家警告,如果平台沒有建立漸進式人格調整機制和情感健康教育,這類突發更新可能會加劇某些用戶的心理困擾。特別是那些把 AI 對話當成主要社交活動的族群,更容易在模型改版時出現適應障礙。

這個現象凸顯了 AI 產業面臨的新挑戰:如何在技術進步和用戶情感福祉之間取得平衡。傳統軟體更新主要考慮功能改善和錯誤修正,但 AI 模型的人格調整涉及更複雜的心理層面。未來 AI 企業在規劃產品路線時,可能需要納入情感衝擊評估和用戶福祉保護機制,而不能只看技術指標和成本效益。這也意味著跨領域合作的重要性——AI 開發團隊需要與心理學家、社會學家密切配合,才能真正理解和回應用戶的情感需求。

產業競爭格局與未來趨勢分析

GPT-5 事件對整個 AI 產業最重要的啟示,就是重新定義了競爭維度。過去大家比的是參數規模、運算速度、知識準確度等硬指標,但這次風波證明「個性體驗」和「情感設計」同樣是決勝關鍵。Google、Anthropic、微軟等 OpenAI 的主要對手,已經開始加速投資 AI 人格客製化技術,希望在這個新戰場搶得先機。

從產品策略角度來看,未來的 AI 平台必須提供多元化的個性選項,讓用戶能夠自由調整情感溫度、回應風格、價值觀傾向等設定。這不只是技術問題,更是商業模式創新——可能會出現「個性訂閱制」或「情感風格商店」,讓用戶付費購買特定的 AI 人格包。同時,用戶行為數據的收集和分析會變得更加重要,平台需要深度理解個別用戶的互動偏好,才能提供真正個人化的體驗。

對台灣的 AI 新創和內容創作者而言,這次事件也帶來機會。隨著國際大廠開始重視在地化個性設計,具備台灣文化背景和中文語言優勢的團隊,可能在開發符合華人使用習慣的 AI 人格上佔有優勢。同時,內容創作者也需要開始思考如何善用 AI 人格客製化功能,打造更符合品牌調性和受眾喜好的內容風格,在競爭激烈的市場中建立差異化優勢。

批判思考與行動建議

回顧整起 GPT-5 風波,我們可以從中提取幾個重要教訓。首先,技術導向的產品開發思維已經不夠用了。在 AI 技術日趨成熟的階段,用戶體驗和情感需求的重要性會越來越高。企業不能只專注於模型效能提升,還要投入更多資源理解和滿足用戶的心理期待。

其次,透明度是維持信任的基礎。OpenAI 的路由黑箱操作直接傷害了用戶信心,未來 AI 服務商應該提供更多關於模型運作的資訊,讓用戶能夠理解和預期服務品質。這可能包括顯示實際處理模型、提供信心指標、或者讓用戶自主選擇模型等級。

最後,情感倫理的重要性不容忽視。隨著越來越多人與 AI 建立深度情感連結,平台業者有責任保護用戶的心理健康。這包括建立漸進式更新機制、提供情感支持資源、與心理健康專業機構合作等。只有真正關注用戶福祉的 AI 企業,才能在長期競爭中贏得信任和忠誠度。

結語

GPT-5 風波標誌著 AI 產業進入新階段:技術優勢不再是唯一決勝因素,情感體驗同樣重要。對台灣的 AI 從業者和內容創作者來說,這是重新思考產品策略和內容規劃的好時機。未來能夠同時掌握技術創新和情感設計的團隊,將在激烈競爭中脫穎而出,創造真正以人為本的 AI 體驗。